Dans un monde technologique désormais envahi par l’IA, il est difficile d’imaginer un événement majeur sans une mention d’intelligence artificielle. Apple n’a pas dérogé à la règle lors de sa WWDC 2025, même si la firme a adopté une approche plus mesurée cette année. Et c’est peut-être la meilleure décision qu’elle pouvait prendre.

Une évolution plus subtile, mais plus solide pour Apple Intelligence

L’an dernier, Apple avait annoncé en fanfare l’arrivée d’Apple Intelligence, mais l’enthousiasme a vite laissé place à la frustration. Le déploiement a été lent, partiel, et souvent jugé décevant. Résultat : Apple s’est retrouvé la cible de nombreuses moqueries dans le monde tech.

Mais en 2025, changement de stratégie. Apple n’a pas saturé sa keynote d’IA, mais elle n’a pas ignoré le sujet non plus. La firme a annoncé une série d’améliorations concrètes, pratiques, et surtout discrètes.

Ce n’est plus l’IA spectaculaire, mais l’IA utile.

Traduction en direct : briser les barrières linguistiques

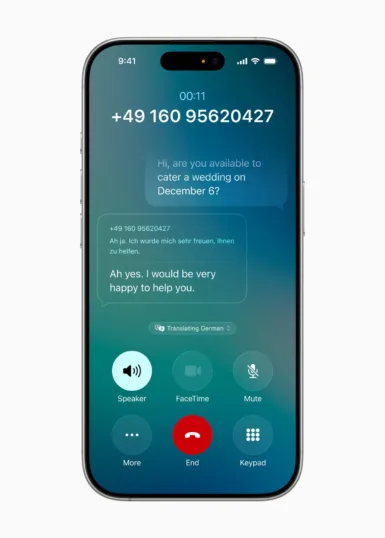

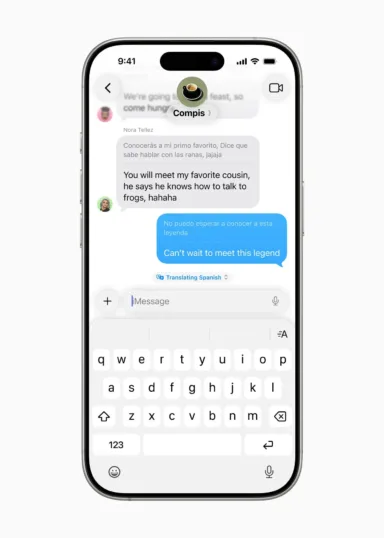

L’une des plus grandes nouveautés est Live Translation, une fonction intégrée à Messages, FaceTime et l’app Téléphone, qui permet la traduction en temps réel des messages et appels.

Tout cela se passe en local sur l’appareil, sans passer par le cloud, ce qui garantit une confidentialité totale. Les conversations textuelles se traduisent au fur et à mesure, tandis que FaceTime propose des sous-titres traduits en direct et les appels vocaux bénéficient d’une traduction vocale instantanée.

La fonctionnalité rappelle fortement Galaxy AI de Samsung, mais Apple mise ici sur la confidentialité et l’intégration native à l’écosystème.

Apple Intelligence s’ouvre à plus de langues

D’ici la fin de l’année, Apple Intelligence prendra en charge 8 nouvelles langues : le danois, le néerlandais, le norvégien, le portugais (Portugal), le suédois, le turc, le chinois traditionnel et le vietnamien.

Une évolution majeure qui rend la technologie plus accessible à l’international.

Genmoji et Image Playground : créer, s’exprimer, personnaliser

Avec Genmoji, les utilisateurs peuvent désormais créer des emojis personnalisés à partir de texte, avec des réglages fins comme les expressions faciales ou la coiffure. Et grâce à Image Playground, vous pouvez générer des visuels dans différents styles artistiques (peinture à l’huile, art vectoriel, croquis…) – le tout en partenariat avec ChatGPT.

Bien entendu, aucune donnée n’est transmise sans consentement, dans le respect des principes de confidentialité made in Apple.

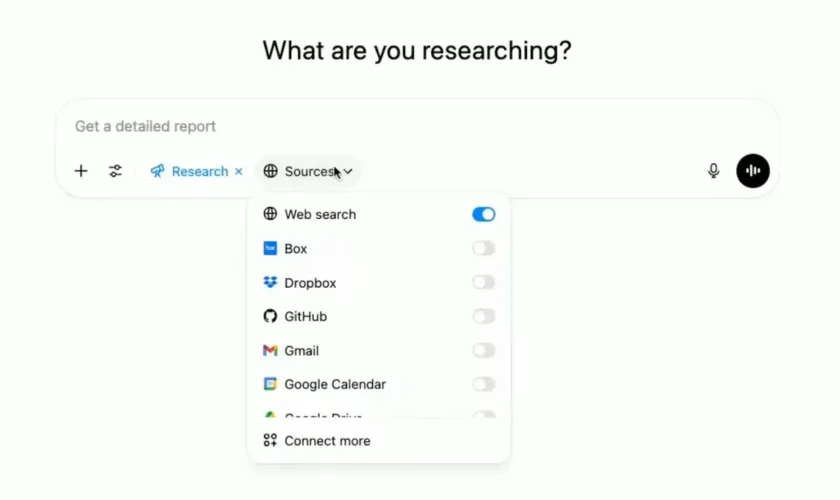

Intelligence visuelle : votre iPhone devient un scanner intelligent

Une autre nouveauté marquante : l’intelligence visuelle. Apple Intelligence peut maintenant analyser ce qui s’affiche à l’écran de votre iPhone et vous proposer des actions immédiates :

- Rechercher un objet ou produit similaire en ligne via Google ou Etsy.

- Ajouter automatiquement un événement détecté à votre calendrier (heure, date, lieu).

- Poser des questions à ChatGPT sur un contenu affiché sans changer d’application.

Cela ressemble fortement à la fonction Entourer pour chercher chez Google, mais ici encore, Apple mise sur une intégration fluide et locale.

L’Apple Watch muscle son jeu avec Workout Buddy

Côté montre connectée, Workout Buddy fait ses débuts sur watchOS 26. Grâce aux données d’entraînement, de fréquence cardiaque, d’activité ou de distance parcourue, ce coach virtuel génère des encouragements personnalisés en temps réel.

La fonction fonctionne hors ligne, en local, et repose sur une voix dynamique issue des coachs de Fitness+. Disponible au lancement en anglais, elle couvrira les activités les plus populaires : course, marche, HIIT, vélo, musculation…

D’autres fonctions IA intelligentes… et bien intégrées

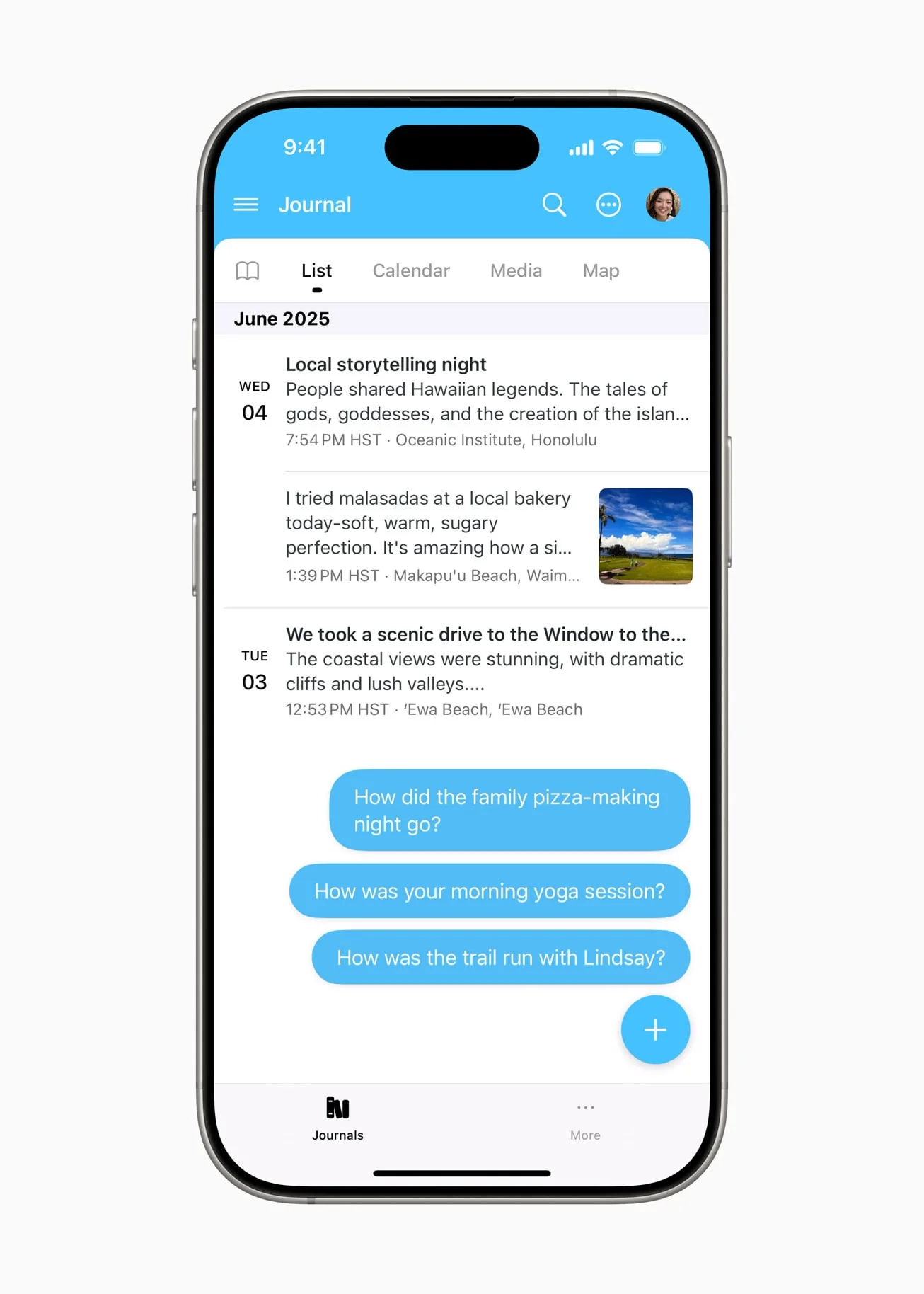

Apple ne s’est pas arrêtée là. Plusieurs applications ont également reçu une petite dose d’intelligence artificielle :

- Wallet peut résumer les suivis de commande à partir de vos emails.

- Messages propose automatiquement de créer un sondage dans un groupe lorsque cela semble utile.

- Rappels peut catégoriser automatiquement les tâches repérées dans vos mails, notes ou pages web.

- Personnalisation des fonds de discussion possible avec Image Playground.

Siri : la grande absente… pour l’instant

Et Siri dans tout ça ? Si vous attendiez une version radicalement améliorée, il faudra patienter encore un peu. Apple a annoncé que la nouvelle Siri dopée à l’IA arrivera plus tard dans l’année, mais elle ne sera pas présente dans les premières bêtas de iOS 26, iPadOS 26 ou macOS Tahoe 26.

Quand elle arrivera, on peut s’attendre à :

- Une meilleure compréhension du contexte personnel,

- Une réactivité plus naturelle,

- Un contrôle plus précis des applications, à la manière des assistants IA modernes.

Moins de bruit, plus d’efficacité

Apple semble avoir compris que l’IA n’a pas besoin de faire du show pour être utile. Avec cette approche plus pragmatique, Apple Intelligence devient réellement une valeur ajoutée au quotidien, tout en respectant la vie privée de l’utilisateur. Et même si tout n’est pas encore prêt, le virage amorcé en 2025 pourrait bien poser les fondations d’une nouvelle ère… plus discrète, mais surtout plus pertinente.