Aujourd’hui, Google a annoncé le lancement de Gemini for Workspace, une nouvelle offre centrée sur les entreprises qui apporte la puissance de Gemini Ultra 1.0 — le modèle le plus performant de l’entreprise — dans les applications Workspace telles que Docs et Meet avec des protections de données de niveau entreprise.

Google a récemment franchi une étape importante dans le domaine de l’intelligence artificielle avec la transformation de Bard en Gemini, ainsi que le lancement de la nouvelle application Android Gemini et d’un nouveau forfait Google One conçu spécialement pour ceux souhaitant exploiter les capacités avancées de Gemini Advanced et son modèle d’IA le plus performant, Ultra 1.0.

Ce nouveau niveau d’abonnement, nommé « Google One AI Premium », offre également aux utilisateurs un accès à 2 To de stockage, en plus des autres avantages Google One. Malheureusement, ce dernier n’est pas encore disponible en France.

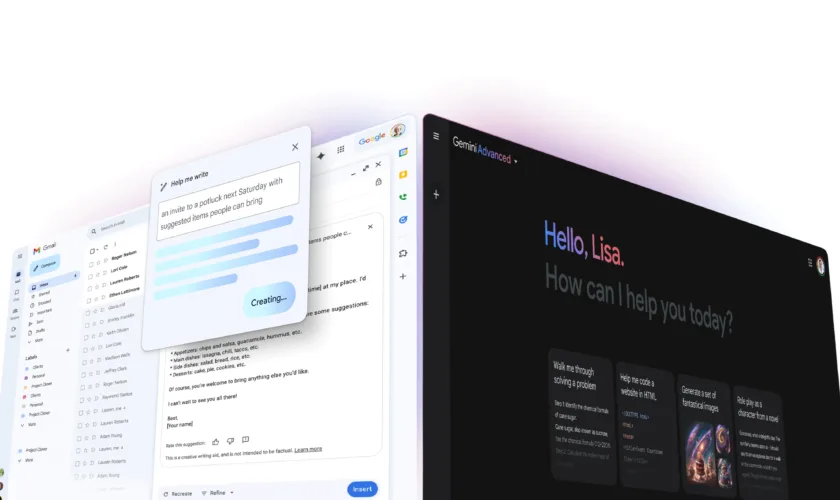

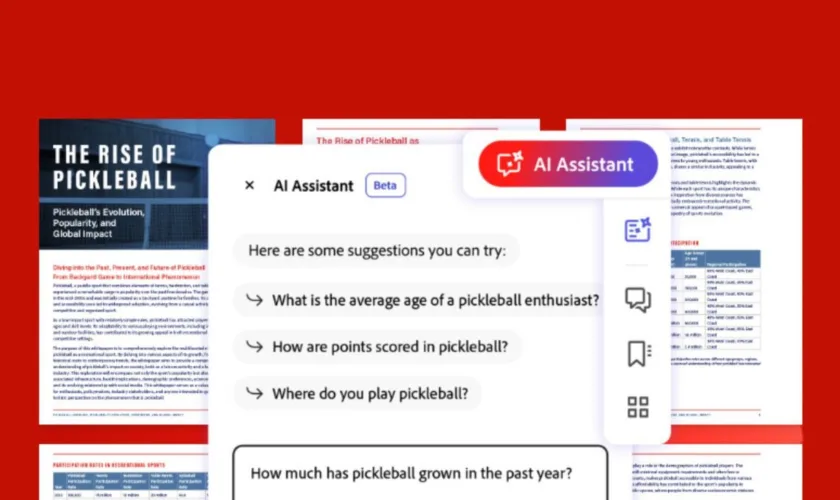

La nouveauté marquante est l’extension des fonctionnalités de Gemini aux applications Gmail, Docs, Slides, Sheets et Meet, anciennement connues sous le nom de Duet AI dans l’univers Google Workspace, désormais rebaptisées « Gemini » à l’instar de Bard.

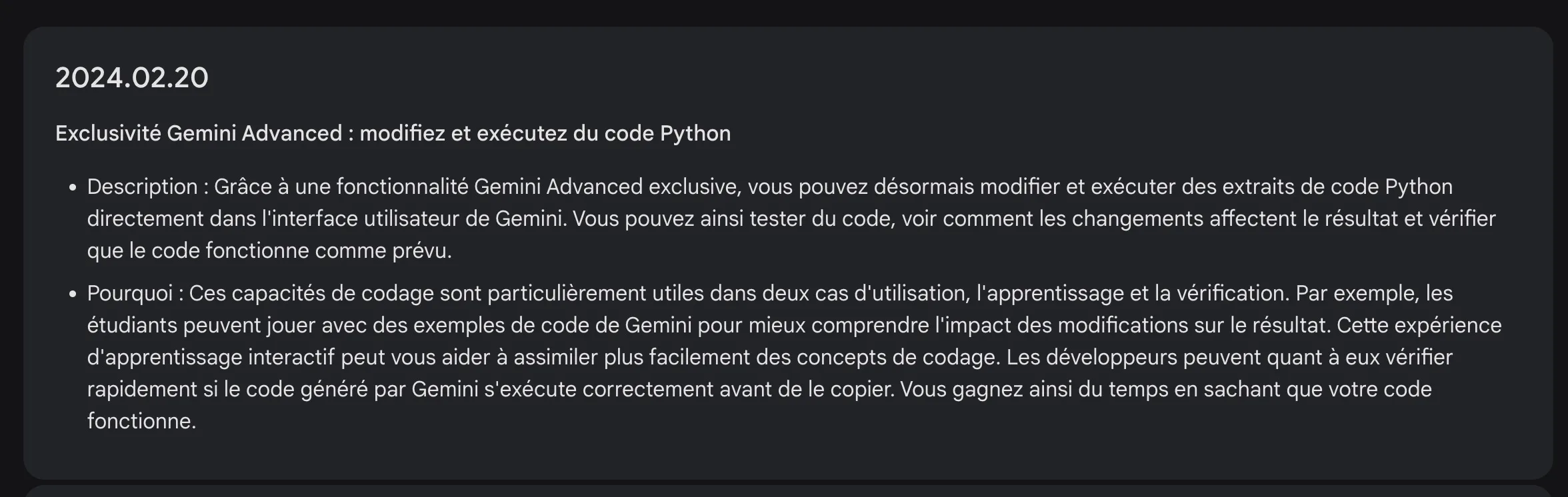

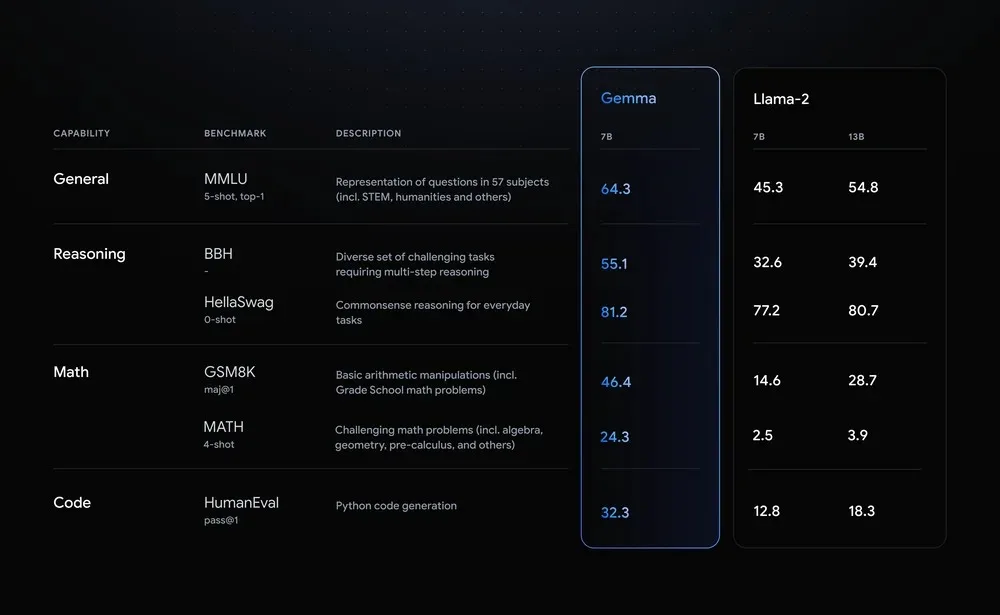

Le modèle LLM Ultra 1.0 de Gemini est salué pour ses avancées significatives dans le monde de l’IA, notamment en termes d’efficacité de traitement, de compréhension avancée des instructions et programmes, ainsi que d’amélioration des compétences de résolution de problèmes.

Ce modèle est capable d’analyser et d’expliquer des données, mais aussi de rédiger du code de haute qualité dans de nombreux langages de programmation, enrichissant ainsi l’expérience utilisateur dans les applications Workspace sans nécessiter de changer d’application ou d’onglet.

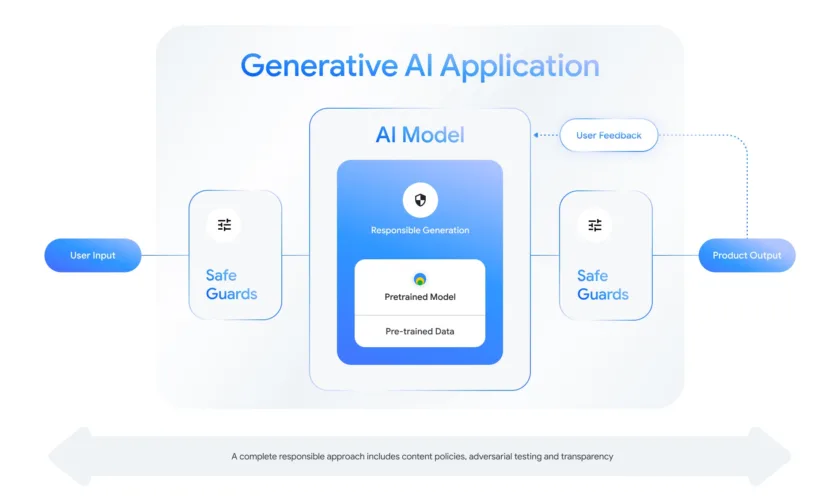

Respect de la vie privée

Outre l’intégration de Gemini dans les applications, la nouvelle offre permettra également aux utilisateurs de Workspace de bénéficier d’une expérience de chatbot Gemini autonome afin d’accélérer leurs workflows et leur créativité sans se soucier des risques liés à la confidentialité ou à la sécurité.

Google souligne également que, conformément à ses principes de confidentialité des données liées à l’IA, Gemini dans Google Workspace n’utilise pas vos informations personnelles et/ou professionnelles pour former ou améliorer ses modèles d’IA sans votre permission. Cet aspect est crucial à souligner à une époque où les frontières de la vie privée peuvent parfois sembler floues.

Gemini commence aujourd’hui son déploiement dans Gmail et les applications Workspace (anciennement Duet AI) pour les membres AI Premium dans plus de 150 pays en anglais. Comme lors de son lancement, les abonnés AI Premium bénéficient également de Gemini Advanced, de 2 To de stockage utilisables sur tous les services Google (tels que Google Photos et Drive), ainsi que d’autres avantages Google One pour 19,99 dollars par mois, avec deux mois d’introduction gratuits.

Cette initiative devrait renforcer la position de Google face à Microsoft, qui a déjà fait quelque chose d’analogue avec son expérience Copilot pour les entreprises.