Google a publié une sélection d’outils d’IA pour guider le développement de modèles d’IA génératifs responsables. La boîte à outils souligne l’importance de la qualité des données par rapport à la quantité et présente les meilleures pratiques pour créer des ensembles de données de réglage.

C’est une étape importante qui guide les développeurs dans la création éthique de modèles d’intelligence artificielle (IA). Elle est conçue pour garantir que les systèmes d’intelligence artificielle sont sûrs, fiables et exempts de biais. Il s’agit d’une ressource que les développeurs peuvent utiliser pour créer une IA qui respecte les normes éthiques et sert le bien public.

Au cœur de tout système d’IA se trouvent les données à partir desquelles il apprend. La boîte à outils de Google met fortement l’accent sur la nécessité de disposer de données d’entraînement de haute qualité.

Il est entendu que plus les données d’entraînement sont de qualité, plus le modèle d’IA sera robuste et efficace. La boîte à outils fournit des conseils sur la manière de générer des exemples d’entraînement de premier ordre, en particulier pour les Large Language Model (LLM), qui sont essentiels pour le développement de l’IA.

Un aspect innovant de la boîte à outils est sa recommandation d’utiliser des requêtes contradictoires. Il s’agit de prompts stimulants qui mettent à l’épreuve les défenses de l’IA et contribuent à améliorer sa sécurité. En préparant l’IA à gérer une variété de situations réelles, les développeurs peuvent s’assurer que l’IA est robuste et qu’elle peut gérer des entrées inattendues sans compromettre la sécurité.

Boîte à outils d’IA générative responsable de Google

Lorsqu’il s’agit d’affiner les modèles d’IA, les développeurs ont beaucoup de choses à prendre en compte. La boîte à outils souligne l’importance de créer un ensemble de données qui reflète toutes les politiques de contenu et couvre un large éventail de scénarios. Cette couverture complète est essentielle pour un entraînement approfondi des modèles. En outre, la boîte à outils insiste sur la nécessité de diversifier les données utilisées pour affiner le modèle. Cette diversité aide l’IA à répondre avec précision à un large éventail de requêtes.

Un autre point clé de la boîte à outils est l’élimination des données en double. Cette étape est cruciale pour améliorer l’efficacité de l’ensemble de données et les performances du modèle. Elle garantit que l’IA ne se contente pas de répéter les réponses, mais qu’elle fournit des résultats utiles et variés. En outre, la boîte à outils souligne l’importance de séparer les données d’évaluation des données de réglage. Cette séparation est essentielle pour éviter la contamination croisée et pour maintenir une évaluation impartiale du modèle d’IA.

Le traitement éthique des données est également un point important de la boîte à outils. Elle exige des instructions d’identifications claires et l’utilisation de groupes d’évaluateurs diversifiés pour minimiser les préjugés. Cette approche favorise l’équité et l’inclusivité des résultats produits par l’IA.

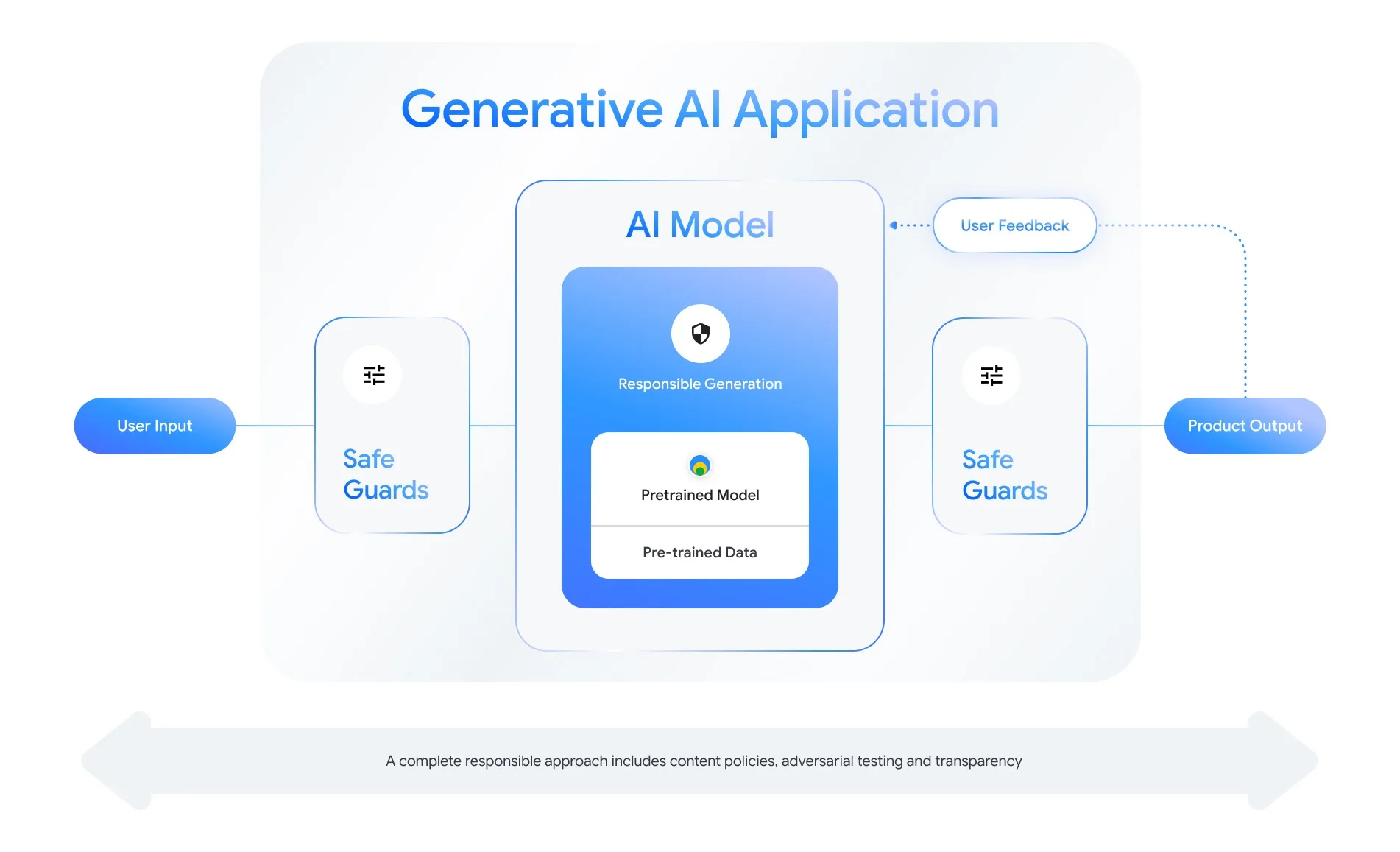

Pour protéger les données d’entrée et de sortie des modèles d’IA générative, les outils d’IA de Google présentent plusieurs stratégies. Ils suggèrent l’utilisation de modèles de prompts pour orienter l’IA vers des résultats plus sûrs et plus précis. La complexité de la création de prompts efficaces est reconnue et la boîte à outils fournit des conseils à cet égard. Les classificateurs de contenu, tels que l’API Perspective et le service de modération de texte de Google, sont recommandés pour empêcher la génération de contenu préjudiciable. Ces classificateurs agissent comme des gardiens, en veillant à ce que les entrées et les sorties de l’IA respectent les normes de sécurité.

Protocoles de sécurité

La boîte à outils traite également de l’évaluation des protocoles de sécurité. Elle souligne la nécessité de trouver un équilibre entre l’efficacité et l’absence de filtrage excessif, qui pourrait réduire l’utilité de l’application d’IA.

Les outils de Google pour une IA générative responsable offrent un cadre stratégique aux développeurs. Il encourage l’engagement en faveur de la qualité des données, l’utilisation de requêtes contradictoires pour le réglage fin et la mise en œuvre de mesures de sécurité strictes. Cette boîte à outils est prête à façonner l’avenir du développement de l’IA, en promouvant des pratiques éthiques et efficaces qui établissent une référence en matière d’IA responsable.