Alors que le lancement de son modèle open source était attendu cette semaine, OpenAI a annoncé un nouveau report de son modèle open source, cette fois sans date de sortie, invoquant la nécessité d’effectuer des tests de sécurité supplémentaires.

Dans un message publié vendredi sur X, Sam Altman, PDG d’OpenAI, a justifié cette décision par des considérations de sécurité : « Nous avons besoin de plus de temps pour exécuter des tests de sécurité additionnels et analyser les zones à haut risque. Nous ne savons pas encore combien de temps cela nous prendra ».

« Nous faisons confiance à la communauté pour faire de grandes choses avec ce modèle, mais, une fois les poids publiés, il est impossible de revenir en arrière. C’est une première pour nous, et nous voulons faire les choses correctement ».

Un modèle ouvert très attendu

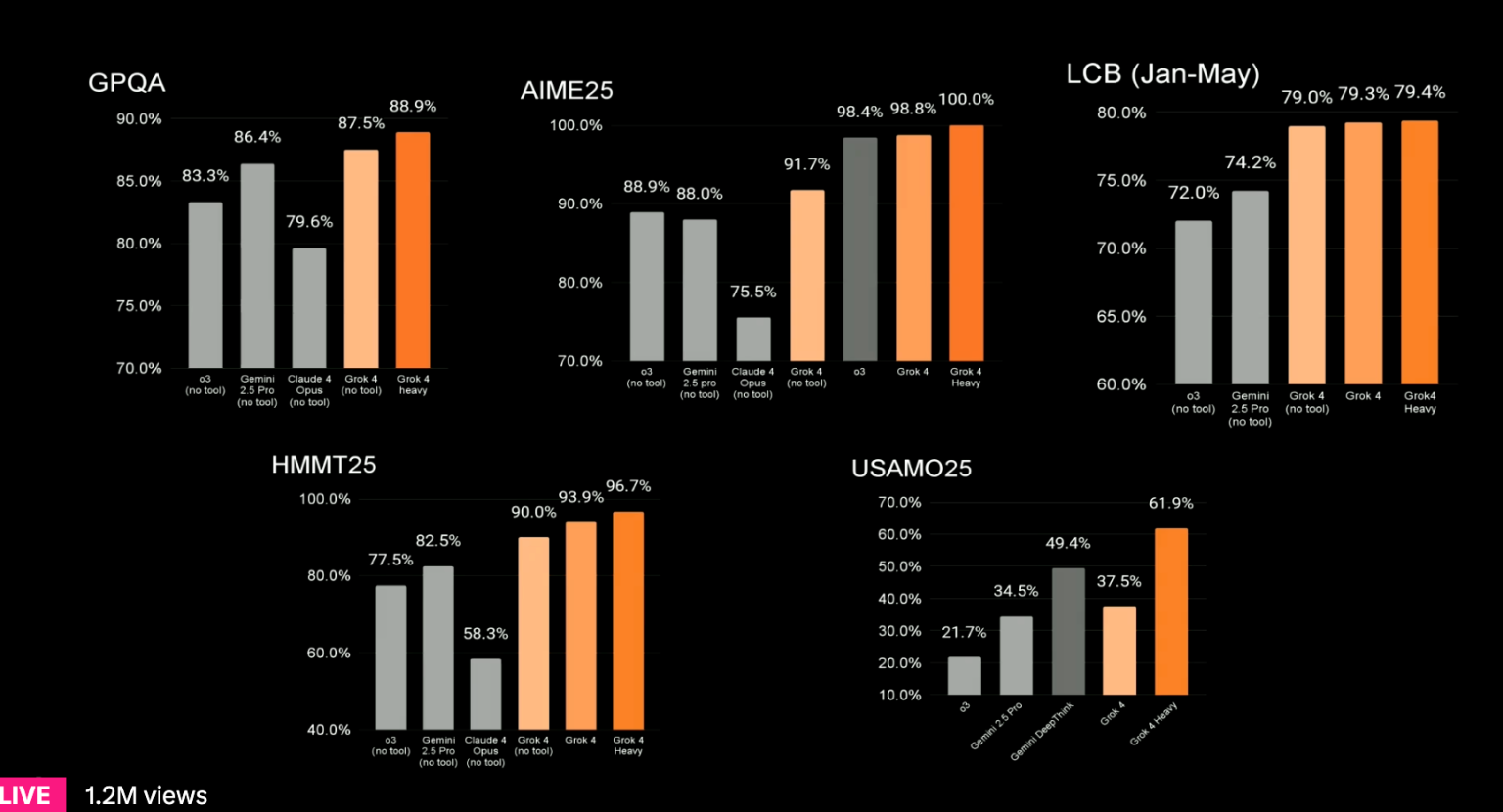

Ce modèle est le premier open source que OpenAI prévoit de publier depuis plusieurs années, dans un contexte de forte pression concurrentielle exercée par Anthropic, xAI (d’Elon Musk) et Google DeepMind.

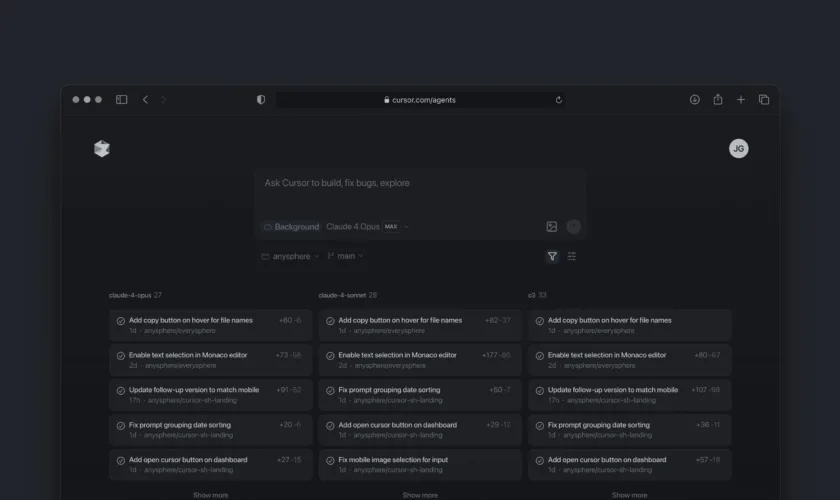

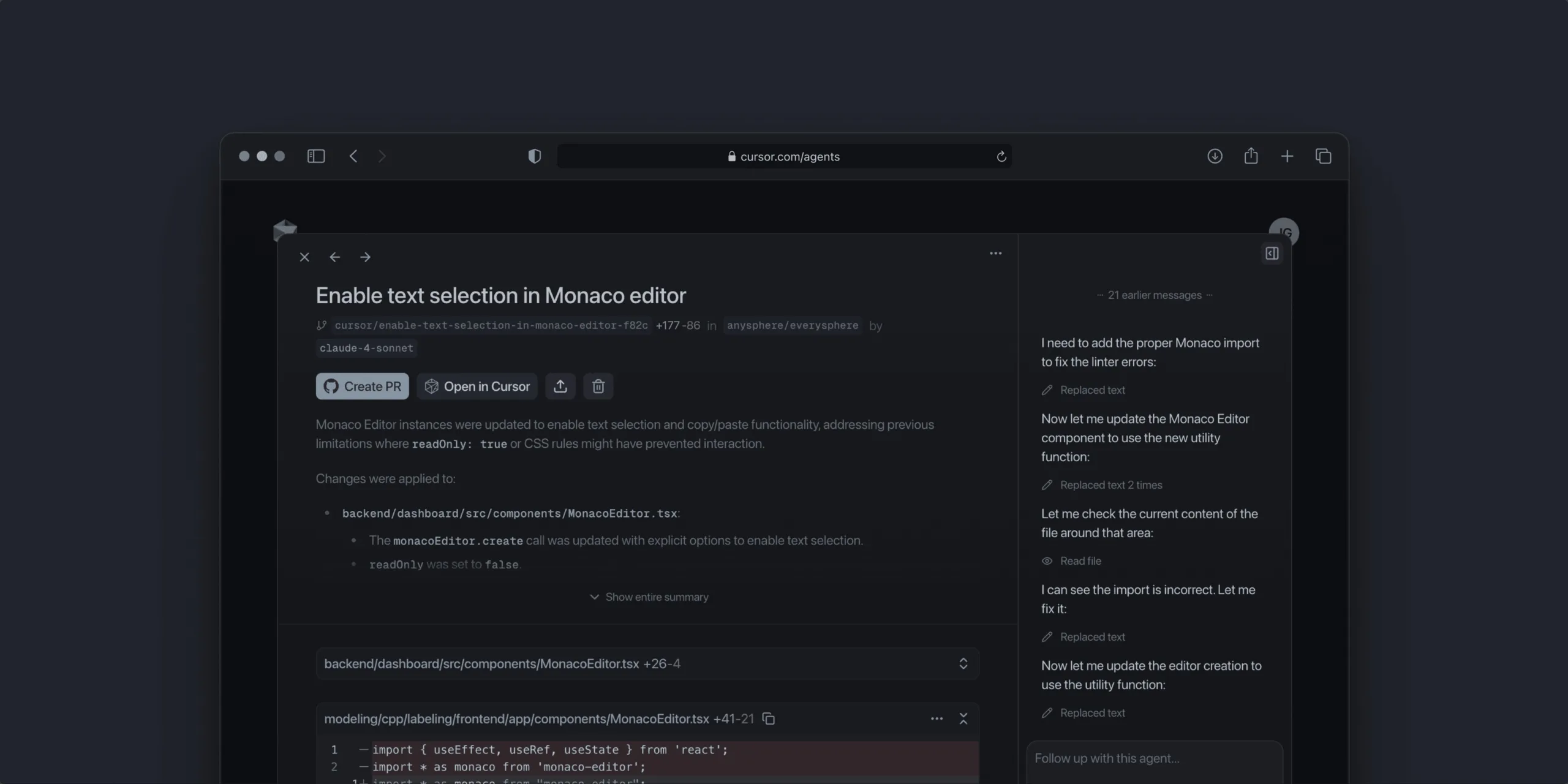

Contrairement à GPT-5, dont la sortie est également prévue cet été, ce modèle sera téléchargeable librement et pourra fonctionner en local, sans connexion aux serveurs d’OpenAI. Ce positionnement vise à séduire les développeurs et les chercheurs qui demandent plus de transparence et de contrôle sur les grands modèles d’IA.

Selon des fuites précédentes relayées par TechCrunch, ce modèle disposerait de capacités de raisonnement comparables à la série « o » d’OpenAI, tout en se positionnant comme un modèle de référence dans l’univers de l’open source.

Pourquoi ce report soudain ?

Ce n’est pas la première fois que le projet est retardé. En juin, Sam Altman avait déjà annoncé un report d’un mois, évoquant que les résultats obtenus par l’équipe étaient « inattendus et impressionnants », sans donner plus de détails.

Vendredi, Aidan Clark, vice-président de la recherche chez OpenAI et responsable du développement de ce modèle, a précisé : « En termes de capacités, nous pensons que ce modèle est phénoménal. Mais notre exigence pour un modèle open source est très élevée, et nous pensons avoir besoin d’un peu plus de temps pour nous assurer qu’il est irréprochable sur tous les plans ».

L’inquiétude principale réside dans le risque d’exploitation malveillante, notamment dans un contexte géopolitique tendu et face à des usages potentiellement sensibles, comme la désinformation, la cybersécurité ou la génération de contenus autonomes à grande échelle.

Une concurrence de plus en plus féroce

Ce report intervient alors que l’écosystème des modèles ouverts devient particulièrement compétitif. Pour OpenAI, le défi est désormais double : maintenir sa position de leader technologique dans un marché en pleine ébullition, et offrir des garanties de sécurité et d’éthique à la hauteur de ses ambitions.

Le choix de reporter la sortie d’un modèle aussi puissant est un signal fort envoyé à la communauté. Dans un contexte où l’ouverture des modèles est à la fois une opportunité et une menace, OpenAI fait le pari de la prudence plutôt que de la précipitation.

Mais ce report pourrait également laisser le champ libre à ses concurrents, plus agressifs sur le terrain des modèles ouverts. La balle est désormais dans le camp d’OpenAI, qui devra prouver que cette attente était justifiée… et qu’elle servira réellement la sécurité et la qualité.