Début janvier 2026, le ministère des Armées a officialisé un accord-cadre avec Mistral AI, la pépite parisienne de l’IA générative. Derrière la formule administrative, un message politique limpide : l’IA de défense ne sera pas un simple service loué à l’étranger, mais un socle technologique que la France veut garder « chez elle », sous contrôle national.

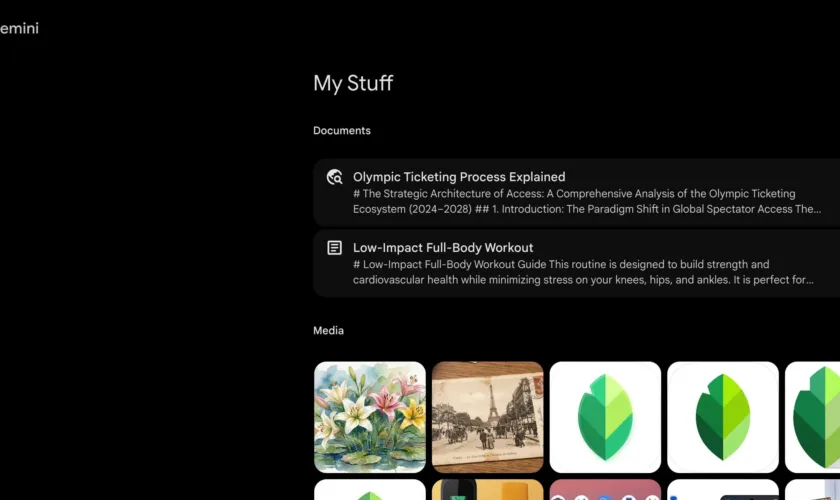

Une « clé d’accès » aux modèles Mistral pour tout un écosystème défense

L’accord ouvre l’usage des modèles, logiciels et prestations de Mistral à plusieurs niveaux : armées, directions et services du ministère, mais aussi un cercle d’organismes publics associés — dont la CEA, l’ONERA ou encore le SHOM (hydrographie/océanographie de la Marine).

Côté gouvernance, le dispositif est piloté par l’AMIAD (Agence ministérielle de l’IA de Défense), pensée pour accélérer l’intégration de l’IA tout en cadrant les exigences opérationnelles, de sécurité et d’éthique.

Le point clé : une IA « souveraine » hébergée sur infrastructure française

C’est la ligne rouge de l’accord : les solutions Mistral doivent être déployées sur des infrastructures françaises, et non dans des clouds commerciaux soumis à des juridictions étrangères. En défense, la nuance est tout sauf cosmétique : elle touche à la chaîne de confiance (données, entraînement, inférences, logs) et à la capacité de résister à des pressions extraterritoriales.

Autre détail important : le cadre prévoit la spécialisation des modèles avec des données « défense », pour produire des outils adaptés aux besoins opérationnels (analyse, aide à la décision, simulation, planification, etc.).

Pourquoi maintenant : l’IA devient un sujet de dépendance stratégique

Ce contrat s’inscrit dans une dynamique plus large : l’Europe cherche à réduire sa dépendance aux plateformes américaines dans les briques les plus sensibles (cloud, cybersécurité, IA). Mistral coche plusieurs cases : acteur européen, vélocité de recherche, capacité à déployer « on-prem », et image de champion local que les États peuvent mettre au cœur de politiques d’autonomie.

Dans les coulisses, cela ressemble aussi à une réponse au « réflexe procurement » qui dominait depuis dix ans : acheter un outil clé en main, souvent américain, et gérer ensuite le risque juridique et le risque d’exposition. Ici, la France tente l’inverse : choisir d’abord le cadre de souveraineté, puis construire les usages.

Ce que l’armée peut en faire (sans fantasmer « l’IA qui décide »)

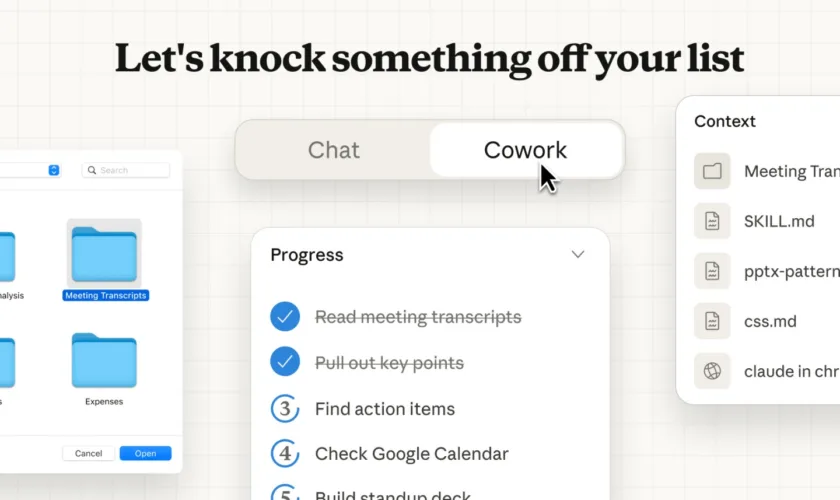

Les usages concrets ne sont pas détaillés publiquement, mais la logique d’un accord-cadre est justement d’ouvrir plusieurs chantiers, progressivement :

- tri et synthèse de volumes massifs de documents et de rapports,

- assistance à la planification (logistique, maintenance prédictive, préparation),

- analyse de signaux et de renseignements (avec toutes les précautions de validation),

- production d’outils internes (chat sécurisés, recherche sémantique, copilotes métiers).

La vraie valeur, en 2026, n’est pas un « super cerveau » militaire : c’est une IA intégrée aux flux, capable de faire gagner du temps à grande échelle — sans faire exploser les risques.

L’enjeu qui suit : industrialiser, auditer, sécuriser

Cet accord pose une promesse… et une contrainte. Car plus l’IA devient centrale, plus elle devient attaquable : prompt injections, exfiltration, contamination de données, dépendances logicielles, erreurs de raisonnement « plausibles ». La défense n’achète pas seulement un modèle : elle achète un système vivant, qu’il faut auditer, durcir, tester, mettre à jour.

Et ce mouvement dépasse Mistral : au même moment, Reuters rapporte une accélération du financement et de l’industrialisation des startups européennes de défense IA, signe que la bataille se joue autant sur le logiciel que sur les chaînes d’approvisionnement.

Dans l’IA, l’autonomie n’est jamais totale. Mais cet accord-cadre marque un glissement intéressant : la souveraineté n’est plus un slogan, elle devient une exigence d’architecture (hébergement, gouvernance, adaptation, contrôle). Si la France parvient à en faire un standard reproductible — achat public + industrialisation + sécurité — elle ne renforce pas seulement ses capacités : elle propose un modèle européen de déploiement.

La suite dépendra d’un facteur très simple : les résultats. Pas en démo, pas en discours — en production, sur des cas d’usage qui réduisent la friction sans augmenter le risque.