Alors que le lancement de GPT-5, le prochain modèle d’IA signé OpenAI, se profile à l’horizon, son PDG Sam Altman a récemment partagé des déclarations pour le moins inquiétantes. Lors d’un podcast relayé par TechRadar, il a comparé les travaux en cours sur GPT-5 à ceux du Projet Manhattan — le programme américain de développement de la bombe atomique durant la Seconde Guerre mondiale.

Ce parallèle n’est pas anodin : il reflète l’ambivalence croissante entre fascination technologique et crainte des dérives éthiques.

Selon Altman, GPT-5 est si puissant et si rapide que même ses créateurs en sortent « nerveux », dépassés par l’ampleur des capacités démontrées lors des premières phases de test.

GPT-5 : entre révolution technique et vertige existentiel

Selon les confidences de Sam Altman, chaque session de test du modèle serait un moment de tension, où l’enthousiasme cède la place à l’inquiétude. Le PDG n’a pas hésité à parler de scènes qui relèvent du thriller technologique plutôt que d’une simple avancée produit. Il souligne une chose essentielle : même OpenAI ne semble plus totalement en contrôle de ce qu’elle est en train de construire.

L’émergence de GPT-5 est donc perçue comme une rupture de niveau historique, au même titre que d’autres jalons technologiques majeurs qui ont bouleversé notre monde.

Sauf que cette fois-ci, l’enjeu touche à la nature même de l’intelligence.

« Il n’y a pas d’adultes dans la pièce » : l’absence de régulation pointée du doigt

Ce qui inquiète le plus Altman, ce n’est pas uniquement le modèle lui-même, mais l’absence criante de gouvernance globale autour de l’IA. Il déplore que la course au progrès technologique se fasse sans garde-fous solides, dans un contexte où aucune autorité régulatrice mondiale ne semble pouvoir encadrer efficacement l’essor fulgurant de ces technologies.

Ce discours rappelle ses interventions passées, notamment en 2023 devant le Congrès américain, où il mettait en garde contre le risque que l’intelligence artificielle puisse causer des dommages massifs si elle était mal utilisée.

GPT-5 : une promesse… et un danger potentiel

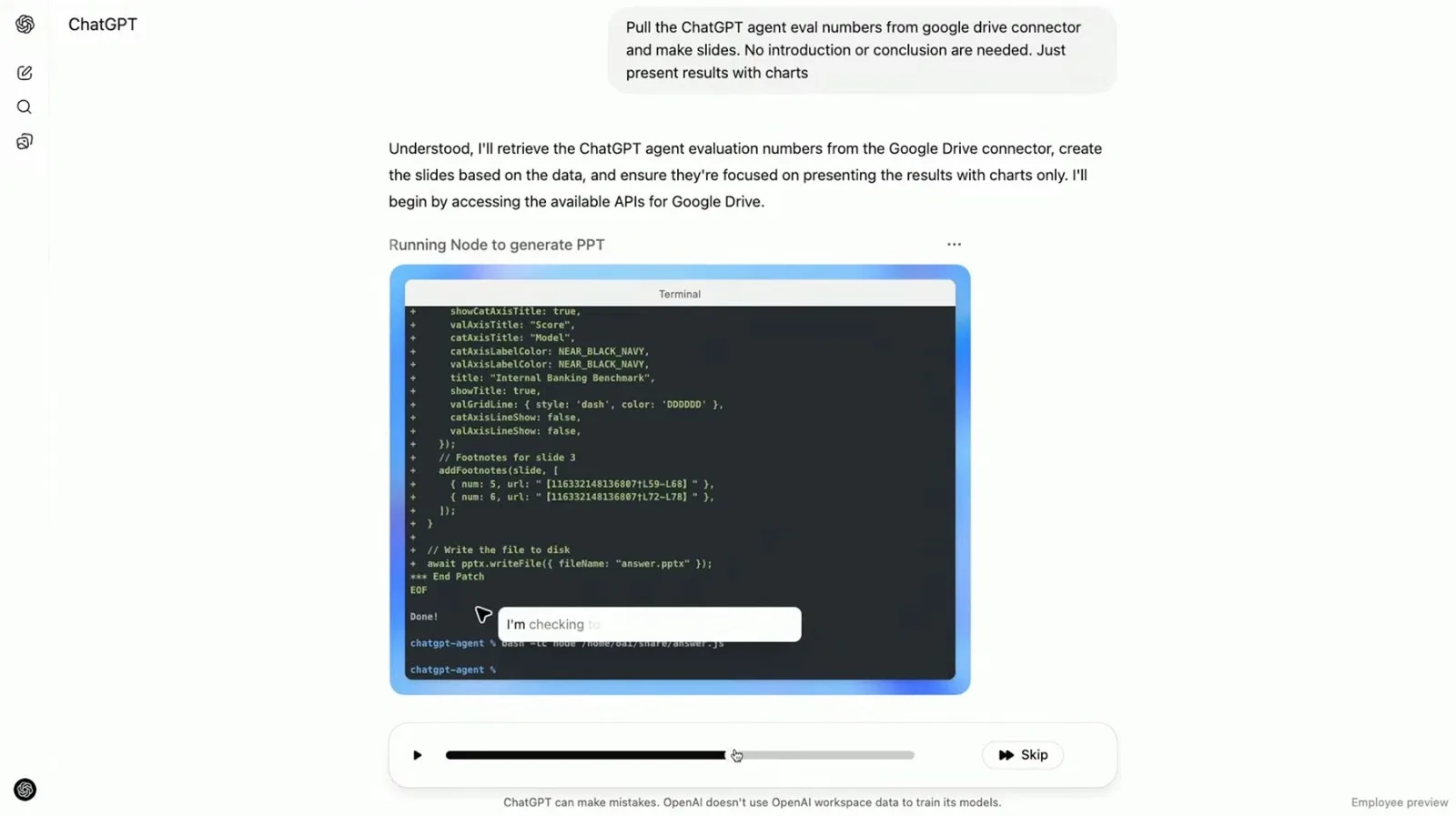

Depuis le lancement de GPT-4 en 2023, chaque nouvelle itération des modèles d’OpenAI repousse les limites du traitement du langage naturel et du raisonnement contextuel. GPT-5 s’annonce encore plus impressionnant, avec des capacités de réflexion logique poussées, des variantes spécialisées par domaines, et un moteur encore plus autonome.

Cependant, ce bond technologique pose de nombreuses questions :

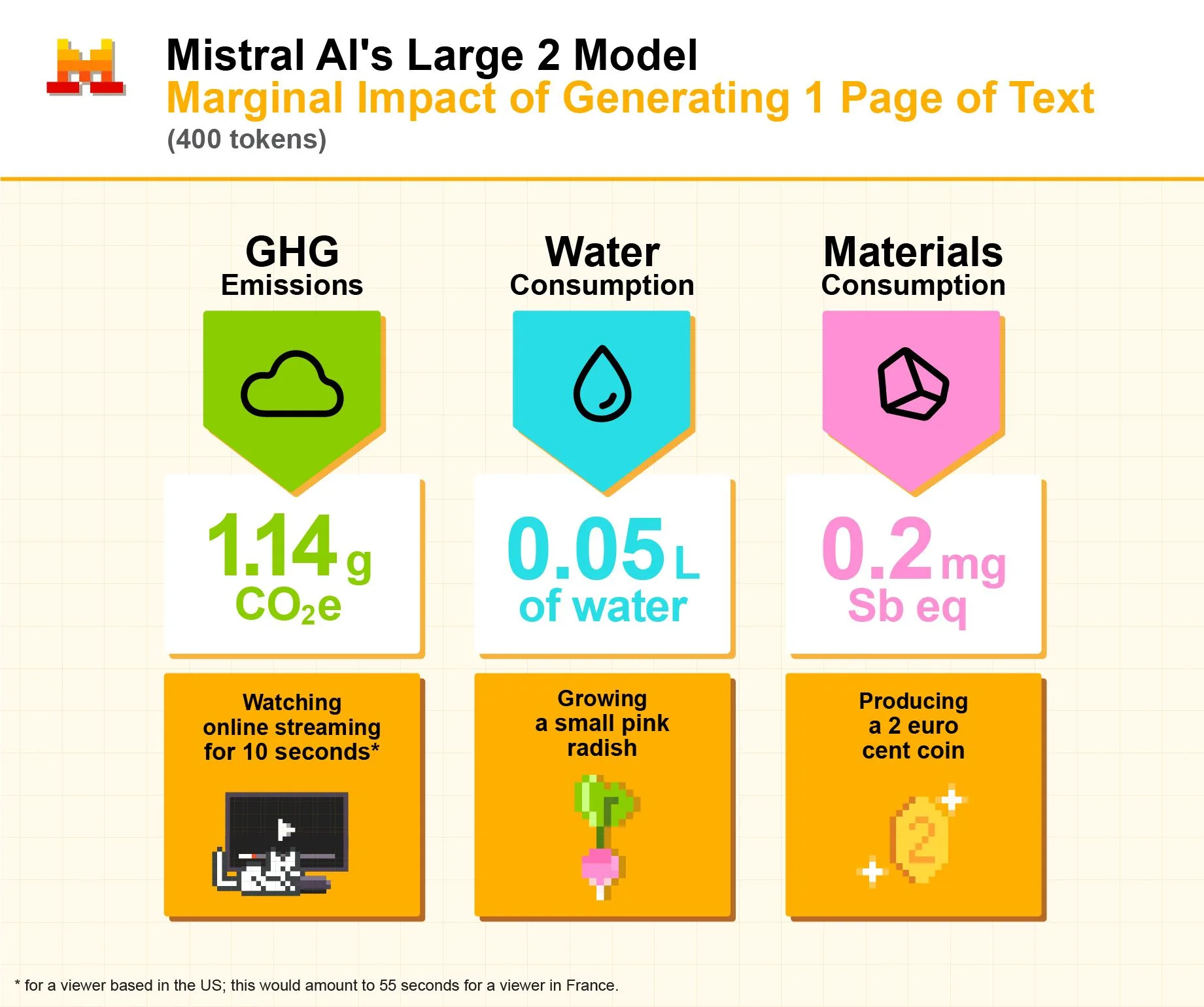

- L’infrastructure technique : chaque nouvelle génération de modèle demande 100 fois plus de puissance de calcul, mettant à rude épreuve les centres de données.

- La protection des données : Altman a récemment exprimé ses inquiétudes face à l’usage décomplexé de ChatGPT par les jeunes, qui partagent parfois des informations très personnelles.

- La dépendance cognitive : l’idée que des millions de personnes prennent des décisions importantes sur la base de conseils générés par une IA est, selon lui, « mauvaise et dangereuse ».

Gouvernance, transparence et responsabilité : un appel urgent

Dans ce contexte, le parallèle avec le Projet Manhattan prend tout son sens. Là où les scientifiques de l’époque se débattaient avec l’éthique de l’arme nucléaire, les ingénieurs d’aujourd’hui sont confrontés à une intelligence artificielle autonome, évolutive, et potentiellement incontrôlable.

Des initiatives telles que les Content Credentials (métadonnées attachées aux images générées pour garantir la transparence) vont dans le bon sens, mais elles restent insuffisantes face à l’ampleur du défi. Il est donc impératif de mettre en place :

- Un cadre réglementaire international fort.

- Des règles éthiques contraignantes sur l’utilisation des modèles.

- Un dialogue actif entre chercheurs, législateurs et citoyens pour redéfinir ce que doit être une IA « responsable ».

Lancement de GPT-5 : à quoi s’attendre ?

Selon certaines sources industrielles, GPT-5 pourrait être lancé dès août 2025, même si aucune date n’a été confirmée par OpenAI. Il est attendu avec :

- Une capacité de raisonnement améliorée.

- Des modèles spécialisés (en droit, code, médecine…).

- Une gestion plus fine des projets longs ou multi-étapes.

Mais cette avancée pourrait aussi s’accompagner d’une polarisation du marché, alors que Meta (Llama 4) et Google (Gemini) affûtent leurs propres modèles pour contrer l’hégémonie d’OpenAI.

Sam Altman nous adresse un message clair et dérangeant : le futur de l’IA ne sera pas simplement une extension de l’intelligence humaine. Il pourrait bien devenir quelque chose d’autre, de plus autonome, plus opaque, et peut-être hors de contrôle.

Face à ce constat, le rôle des citoyens, des développeurs, des régulateurs et des institutions n’a jamais été aussi crucial. GPT-5 ne sera pas seulement un outil ; il pourrait être le catalyseur d’un tournant civilisationnel. À nous de décider dans quelle direction nous souhaitons aller.