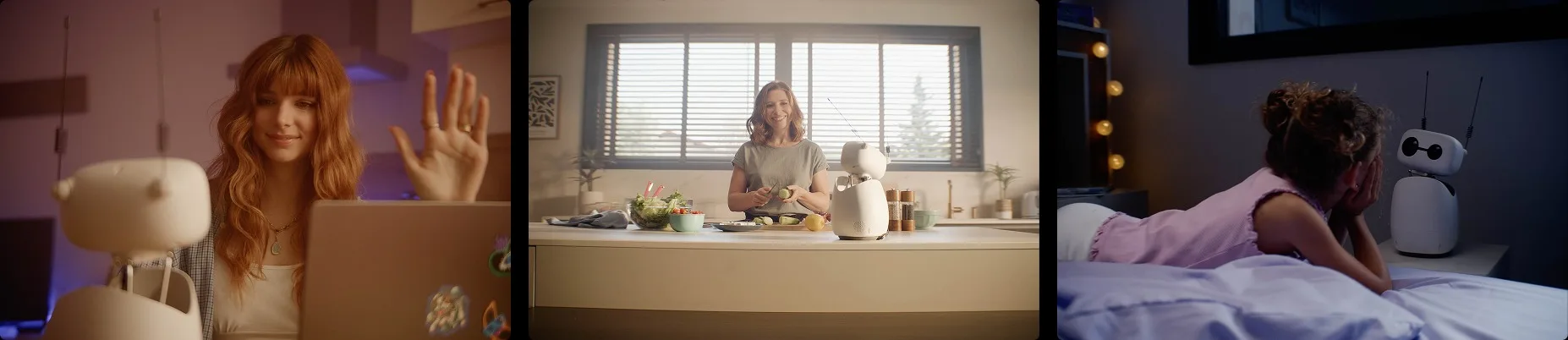

Connu pour sa plateforme d’intelligence artificielle open source, Hugging Face fait un pas de plus vers le monde physique avec Reachy Mini, un petit robot de bureau conçu pour les développeurs et les passionnés de programmation.

L’objectif ? Offrir un compagnon interactif, personnalisable et surtout accessible pour découvrir la robotique et l’IA de manière ludique.

Un robot de table pour coder, expérimenter… et s’amuser

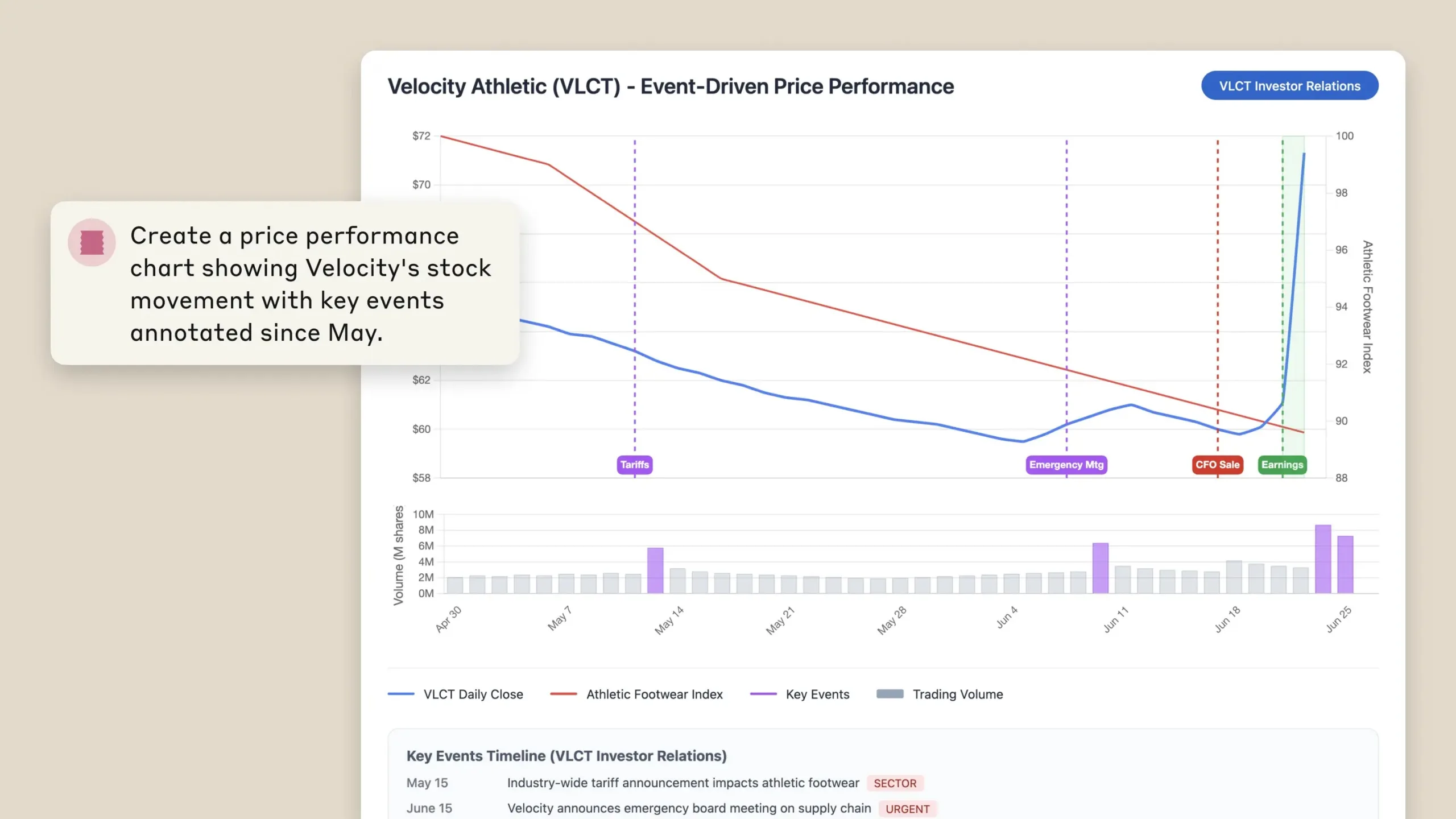

Reachy Mini est un robot compact d’environ 28 cm de haut pour 1,5 kg, doté d’une tête mobile avec 6 degrés de liberté, d’une caméra grand angle, et de haut-parleurs stéréo 5W. Il peut bouger, suivre les gestes d’un utilisateur, réagir au son, danser… mais aussi être entièrement reprogrammé.

« Reachy Mini est une porte d’entrée dans la robotique et l’intelligence artificielle, pensée pour les étudiants, les makers, les chercheurs, ou simplement les curieux », décrit la société.

Ce robot s’adresse à une communauté de développeurs et makers désireux de concevoir leurs propres comportements robotiques, via des scripts Python et des interfaces API. Hugging Face mise ici sur la programmation participative et communautaire, dans la lignée de son ADN open source.

Deux versions disponibles : Lite ou complète

Le robot est proposé en précommande dans deux configurations :

Reachy Mini Lite — 299 dollars

- Fonctionne via un ordinateur connecté en USB (Mac ou Linux ; Windows à venir)

- Pas de batterie, ni Wi-Fi

- 2 microphones (contre 4 pour la version complète)

- Pas d’accéléromètre

- Aucune autonomie : nécessite un PC pour fonctionner

Reachy Mini — 449 dollars

- Intègre un Raspberry Pi 5 pour une autonomie totale

- Connectivité Wi-Fi intégrée

- Batterie interne rechargeable

- 4 microphones pour une meilleure captation

- Accéléromètre pour détecter les mouvements ou inclinaisons

Cette version est capable de fonctionner de manière autonome, sans avoir besoin d’être reliée à un ordinateur, ce qui en fait un vrai petit assistant robotique mobile.

Encore limité… mais prometteur

À ce stade, Reachy Mini ne propose qu’une quinzaine de comportements préconfigurés : il peut bouger la tête, suivre une main, réagir à la musique, ou simplement faire une danse robotique. Mais Hugging Face insiste : le robot est encore en phase expérimentale.

« Reachy Mini est un projet en développement précoce. Il est livré tel quel, sans garantie, pour favoriser les retours des early adopters. »

L’ambition est de co-construire les usages avec la communauté, en misant sur l’ouverture du code et la créativité des utilisateurs. Le robot pourrait évoluer très vite si les développeurs s’en emparent.

⸻

📦 Disponibilité et livraison

• Reachy Mini Lite sera livré cet été 2025

• Reachy Mini (avec Raspberry Pi 5) sera expédié en lots à l’automne 2025

• Les précommandes sont ouvertes sur le site officiel de Hugging Face

⸻

📝 Conclusion : un petit robot pour les grands curieux

Avec Reachy Mini, Hugging Face apporte une alternative ludique et accessible à la robotique éducative, bien plus fun et abordable que les bras robotiques industriels ou les kits Arduino complexes. Ce n’est pas un gadget fermé, mais une plateforme pour apprendre, bidouiller, expérimenter et partager.

C’est aussi une manière pour Hugging Face de relier le monde virtuel des modèles IA à un support physique tangible, à la croisée de l’apprentissage, de la recherche et du jeu.