Les employés de la génération Z recherchent le support du chatbot d’intelligence artificielle (IA) ChatGPT alors qu’ils naviguent dans leurs premières années dans le monde professionnel.

Cette génération est l’une de celles qui connaissent la croissance la plus rapide sur le marché du travail, mais elle ne serait pas en confiance en ses supérieurs et qu’elle n’a pas d’expérience avec eux.

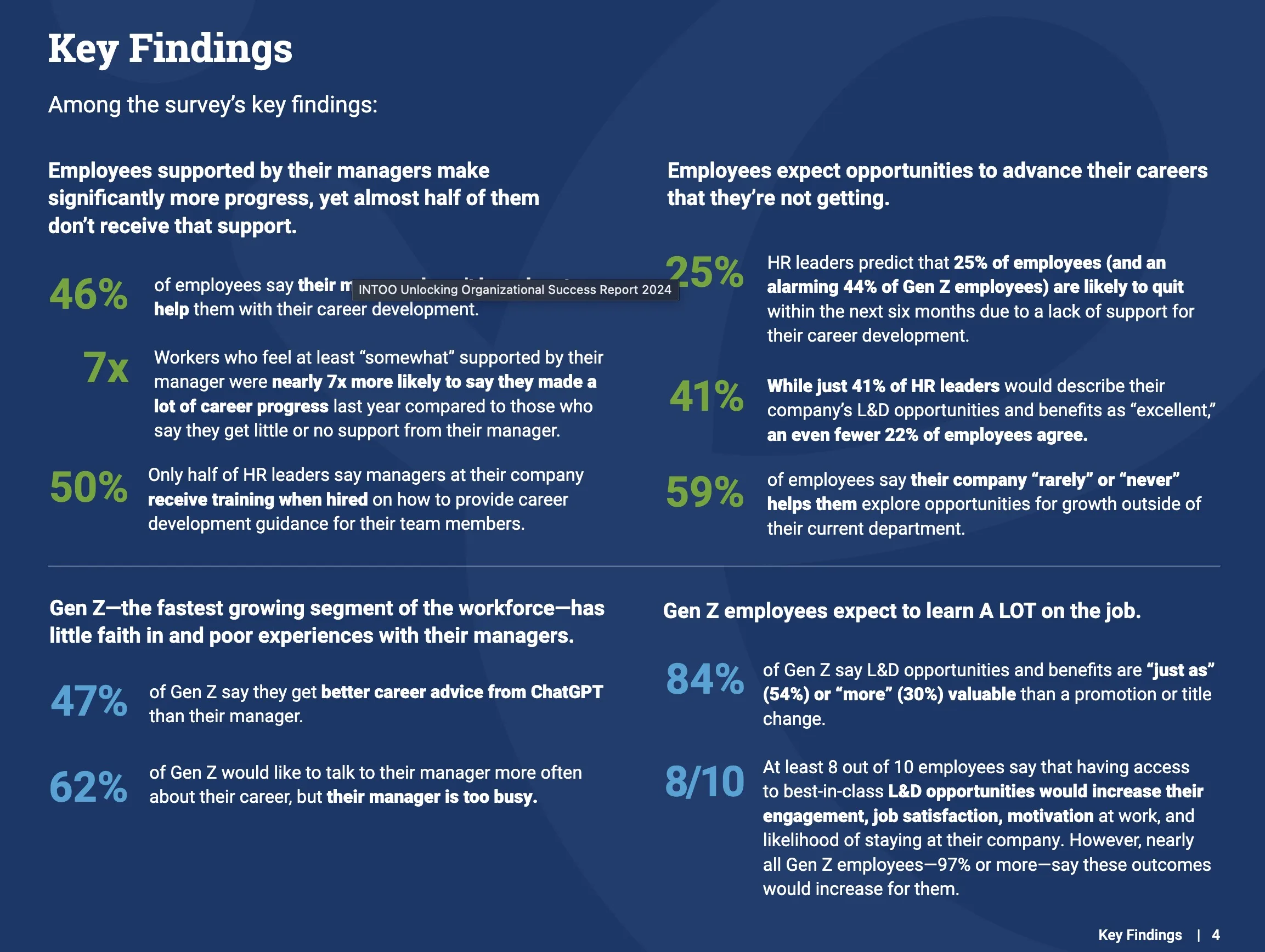

Les salariés nés entre 1997 et 2012 déclarent obtenir de meilleurs conseils en matière de carrière auprès de leurs amis et de leur famille, de Google, des réseaux sociaux et de l’IA. Près de la moitié d’entre eux (47 %) ont déclaré préférer se tourner vers le ChatGPT, car les managers « ne se soucient pas de leur développement de carrière », selon un rapport d’INTOO et de Workplace Intelligence.

D’autres problèmes fréquemment signalés avec les managers sont qu’ils sont « plus concentrés sur leur propre carrière » et qu’ils « ne savent pas comment aider » au développement de leur rôle. Un nombre significatif de participants, soit 62 %, déclarent qu’ils aimeraient parler plus souvent de leur carrière à leur supérieur, mais que celui-ci est trop occupé.

Ces jeunes adultes recherchent un soutien supplémentaire de la part des entreprises, mais ils demandent plus que ce que les équipes d’apprentissage et de développement offrent actuellement. 80 % des salariés pensent que les employeurs devraient proposer des cours d’auto-apprentissage, alors que seulement 49 % des entreprises ont cette idée en tête.

Les professionnels des ressources humaines prévoient qu’un quart des salariés quitteront probablement leur emploi dans les 6 prochains mois en raison d’un manque de soutien à leur carrière, car ils ne sont pas satisfaits des possibilités offertes pour les aider à progresser dans leur vie professionnelle. Ce chiffre passe à 44 % lorsqu’il s’agit de la génération Z.

Comment les managers peuvent-ils soutenir la génération Z ?

Alors que de plus en plus d’adolescents et de vingtenaires entrent sur le marché du travail, les consultants en ressources humaines invitent les managers actuels à se rappeler que chaque personne a des besoins différents.

Dans un entretien accordé à CNBC, Stacie Haller, conseillère en chef chez Resume Builder, explique les mesures à prendre : « Lorsque les nouveaux employés entrent dans l’entreprise, il faut discuter avec eux de leurs aspirations, de leurs objectifs à long terme. Cela devrait faire partie de leur intégration ».

Les programmes de mentorat sont une autre recommandation pour guider les travailleurs tout au long de leur parcours dans le monde de l’entreprise.