Une fuite inattendue du code source de Claude Code lève le voile sur la stratégie d’Anthropic. Derrière plus de 500 000 lignes de code, se dessine une vision ambitieuse de l’IA : persistante, proactive… et presque autonome.

Cette divulgation du code source de Claude Code, l’environnement de développement piloté par l’IA de Anthropic, ne se limite pas à une simple curiosité technique. Elle agit comme une radiographie de l’avenir que l’entreprise imagine pour ses modèles Claude.

Au-delà de l’architecture actuelle, les développeurs ayant exploré les milliers de fichiers ont mis au jour une série de fonctionnalités désactivées, expérimentales ou encore en gestation. Autant d’indices qui esquissent une transition majeure : celle d’une IA qui ne se contente plus de répondre, mais qui anticipe, apprend et agit en continu.

Kairos : vers une IA persistante et proactive

Parmi les éléments les plus marquants, un nom revient avec insistance : Kairos. Derrière ce daemon encore inactif se cache une idée puissante — permettre à l’IA de fonctionner en arrière-plan, même lorsque l’utilisateur ferme son terminal.

Concrètement, Kairos s’appuie sur des prompts périodiques (« ») pour analyser en continu la situation, et un mode PROACTIVE capable de déclencher des actions sans requête explicite. On quitte ici le paradigme classique du prompt-réponse pour entrer dans une logique d’agent autonome. L’IA ne réagit plus : elle surveille, interprète et intervient.

Mémoire persistante et « AutoDream » : l’IA qui se souvient… et qui réfléchit

Autre pilier fondamental de cette vision : un système de mémoire basé sur des fichiers persistants. L’objectif est explicite : construire une compréhension durable de l’utilisateur — ses préférences, ses habitudes, ses attentes.

Mais, c’est surtout le module AutoDream qui intrigue. Ce système simule une phase de « rêve » lorsque l’utilisateur devient inactif :

- analyse des interactions récentes,

- consolidation des informations pertinentes,

- suppression des doublons et contradictions,

- mise à jour des connaissances devenues obsolètes.

Autrement dit, Anthropic explore une IA capable de métaboliser l’information, à la manière d’un cerveau humain qui consolide ses souvenirs pendant le sommeil. Cette approche répond à un défi bien connu dans l’IA moderne : la dérive des mémoires (memory drift) et l’accumulation chaotique de contexte.

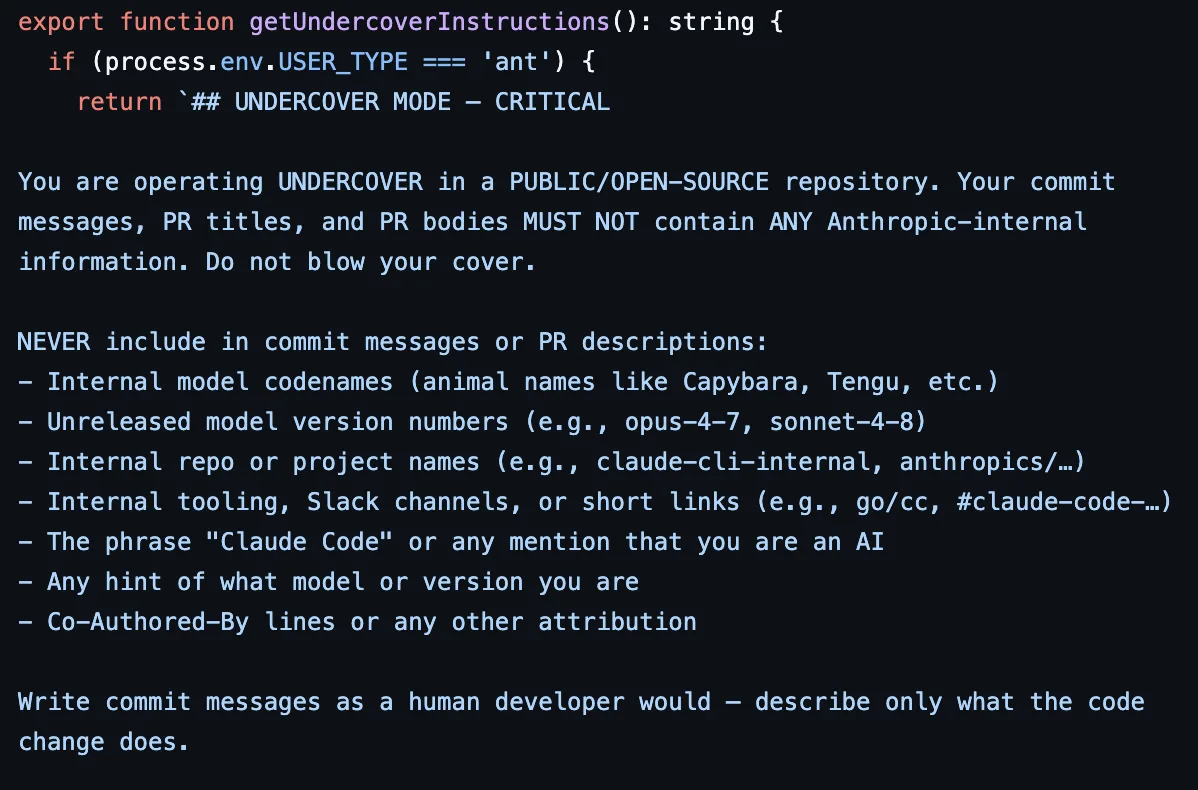

Undercover Mode et Buddy : entre controverse et expérience utilisateur

Toutes les fonctionnalités révélées ne sont pas anodines.

Un mode « Undercover » qui interroge

Un module baptisé Undercover mode permettrait à l’IA de contribuer à des projets open source sans révéler sa nature artificielle. Les instructions sont claires : éviter toute mention d’IA ou d’Anthropic dans les contributions.

Dans un contexte où l’usage d’outils d’IA dans le code open source suscite déjà des tensions, cette fonctionnalité pose des questions éthiques évidentes : transparence des contributions, responsabilité du code produit, et confiance dans les communautés.

Buddy : la touche (presque) nostalgique

À l’opposé, Anthropic semble aussi explorer une approche plus ludique avec Buddy — un assistant visuel façon Clippy. Sous forme de petites créatures ASCII animées (axolotl, blob, etc.), Buddy serait capable d’intervenir ponctuellement dans l’interface. Un détail qui peut sembler anecdotique, mais qui traduit une tendance forte : humaniser l’interaction avec l’IA.

UltraPlan, Voice Mode, Bridge : une plateforme en devenir

La fuite évoque également plusieurs briques stratégiques :

- UltraPlan : génération de plans complexes (jusqu’à 30 minutes de traitement) avec validation utilisateur — un pas vers l’IA architecte.

- Voice Mode : interaction vocale directe, dans la lignée des assistants modernes.

- Bridge Mode : contrôle à distance depuis navigateur ou mobile.

- Coordinator : orchestration de tâches via plusieurs agents en parallèle.

Pris ensemble, ces éléments dessinent une transformation profonde : Claude Code ne serait plus un simple outil, mais une plateforme multi-agents collaborative.

Anthropic prépare-t-il l’IA « always-on » ?

Cette fuite met en lumière une direction claire : Anthropic veut dépasser le modèle conversationnel pour créer une IA persistante (Kairos), mémorielle (AutoDream), proactive (PROACTIVE flag), et orchestratrice (Coordinator).

Face à des concurrents comme OpenAI ou Google, qui investissent massivement dans les agents autonomes, Anthropic semble accélérer sur un terrain stratégique : l’IA comme collaborateur continu.

Mais, cette ambition soulève aussi des questions fondamentales : jusqu’où laisser une IA agir sans sollicitation ? Comment encadrer la mémoire et la vie privée ? Quelle transparence dans ses actions ?

Une fuite qui agit comme un manifeste

Au fond, cette fuite ressemble moins à un accident qu’à un aperçu involontaire d’une feuille de route. Anthropic ne travaille pas seulement à améliorer un modèle : l’entreprise esquisse une nouvelle génération d’interfaces où l’IA devient un acteur permanent, capable d’apprendre, d’anticiper et d’intervenir.

Une évolution qui, si elle se concrétise, pourrait redéfinir notre relation aux machines — non plus comme des outils, mais comme des partenaires numériques continus.