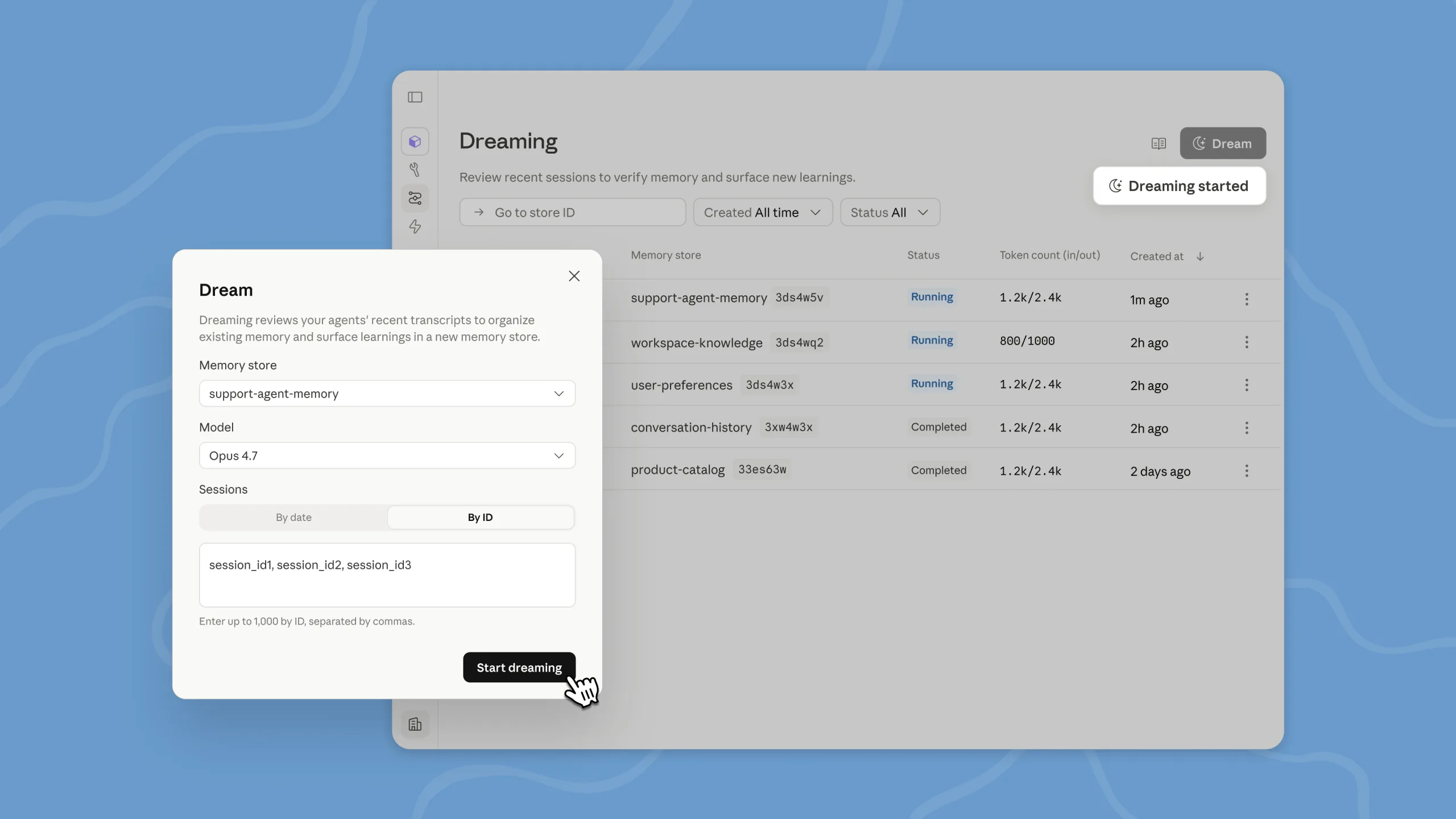

Anthropic ajoute une fonction étonnamment nommée « dreaming » à Claude Managed Agents. Derrière le terme poétique, l’idée est très concrète : permettre aux agents de relire leurs anciennes sessions, d’identifier les informations utiles et de mieux organiser leur mémoire pour les tâches futures.

Une mémoire plus propre pour les agents IA

Présentée lors de la conférence Code with Claude, la fonction dreaming arrive en research preview dans Claude Managed Agents. Elle analyse les sessions passées et les mémoires existantes pour repérer des schémas récurrents, des préférences ou des erreurs répétées, puis conserver ce qui peut réellement améliorer les prochaines interactions.

L’objectif est simple : éviter que les agents accumulent des souvenirs obsolètes, contradictoires ou redondants au fil des projets longs.

Plus qu’un simple résumé de conversation

Contrairement à la « compaction » classique, qui résume une conversation longue pour préserver le contexte, dreaming fonctionne à une échelle plus large. Le système peut examiner plusieurs sessions, plusieurs agents et plusieurs mémoires pour faire émerger des tendances qu’un agent isolé ne verrait pas forcément.

C’est particulièrement utile pour les workflows complexes, où plusieurs agents collaborent pendant plusieurs minutes ou heures sur un même objectif.

Anthropic pousse l’IA agentique plus loin

Cette annonce s’inscrit dans une offensive plus large autour de Claude Managed Agents. Anthropic rend aussi plus disponibles les fonctions outcomes, multi-agent orchestration et webhooks, afin de mieux piloter des agents capables d’exécuter des tâches avec moins d’intervention humaine.

La promesse est claire : passer d’un assistant qui répond à un système qui apprend, coordonne et s’améliore entre deux sessions.

Une avancée puissante, mais sensible

La mémoire est l’un des grands enjeux des agents IA. Trop courte, elle rend l’assistant incohérent. Trop large, elle devient bruyante, risquée et difficile à contrôler.

Avec dreaming, Anthropic tente de trouver un équilibre : une mémoire plus sélective, plus utile, mais encore supervisable. Les développeurs pourront choisir entre un processus automatique ou une validation manuelle des changements mémorisés.

À mesure que les agents deviennent plus autonomes, leur capacité à oublier intelligemment comptera presque autant que leur capacité à apprendre.