Les modèles locaux sortent doucement de leur niche d’initiés, et Ollama semble bien décidé à capter ce moment. La plateforme, déjà devenue une référence pour exécuter de grands modèles de langage en local, vient d’annoncer une évolution particulièrement stratégique : une prise en charge en préversion du framework MLX d’Apple, pensée pour exploiter plus efficacement les Mac équipés de puces Apple Silicon.

Dans le même mouvement, Ollama met aussi en avant une amélioration du cache et l’arrivée du support NVFP4 côté Nvidia pour mieux compresser certains modèles et réduire leur empreinte mémoire.

Sur le fond, cette mise à jour dit quelque chose de plus large que la simple optimisation technique. Elle montre que l’IA local n’est plus seulement un terrain d’expérimentation pour chercheurs ou hobbyistes. Il commence à devenir une réponse crédible, au moins pour certains usages, à la lassitude croissante face aux abonnements premium, aux limites d’usage et aux coûts des assistants cloud.

MLX, ou la promesse d’un Ollama enfin taillé pour Apple Silicon

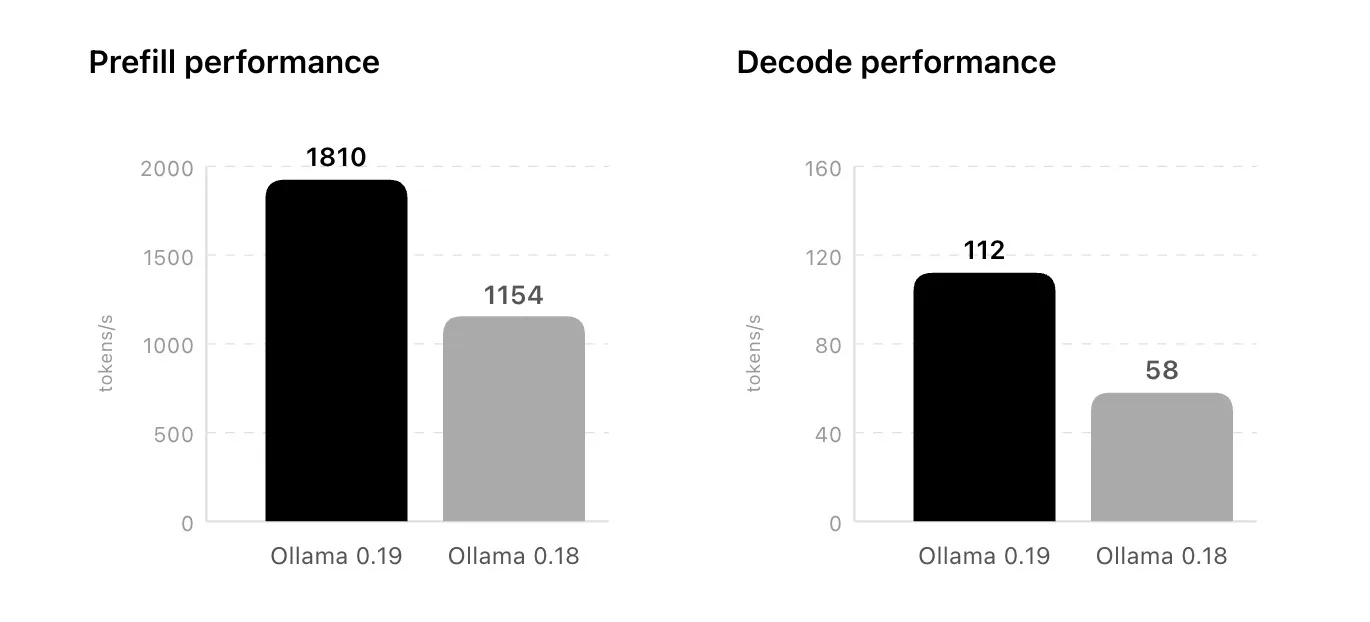

Dans son annonce officielle du 30 mars 2026, Ollama présente MLX comme « la manière la plus rapide » de faire tourner Ollama sur Apple Silicon en préversion. MLX est le framework open source d’Apple pour le machine learning, conçu pour tirer parti de l’architecture mémoire unifiée des puces maison. Ollama explique que cette intégration vise précisément à mieux exploiter cette particularité matérielle des Mac récents.

Ce point est essentiel. Là où beaucoup d’outils IA locaux ont d’abord été pensés autour de machines avec GPU dédié, MLX permet à Ollama de mieux s’adapter à une logique différente, celle des Mac modernes où CPU et GPU partagent la mémoire.

En clair, Ollama cherche ici moins à « porter » son runtime sur Mac qu’à réellement l’optimiser pour la façon dont Apple conçoit ses machines.

Une préversion encore limitée, mais déjà très exigeante

Pour l’instant, cette prise en charge MLX reste en preview dans Ollama 0.19 et ne prend en charge qu’un seul modèle : la variante de 35 milliards de paramètres de Qwen3.5 d’Alibaba, dans une version orientée code. Ollama précise aussi que le matériel requis reste élevé pour un usage grand public : il faut un Mac Apple Silicon et au moins 32 Go de mémoire.

Autrement dit, nous ne sommes pas encore dans une démocratisation totale du local AI sur Mac. On parle plutôt d’une avancée qui profite d’abord aux utilisateurs déjà bien équipés, notamment les développeurs ou créateurs qui ont investi dans des configurations Apple Silicon musclées.

Les Mac les plus récents sont particulièrement visés

Ollama ajoute également qu’il tire parti des nouveaux Neural Accelerators présents dans les GPU de la série M5, avec à la clé des gains sur le débit en tokens par seconde et sur le temps avant première réponse. Cela place très clairement les Mac les plus récents au centre de cette nouvelle étape.

Ce détail n’est pas anodin. Il confirme que la bataille de l’IA local ne se jouera pas seulement sur les modèles, mais aussi sur la manière dont chaque écosystème matériel expose ses accélérateurs. Apple, longtemps perçu comme moins naturel pour ce type d’usages que les PC à GPU Nvidia, essaie peu à peu de devenir une plateforme plus sérieuse pour l’inférence locale.

NVFP4 et cache amélioré : Ollama optimise aussi l’autre front, celui de la mémoire

L’annonce ne se limite pas à Apple. Ollama indique aussi prendre en charge NVFP4, un format de compression lié à l’écosystème Nvidia, pour améliorer l’efficacité mémoire sur certains modèles. En parallèle, l’entreprise dit avoir revu ses performances de cache. Ensemble, ces optimisations doivent permettre une exécution plus efficace de modèles lourds, notamment sur des machines contraintes en mémoire vidéo.

C’est une évolution importante, car dans le local AI, la vraie barrière n’est pas seulement la puissance brute. C’est souvent la capacité à faire tenir un modèle dans la mémoire disponible, sans effondrement des performances ni bricolage excessif. En ce sens, Ollama continue de travailler sur le point le plus concret du sujet : rendre l’inférence locale moins punitive à matériel constant. Cette lecture est une analyse, fondée sur les optimisations de compression et de cache annoncées.

Le contexte n’a jamais été aussi favorable au local AI

Le timing de cette annonce compte beaucoup. Le succès spectaculaire de OpenClaw a remis les agents et les modèles locaux au centre de la conversation. Les chiffres exacts varient selon les sources, mais plusieurs publications crédibles le décrivent comme l’un des projets open source les plus rapides de l’histoire récente, avec plus de 250 000 étoiles GitHub au début de mars 2026 et une adoption particulièrement remarquée dans certains milieux techniques.

En parallèle, Ollama a continué d’étendre ses intégrations côté développement. Sa documentation montre désormais une connexion plus claire avec VS Code, où les modèles Ollama peuvent être utilisés dans le sélecteur de modèles du chat IA.

L’ensemble dessine un paysage nouveau : les développeurs ne regardent plus seulement les modèles cloud comme une évidence. Entre les limitations, le coût et la recherche de confidentialité, beaucoup recommencent à se demander jusqu’où une machine locale peut suffire.

Les modèles locaux restent derrière les meilleurs services cloud, mais l’écart devient moins disqualifiant

Il faut évidemment garder la tête froide. Les modèles locaux les plus accessibles restent globalement derrière les meilleurs modèles cloud sur les benchmarks les plus exigeants, et le setup continue de demander un certain niveau technique. Ollama lui-même reste avant tout un outil en ligne de commande, même si d’autres interfaces existent autour de lui.

Mais le point intéressant est ailleurs. Pour certaines tâches ciblées — génération de code, assistance privée, prototypage, rédaction technique, automatisations locales —, les modèles embarqués commencent à devenir « assez bons » pour éviter un abonnement supplémentaire ou au moins réduire la dépendance à un service externe.

Une avancée prometteuse, mais encore en chantier

Ollama n’a pas donné de calendrier pour la sortie de cette prise en charge MLX hors préversion ni pour son extension à davantage de modèles. À ce stade, il s’agit donc d’un signal fort, pas encore d’un basculement complet.

Mais le message est clair : le local AI sur Mac n’est plus une curiosité. Avec MLX, Ollama commence à transformer Apple Silicon en terrain plus crédible pour l’inférence moderne. Et à mesure que les coûts du cloud irritent davantage de développeurs, ce type d’optimisation pourrait compter bien plus qu’il n’y paraît aujourd’hui.