Dans le développement assisté par IA, le dilemme est devenu presque banal : soit l’on valide chaque action du modèle une par une, soit on lui abandonne les commandes avec une part de risque difficile à ignorer. Anthropic tente désormais d’ouvrir une troisième voie.

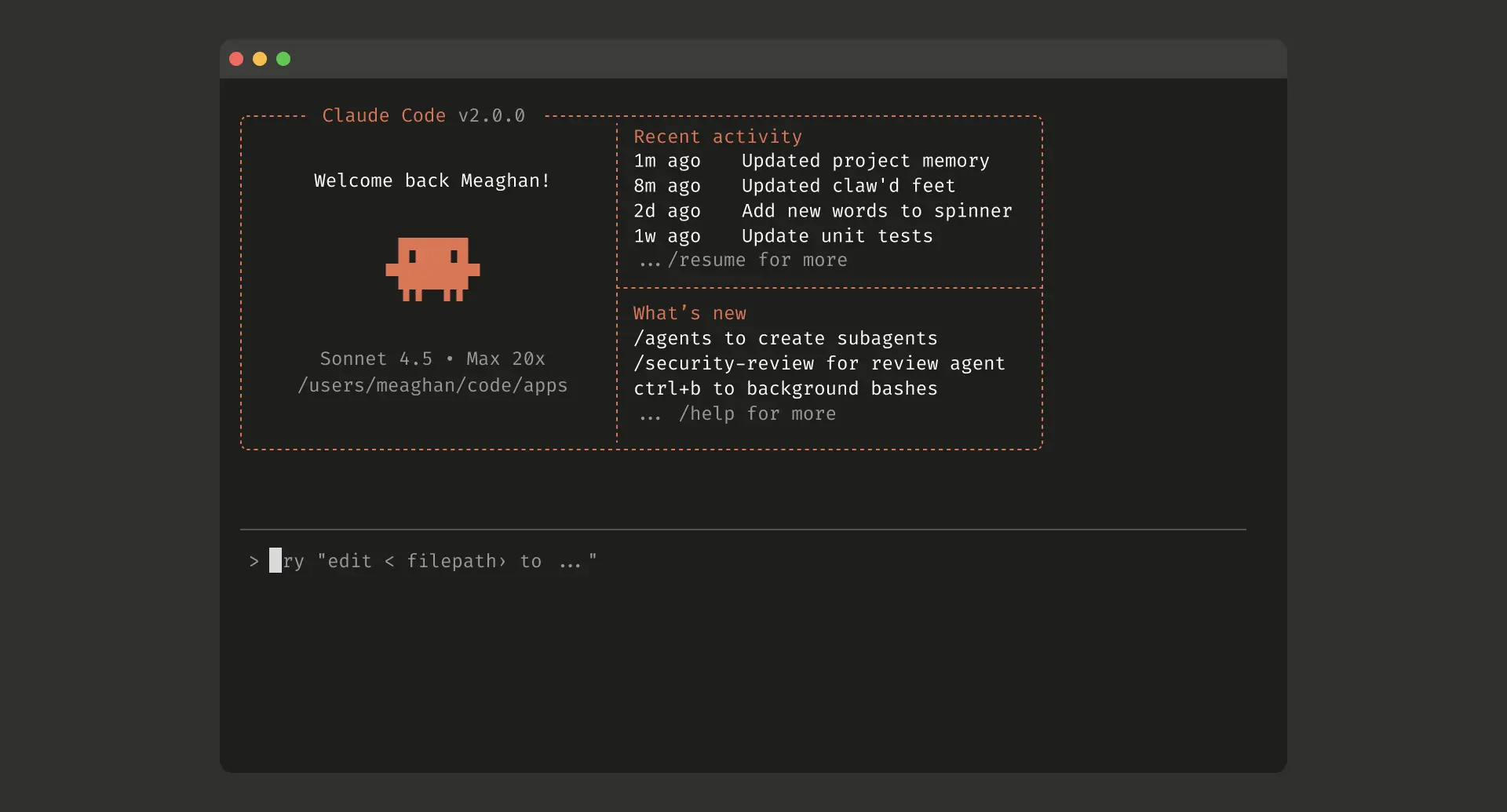

Avec Auto Mode, une nouvelle fonction en research preview pour Claude Code, l’entreprise permet à son IA de décider elle-même quelles actions peuvent être exécutées sans approbation explicite, tout en ajoutant une couche de garde-fous automatisés.

Claude Code : Une autonomie plus fluide, mais sous surveillance algorithmique

Dans sa présentation officielle, Anthropic décrit Auto Mode comme un compromis entre le fonctionnement classique de Claude Code, qui sollicite fréquemment l’utilisateur, et le mode ignorer dangereusement les autorisations, beaucoup plus permissif.

Avant chaque appel d’outil, un classificateur examine l’action envisagée pour détecter des comportements potentiellement destructeurs, comme la suppression massive de fichiers, l’exfiltration de données sensibles ou l’exécution de code malveillant. Le système cherche aussi à repérer les tentatives de prompt injection, ces instructions dissimulées dans un contenu que l’IA traite et qui peuvent la pousser à agir contre l’intention initiale de l’utilisateur.

Les actions jugées sûres sont exécutées automatiquement ; les autres sont bloquées ou continuent d’exiger une validation.

C’est un changement discret en apparence, mais important dans la philosophie du produit. Jusqu’ici, la question de savoir quand demander une permission relevait principalement de l’utilisateur. Désormais, Anthropic la délègue en partie au modèle lui-même, avec une couche de contrôle embarquée.

Autrement dit, Claude Code ne se contente plus d’assister : il commence à arbitrer.

Le vrai sujet : accélérer les tâches longues sans basculer dans le mode « tout ou rien »

Anthropic présente Auto Mode comme une réponse à un problème très concret : les workflows de code assisté par IA deviennent vite pénibles dès qu’ils exigent une validation humaine à chaque étape.

Dans ce contexte, la tentation de tout déverrouiller est forte, mais risquée. Auto Mode cherche précisément à rendre possibles des tâches plus longues, avec moins d’interruptions, sans atteindre le niveau de permissivité d’un saut total des permissions.

Cette annonce s’inscrit dans un mouvement plus large du secteur. GitHub, OpenAI et d’autres poussent eux aussi des outils capables d’agir au nom du développeur, d’exécuter des étapes intermédiaires, voire de prendre en charge des séquences entières de travail. Mais, Anthropic va ici un cran plus loin dans un domaine sensible : l’entreprise ne donne pas seulement plus de latitude à l’agent, elle lui confie aussi le jugement de savoir quand cette latitude est acceptable.

Une prudence encore assumée : Anthropic recommande l’isolement

Pour l’instant, Auto Mode reste en research preview. Anthropic précise qu’il fonctionne actuellement avec Claude Sonnet 4.6 et Claude Opus 4.6, et recommande de l’utiliser dans des environnements isolés, autrement dit des sandboxes ou conteneurs séparés des systèmes de production. Cette recommandation dit beaucoup de l’état réel de la fonctionnalité : le gain de fluidité est réel, mais la confiance n’est pas encore totale.

L’autre limite, plus stratégique, tient au manque de transparence sur les critères exacts utilisés par la couche de sécurité pour distinguer une action sûre d’une action risquée. Anthropic n’a pas détaillé publiquement cette logique de classification, un point que beaucoup de développeurs voudront comprendre avant un déploiement large dans des contextes sensibles.

Une pièce de plus dans l’écosystème agentique d’Anthropic

Auto Mode n’arrive pas seul. Il s’inscrit dans une séquence de lancements où Anthropic pousse Claude au-delà du simple assistant textuel. Début mars, l’entreprise a lancé Claude Code Review, un outil de relecture automatique destiné à repérer bugs et erreurs logiques avant l’intégration du code. Quelques jours plus tard, elle a aussi mis en avant Dispatch et les fonctions de computer use dans Claude Cowork et Claude Code, qui permettent à l’agent d’utiliser directement un Mac pour ouvrir des fichiers, naviguer dans le navigateur ou lancer des outils de développement.

Pris ensemble, ces lancements dessinent une trajectoire claire : Anthropic ne construit plus seulement un modèle performant pour écrire du code, mais une pile complète d’outils destinés à faire de Claude un opérateur logiciel semi-autonome. Auto Mode en devient presque la pièce logique : une fois que l’agent sait revoir, agir et manipuler des outils, il lui faut aussi un mécanisme pour décider jusqu’où il peut aller sans déranger l’utilisateur à chaque instant.

Cette analyse est une inférence à partir de la chronologie des annonces récentes d’Anthropic.

Anthropic veut rendre l’agent acceptable avant de le rendre totalement libre

Le plus intéressant ici n’est pas simplement l’automatisation. C’est la tentative de rendre cette automatisation socialement et techniquement acceptable pour les développeurs. Le « vibe coding » a popularisé l’idée qu’un modèle pouvait produire vite, improviser, essayer, corriger. Mais dans un environnement réel, l’enjeu n’est plus seulement la vitesse ; c’est la confiance opérationnelle. Anthropic semble avoir compris qu’entre l’assistant timide et l’agent incontrôlable, il fallait inventer une zone intermédiaire.

En somme, Auto Mode ne résout pas encore toute la question de l’autonomie en développement. Mais, il marque un basculement important : l’IA n’attend plus seulement l’autorisation, elle commence à l’évaluer. Et dans la course actuelle aux agents capables de coder, c’est peut-être ce genre de détail invisible qui fera la différence.