Microsoft a dévoilé ses engagements en matière d’IA, qui visent à guider les utilisateurs dans leur parcours en matière d’IA. Alors que l’IA offre d’immenses possibilités aux entreprises et aux industries, les préoccupations concernant sa potentielle utilisation abusive et nuisible ont conduit les gouvernements du monde entier à envisager des réglementations pour son utilisation responsable.

Microsoft reconnaît que la gouvernance responsable de l’IA ne se limite pas aux entreprises technologiques et aux gouvernements, mais exige que chaque organisation impliquée dans l’IA établisse ses propres systèmes de gouvernance.

Pour aider ses clients dans leur démarche d’IA responsable, Microsoft a annoncé trois engagements clés.

Déployer l’IA de manière responsable

Le premier engagement consiste à partager les connaissances et les expériences de Microsoft en matière de développement et de déploiement de l’IA de manière responsable. Depuis 2017, Microsoft a dédié une équipe d’experts, comprenant des ingénieurs, des avocats et des spécialistes des politiques, à la mise en œuvre d’un robuste processus de gouvernance pour l’IA.

Ils partageront des documents clés, notamment la norme d’IA responsable, le modèle d’évaluation de l’impact de l’IA, le guide d’évaluation de l’impact de l’IA, les notes de transparence et les amorces de mise en œuvre.

En outre, Microsoft fournira des informations sur ses propres pratiques et sa culture de l’IA responsable par le biais d’un programme de formation et investira dans des ressources et une expertise dédiées dans le monde entier pour répondre aux questions des clients sur le déploiement et l’utilisation de l’IA de manière responsable.

Le deuxième engagement porte sur le programme d’assurance de l’IA, conçu pour garantir que les applications d’IA déployées sur les plateformes Microsoft répondent aux exigences légales et réglementaires en matière d’IA responsable.

Ce programme comporte plusieurs éléments, à commencer par le soutien à l’engagement des régulateurs. L’expérience de Microsoft en matière d’assistance aux clients dans des secteurs très réglementés, tels que le secteur des services financiers, sera mise à profit pour gérer les questions réglementaires liées à l’utilisation des technologies de l’information.

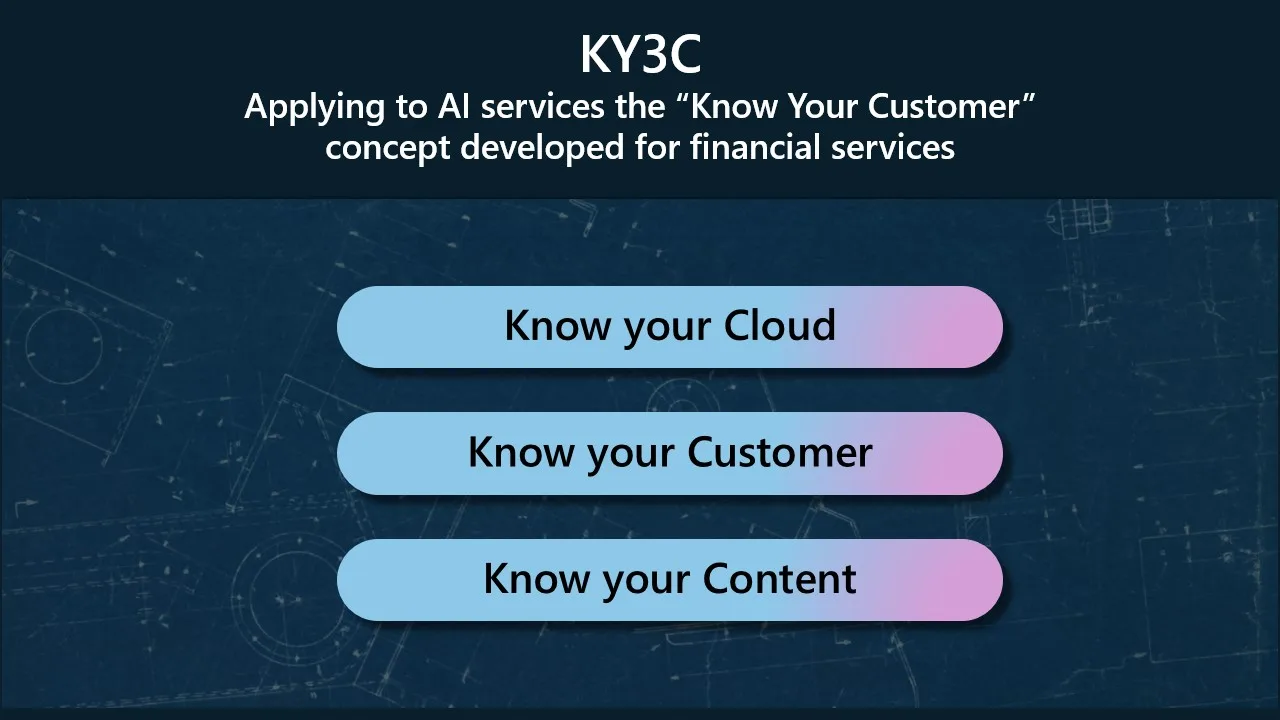

Microsoft propose l’approche « know your customer », appelée « KY3C », pour traiter les obligations liées au déploiement de l’IA.

Cadre de gestion des risques liés à l’IA

L’entreprise mettra en œuvre le cadre de gestion des risques liés à l’IA publié par le National Institute of Standards and Technology (NIST) des États-Unis et collaborera avec le NIST dans le cadre des travaux en cours.

En outre, Microsoft mettra en place des conseils de clients pour recueillir des commentaires sur la fourniture de technologies et d’outils d’IA pertinents et conformes, et s’engagera activement auprès des gouvernements pour plaider en faveur d’une réglementation efficace et interopérable en matière d’IA.

L’entreprise a déjà présenté son projet de gouvernance de l’IA aux gouvernements et aux parties prenantes et l’a rendu accessible par le biais d’une présentation du vice-président et président de Microsoft, Brad Smith, et d’un livre blanc détaillé.

Le troisième engagement consiste à aider les clients à mettre en œuvre leurs propres systèmes d’IA responsable et à développer des programmes d’IA responsable pour l’écosystème des partenaires de Microsoft.

Microsoft prévoit de créer une équipe dédiée d’experts juridiques et réglementaires de l’IA dans le monde entier, agissant comme une ressource pour aider les entreprises à mettre en œuvre des systèmes de gouvernance de l’IA responsable. En outre, Microsoft collaborera avec des partenaires qui ont déjà développé des pratiques complètes pour évaluer, tester, adapter et commercialiser des solutions d’IA, y compris des systèmes d’IA responsables. PwC et EY sont les premiers partenaires de lancement de ce programme.

Microsoft reconnaît que ces engagements ne sont qu’un début et que d’autres avancées seront nécessaires au fur et à mesure de l’évolution de la technologie et des réglementations.