OpenAI a ajouté un nouvel outil pour détecter si une image a été créée avec son générateur d’images d’IA DALL-E, ainsi que de nouvelles méthodes de filigrane pour signaler plus clairement le contenu qu’il génère.

La richesse de l’intelligence artificielle (IA) et des outils génératifs qui ont explosé sur la scène au cours des 18 derniers mois a rendu de plus en plus difficile la distinction entre un contenu authentique et un contenu généré par l’IA. À mesure que ces technologies continuent de progresser, la nécessité de disposer de méthodes fiables pour vérifier l’origine et l’authenticité des contenus numériques devient primordiale. La provenance du contenu numérique, c’est-à-dire le processus de traçage et de certification de l’origine des ressources numériques telles que les images, les vidéos et les sons, est devenue un aspect crucial du maintien de la confiance et de l’intégrité dans le domaine numérique.

OpenAI, organisation pionnière dans la recherche et le développement de l’IA, à l’origine de ChatGPT, reconnaît l’importance de la provenance des contenus numériques et travaille activement sur des solutions innovantes pour relever ce défi. En développant des technologies innovantes qui renforcent l’intégrité du contenu numérique, OpenAI vise à fournir des outils capables d’identifier avec précision le contenu généré par l’IA et de garantir l’authenticité des actifs numériques.

OpenAI garantit l’authenticité du contenu

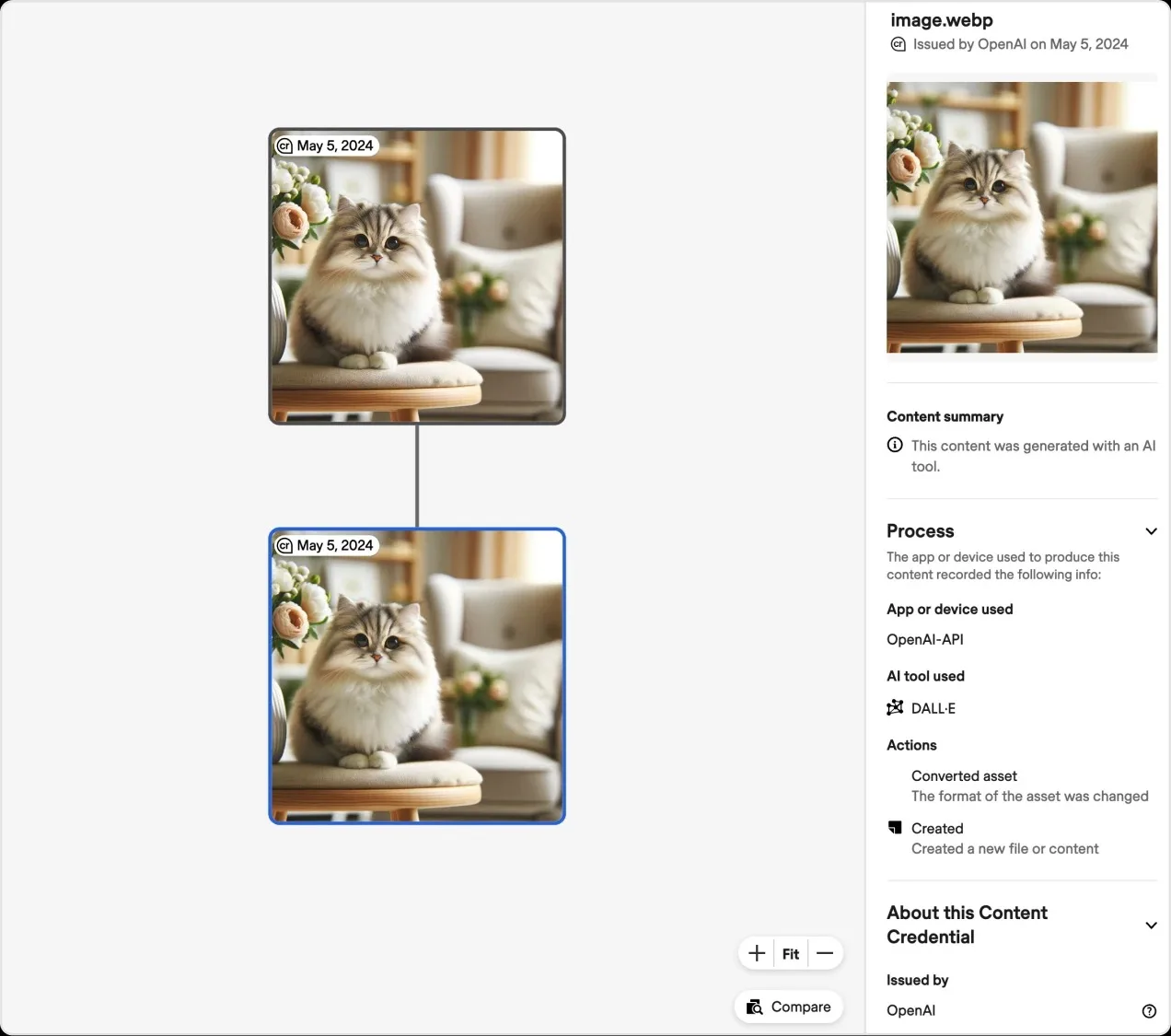

L’engagement de OpenAI en faveur de l’authenticité du contenu est évident dans ses récents efforts pour développer des méthodes de provenance avancées. L’organisation se concentre sur la mise en œuvre de filigranes inviolables et de classificateurs de détection robustes pour permettre une identification précise des contenus générés par l’IA. Ces technologies sont conçues pour résister aux modifications et aux altérations, ce qui permet de vérifier l’origine du contenu même s’il subit des changements après sa création.

Le filigrane infalsifiable consiste à intégrer dans le contenu numérique des signaux invisibles qu’il est difficile de supprimer ou de modifier sans qu’ils soient détectés. Cette technique permet l’identification permanente de la source du contenu, même s’il est partagé ou modifié sur différentes plateformes. Les classificateurs de détection, quant à eux, sont des outils d’IA spécifiquement formés pour évaluer la probabilité qu’un contenu soit généré par des modèles d’IA tels que DALL-E 3. Ces classificateurs analysent diverses caractéristiques et modèles au sein du contenu afin d’en déterminer l’origine.

Efforts de collaboration et de normalisation

OpenAI reconnaît l’importance de la collaboration et de la normalisation dans le domaine de la provenance des contenus numériques. L’organisation participe activement à des initiatives telles que la Coalition for Content Provenance and Authenticity (C2PA), qui rassemble des leaders du secteur, des fournisseurs de technologie et des créateurs de contenu afin d’établir des normes et des meilleures pratiques pour la provenance du contenu.

En intégrant les normes de métadonnées de la C2PA dans le contenu créé à l’aide des outils de OpenAI, l’organisation garantit que l’origine et l’authenticité du contenu peuvent être facilement vérifiées par d’autres systèmes et plates-formes adhérant à ces normes. Cette approche collaborative favorise l’interopérabilité et encourage l’adoption généralisée des technologies de provenance dans l’écosystème numérique.

Extension de la provenance aux contenus vocaux et audio

Outre le contenu visuel, OpenAI se concentre également sur l’extension des techniques de provenance au contenu vocal et audio. Étant donné la prévalence croissante des modèles vocaux générés par l’IA et du risque d’abus, il devient de plus en plus important de garantir l’authenticité du contenu audio.

OpenAI développe des techniques de filigrane pour les moteurs vocaux qui intègrent des filigranes dans les modèles vocaux personnalisés créés à l’aide de ses outils. Cela permet de vérifier l’origine et l’authenticité du contenu audio, offrant ainsi une couche supplémentaire de sécurité et de confiance dans les applications et les services basés sur la voix.

Transparence et confiance

Les efforts de OpenAI pour développer des technologies de provenance avancées vont au-delà des aspects techniques. L’organisation reconnaît les implications plus larges de ces outils dans la promotion d’un écosystème numérique plus transparent et plus fiable.

Grâce à des initiatives telles que la Researcher Access Program, OpenAI s’engage activement auprès de laboratoires de recherche sélectionnés et d’organisations journalistiques à but non lucratif pour tester et fournir un retour d’information sur leurs nouveaux outils de provenance. Cette approche collaborative garantit que les technologies sont rigoureusement évaluées et affinées sur la base d’applications réelles et des besoins des utilisateurs.

En rendant ces outils plus largement accessibles et en encourageant leur adoption dans divers secteurs, OpenAI vise à donner aux créateurs de contenu, aux éditeurs et aux consommateurs les moyens de vérifier l’authenticité du contenu numérique. Cela permet de lutter contre la diffusion de fausses informations, de « deepfakes » et d’autres formes de contenus manipulés susceptibles d’éroder la confiance dans le monde numérique.

L’avenir de la provenance des contenus numériques

À mesure que l’IA et les technologies génératives continuent d’évoluer, le domaine de la provenance des contenus numériques va sans aucun doute s’étendre et s’adapter. L’engagement de OpenAI à développer des solutions innovantes dans ce domaine sert de catalyseur à la recherche et au développement de technologies connexes.

L’intégration de la technologie blockchain, par exemple, offre la possibilité de créer des enregistrements immuables de la provenance du contenu numérique. En tirant parti de la nature décentralisée et inviolable de la blockchain, les origines et l’authenticité des actifs numériques peuvent être stockées et vérifiées en toute sécurité sur des réseaux distribués.

Les techniques cryptographiques avancées, telles que les preuves à connaissance nulle et le chiffrement homomorphique, peuvent également jouer un rôle important dans l’amélioration de la sécurité et de la confidentialité des données de provenance. Ces techniques permettent de vérifier l’authenticité du contenu sans révéler d’informations sensibles, ce qui garantit la protection de la propriété intellectuelle et de la vie privée des utilisateurs.

En outre, l’élaboration de normes mondiales pour l’authenticité des médias numériques, telles que celles promues par la C2PA, sera cruciale pour établir un cadre cohérent et interopérable pour la provenance du contenu. En s’alignant sur ces normes, les outils de OpenAI peuvent s’intégrer de manière transparente à d’autres systèmes et plateformes, ce qui permet de créer un écosystème numérique plus cohérent et plus fiable.

Alors que OpenAI continue d’innover et de collaborer dans le domaine de la provenance des contenus numériques, ses efforts façonneront sans aucun doute l’avenir de la façon dont nous créons, partageons et consommons les contenus numériques. En fournissant des outils et des technologies robustes qui garantissent l’authenticité et l’intégrité des actifs numériques, OpenAI ouvre la voie à un paysage numérique plus transparent et plus fiable.