Les lunettes connectées Ray-Ban de Meta sont prêtes à recevoir des améliorations significatives avec l’intégration de fonctions de recherche visuelle alimentées par l’IA. L’assistant IA de Meta, intégré dans les lunettes connectées, offrira désormais des informations en temps réel, ce qui constitue une amélioration substantielle.

En effet, l’entreprise introduit un robuste support pour les informations en temps réel dans l’assistant embarqué et lance des tests sur des capacités « multimodales » innovantes.

Selon Engadget, cette amélioration permet à l’assistant IA de répondre aux questions en fonction de l’environnement de l’utilisateur. Andrew Bosworth, directeur technique de Meta, a révélé un changement majeur en annonçant que toutes les lunettes connectées Meta aux États-Unis auront désormais accès à des informations en temps réel, en partie fournies par Bing.

Les dernières mises à jour ont le potentiel d’améliorer de manière significative l’aspect pratique de Meta AI, en répondant aux préoccupations concernant sa nature perçue comme gadget, un point mis en évidence dans mon test des lunettes connectées.

Historiquement, Meta AI a fait face à des limitations avec un « arrêt des connaissances » jusqu’en décembre 2022, limitant sa capacité à répondre à des requêtes sur les événements actuels, les scores des matchs, les conditions de circulation, et d’autres éléments essentiels en cours de route.

Par ailleurs, WWD a rapporté que Meta entrait dans la phase de test de l’une des capacités intrigantes de son assistant, connue sous le nom « d’IA multimodale ». Cette démarche était peut-être prévisible étant donné que Meta adopte généralement l’IA dans l’ensemble de ses produits et plateformes, et qu’elle promeut l’IA open source par le biais de sa signature LLM Llama 2. Mais il est intéressant de voir ses premières tentatives d’IA multimodale se présenter sous la forme non pas d’un modèle open source sur le Web, mais d’un appareil.

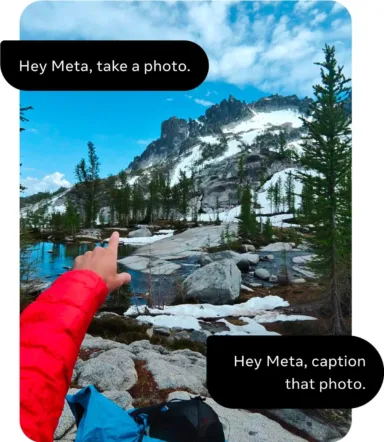

Initialement présentées lors de la conférence Connect, ces fonctionnalités permettent à Meta AI de fournir des réponses contextuelles sur l’environnement de l’utilisateur et de répondre aux demandes en fonction de ce que l’utilisateur observe à travers les lunettes connectées.

Accès anticipé à la version bêta

Pour la plupart des utilisateurs de lunettes connectées, l’accès généralisé à la nouvelle fonctionnalité multimodale risque d’être encore un peu long. Selon Bosworth, l’accès anticipé à la version bêta sera d’abord limité à un petit nombre de personnes qui s’inscriront aux États-Unis, avant d’être plus largement disponible en 2024.

Selon CNET, Mark Zuckerberg a donné un aperçu des possibilités grâce à quelques vidéos partagées présentant les nouvelles capacités. Les clips suggèrent que les utilisateurs peuvent lancer la fonctionnalité avec des commandes telles que « Hey Meta, regarde et dis-moi ».

Lors d’une récente démonstration, Zuckerberg a donné un aperçu direct des capacités croissantes de Meta AI, en présentant ses applications pratiques et sa polyvalence. Dans un exemple notable, Zuckerberg s’est engagé avec l’IA en lui présentant une chemise et en lui demandant de lui recommander un pantalon assorti. Ce scénario illustre l’intégration potentielle de la Meta AI dans les processus décisionnels quotidiens, en particulier dans les domaines liés au style personnel et aux choix de mode, présentant ainsi un aspect pratique et convivial de la technologie.

Au-delà de ces applications concrètes, Bosworth, dans une vidéo partagée sur Threads, a donné un aperçu des fonctionnalités plus larges de Meta AI. Les utilisateurs peuvent utiliser l’IA pour se renseigner sur leur environnement immédiat, ce qui élargit le champ d’application de cette technologie à la recherche d’informations en temps réel et à la sensibilisation à l’environnement.