La guerre de l’IA se joue désormais autant dans les centres de données que dans les modèles eux-mêmes. Lors de sa conférence Code with Claude, Anthropic a annoncé un accord massif avec SpaceX pour utiliser toute la capacité de calcul du datacenter Colossus à Memphis.

Plus de 300 MW de puissance pour Claude

Anthropic utilisera l’intégralité de la capacité du datacenter Colossus 1 de SpaceX, un site équipé de plus de 220 000 GPU NVIDIA, dont des H100, H200 et futurs GB200. L’accord donnerait accès à plus de 300 mégawatts de puissance de calcul supplémentaires.

L’objectif immédiat est clair : augmenter les limites d’utilisation de Claude face à une demande devenue explosive.

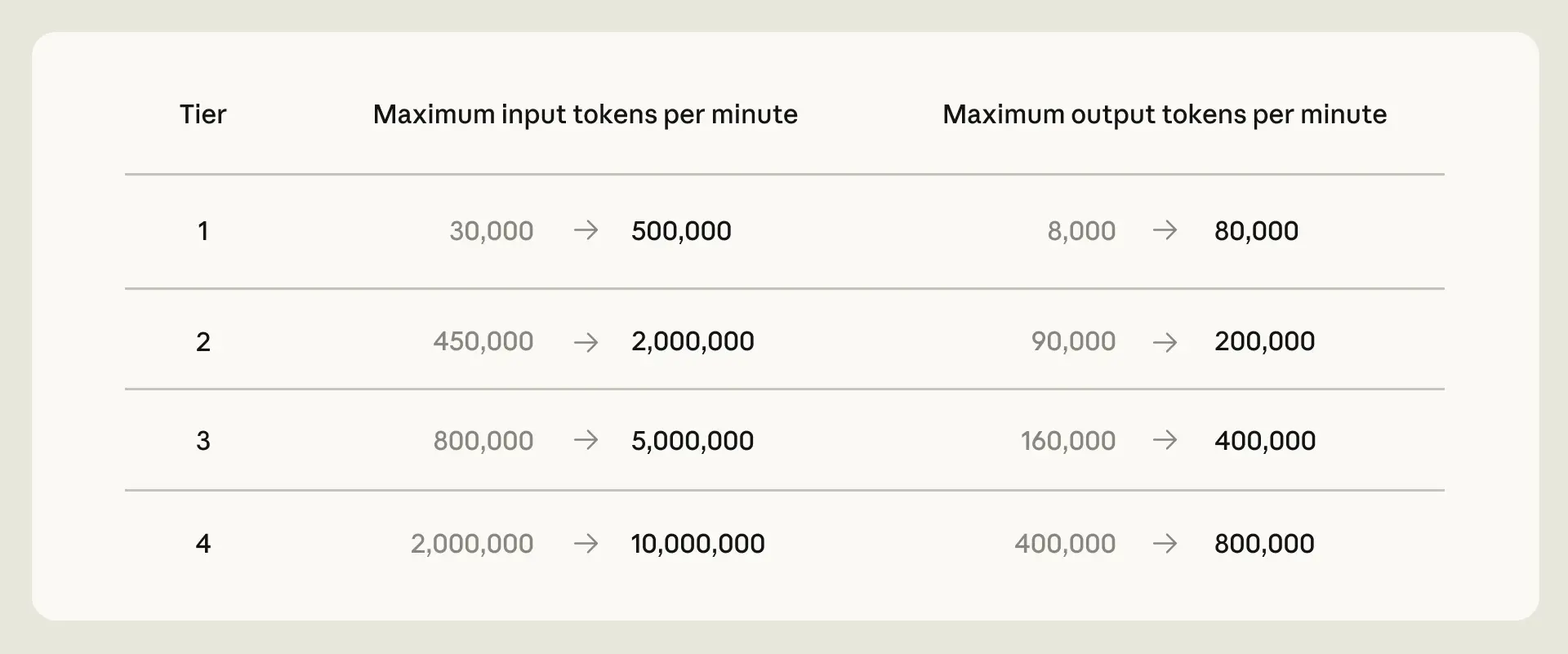

Anthropic augmente enfin ses quotas

La société a confirmé le doublement des limites Claude Code sur les fenêtres de 5 heures, la suppression des réductions d’usage pendant les heures de pointe et une hausse des quotas API pour le modèle Opus.

Ces restrictions étaient devenues un sujet de frustration majeur pour les développeurs utilisant intensivement Claude Code dans des workflows multi-agents et des tâches de développement logiciel avancées.

Une alliance surprenante avec Elon Musk

L’accord étonne aussi politiquement. Elon Musk avait récemment critiqué Anthropic publiquement, allant jusqu’à accuser la société de « détester la civilisation occidentale ». Mais, le ton semble avoir changé. Musk affirme avoir rencontré l’équipe dirigeante d’Anthropic et s’être montré rassuré sur les mécanismes de sécurité de Claude.

Same here.

By way of background for those who care, I spent a lot of time last week with senior members of the Anthropic team to understand what they do to ensure Claude is good for humanity and was impressed.

Everyone I met was highly competent and cared a great deal about…

— Elon Musk (@elonmusk) May 6, 2026

Ce rapprochement montre surtout une réalité du marché : dans la course à l’IA, l’accès aux GPU devient plus stratégique que les rivalités idéologiques.

Le vrai nerf de la guerre : le calcul

L’industrie IA entre dans une phase où la qualité des modèles dépend directement de l’infrastructure : GPU, énergie, refroidissement disponibilité électrique et bande passante mémoire. Anthropic, OpenAI, Google, Meta et xAI se livrent désormais une bataille industrielle autant que logicielle.

Le point le plus spectaculaire concerne l’avenir. Anthropic aurait aussi manifesté son intérêt pour des infrastructures de calcul orbitales, avec plusieurs gigawatts de capacité potentielle dans l’espace.

L’idée reste très spéculative, mais elle révèle l’échelle du problème : les besoins énergétiques de l’IA grandissent plus vite que ce que les infrastructures terrestres peuvent parfois absorber.

L’IA devient une industrie énergétique

Cet accord illustre un basculement majeur : l’intelligence artificielle n’est plus seulement une affaire d’algorithmes brillants. C’est désormais une question d’électricité, de puces et d’infrastructures géantes.

Et dans cette nouvelle économie, les entreprises capables de sécuriser massivement du calcul auront probablement autant d’avantage que celles qui conçoivent les meilleurs modèles.