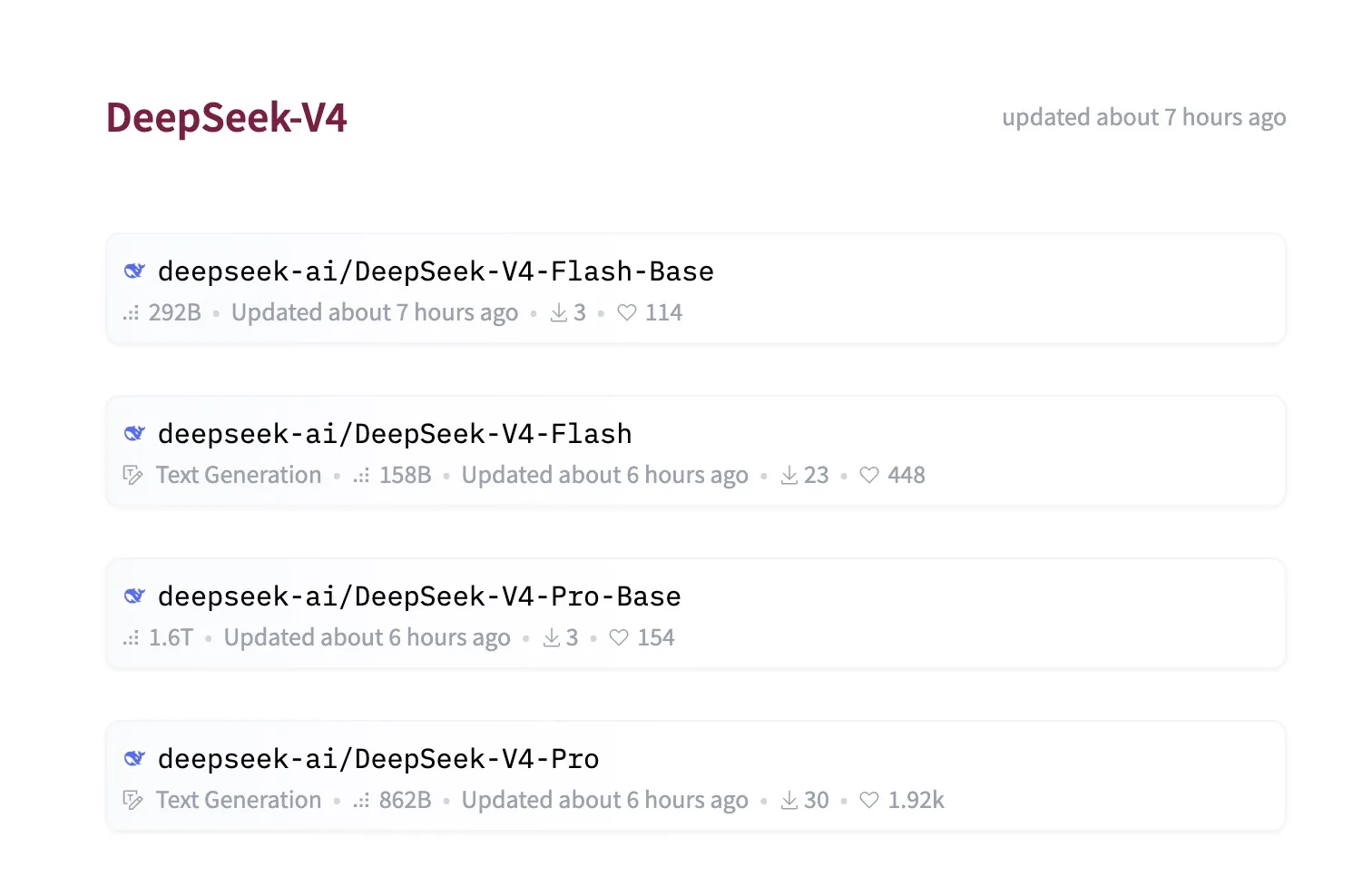

Un an après le choc provoqué par son modèle R1, DeepSeek revient avec une nouvelle génération d’IA ambitieuse. La startup basée à Hangzhou a publié en preview DeepSeek-V4-Pro et DeepSeek-V4-Flash sur Hugging Face, avec une promesse claire : proposer la plateforme open source la plus puissante du moment, capable de rivaliser avec OpenAI et Anthropic.

DeepSeek V4 : Une architecture pensée pour les tâches longues et complexes

Le cœur de cette nouvelle génération repose sur une Hybrid Attention Architecture, une approche qui vise à améliorer la gestion du contexte sur de très longues séquences.

Concrètement, DeepSeek annonce une fenêtre de contexte d’un million de tokens, suffisante pour analyser un livre entier, parcourir une base de code complète, ou maintenir une conversation longue sans perte de cohérence.

C’est précisément sur ce terrain — le raisonnement sur le long terme — que les modèles précédents montraient leurs limites.

Deux modèles, deux philosophies

DeepSeek décline son DeepSeek V4 en deux variantes :

- V4-Pro : orienté performance maximale, notamment en code et mathématiques

- V4-Flash : optimisé pour la vitesse et les coûts

Selon les benchmarks internes, V4-Pro serait le meilleur modèle open source en coding, et se rapprocherait des modèles fermés comme Gemini 3.1 Pro ou les dernières générations d’OpenAI.

Fait notable : DeepSeek reconnaît lui-même un retard de 3 à 6 mois sur les modèles propriétaires. Une transparence rare dans un secteur où les annonces sont souvent très marketing.

Un choix stratégique : miser sur l’open source

Comme pour R1, DeepSeek maintient une approche open source. Les développeurs peuvent accéder au modèle, le modifier, et l’adapter à leurs propres cas d’usage. C’est un positionnement frontal face aux stratégies fermées d’OpenAI ou de Google, et un levier puissant pour accélérer l’adoption dans l’écosystème développeur.

Le vrai enjeu : l’indépendance technologique chinoise

Derrière la performance, un autre élément attire l’attention : l’infrastructure. DeepSeek a optimisé DeepSeek V4 pour fonctionner sur des puces de Huawei (Ascend) et Cambricon. Et surtout, sans accès prioritaire aux GPU Nvidia ou AMD.

Dans un contexte de restrictions américaines sur les exportations de semi-conducteurs, c’est un signal fort. Si DeepSeek V4 tient ses promesses, cela prouverait qu’un modèle de niveau « frontier » peut émerger en dehors de l’écosystème Nvidia — un scénario que beaucoup considéraient encore comme improbable.

Un lancement sous haute tension concurrentielle

Le timing n’est pas anodin. DeepSeek V4 arrive le même jour que GPT-5.5, dans un marché où Anthropic explose en valorisation, et où la rivalité États-Unis/Chine structure désormais l’innovation en IA.

Le précédent lancement, DeepSeek-R1, avait déjà marqué les esprits — au point de provoquer une revalorisation brutale du marché des semi-conducteurs et de questionner les coûts réels de l’IA de pointe.

DeepSeek joue une partition différente

DeepSeek ne cherche pas à battre frontalement OpenAI sur chaque benchmark. La stratégie est plus subtile ouvrir le modèle pour accélérer l’adoption, réduire la dépendance au hardware occidental, optimiser le coût et l’efficacité, et progresser rapidement par itération.

En reconnaissant son léger retard, la startup adopte une posture presque scientifique : avancer vite, mais sans survendre.

Un deuxième acte plus difficile que le premier

Contrairement à R1, qui avait surpris tout le monde, DeepSeek V4 arrive dans un environnement beaucoup plus compétitif. Les attentes sont plus élevées, les comparaisons plus directes, et les enjeux géopolitiques plus visibles.

Les modèles restent pour l’instant en version preview, et leur véritable niveau sera rapidement testé par la communauté.

Mais une chose est déjà certaine : DeepSeek ne cherche plus seulement à surprendre. Il cherche désormais à s’inscrire durablement dans la course mondiale à l’IA.