Google fait évoluer sa stratégie IA sur un terrain devenu central : celui des modèles ouverts à exécuter localement. Avec Gemma 4, la firme ne promet pas seulement plus de performances. Elle corrige aussi l’un des irritants majeurs de la gamme : une licence jugée trop restrictive par de nombreux développeurs.

Cette fois, Google passe à Apache 2.0 — et ce détail pourrait compter presque autant que les benchmarks.

Une nouvelle génération pensée pour le local, du smartphone au GPU haut de gamme

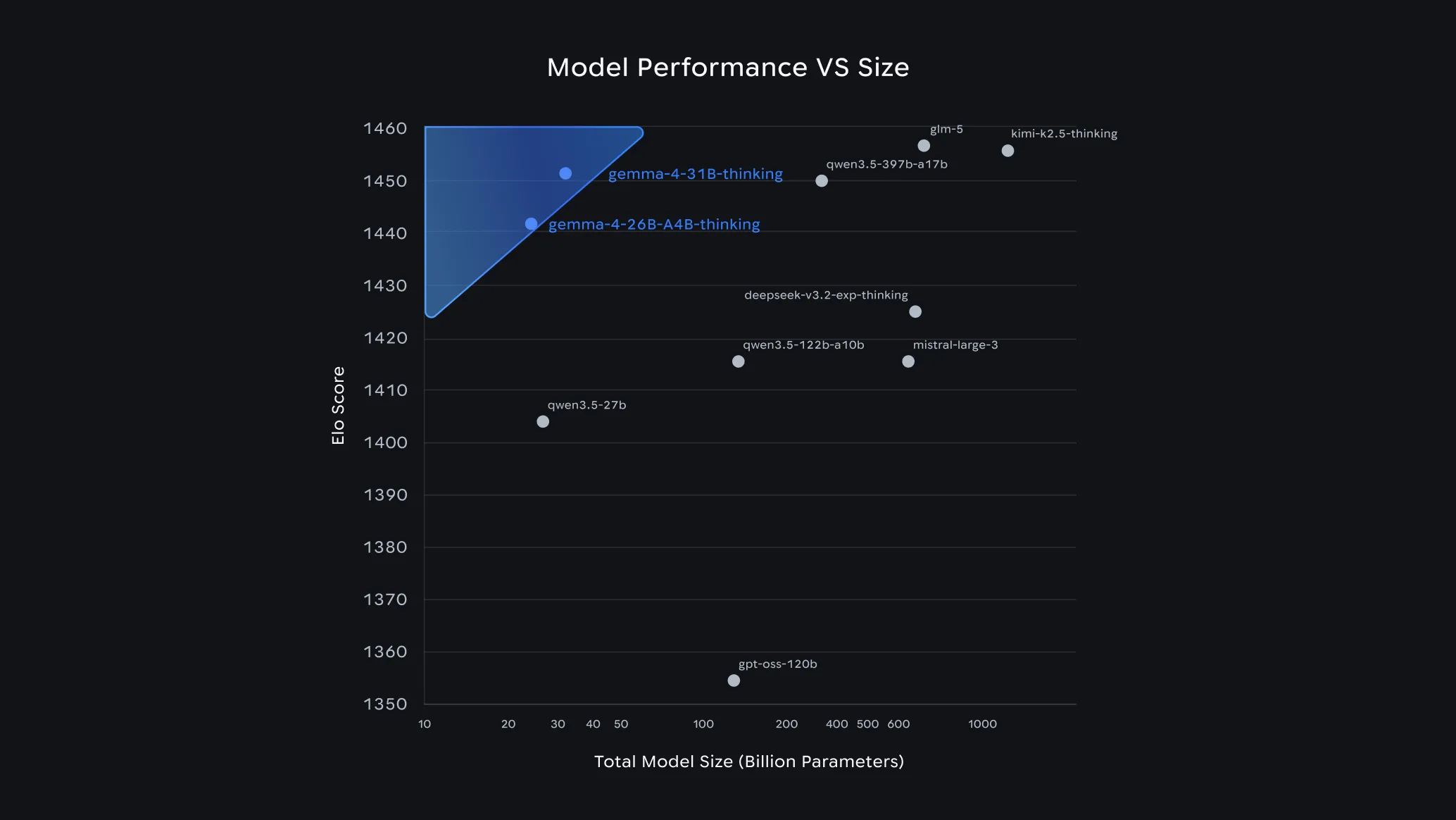

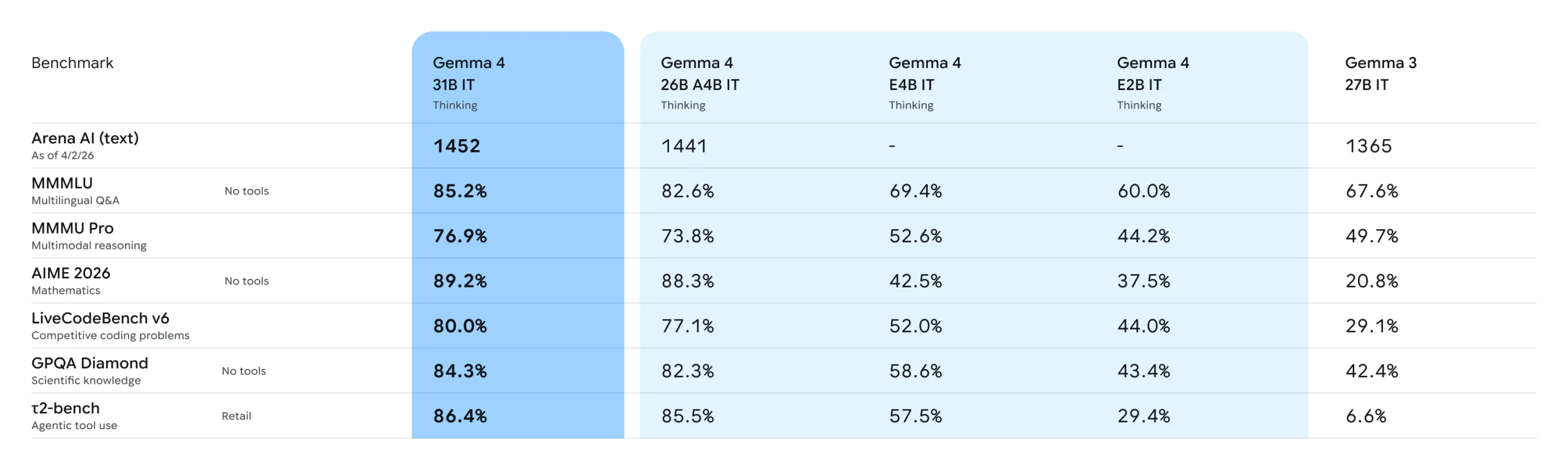

Google a officialisé le 31 mars 2026 la famille Gemma 4, composée de quatre variantes : E2B, E4B, 26B A4B et 31B. L’idée reste fidèle à l’ADN de Gemma : proposer des modèles open-weight capables de fonctionner sur du matériel local, avec des formats adaptés à plusieurs classes d’appareils. Les deux plus gros modèles visent des machines plus musclées, tandis que les versions E2B et E4B ciblent explicitement les appareils edge et mobiles.

Google précise que Gemma 4 26B A4B et Gemma 4 31B sont disponibles dans AI Studio, alors que E2B et E4B arrivent via AI Edge Gallery et le preview Android dédié à AI Core. Les poids des modèles sont aussi proposés sur des plateformes comme Hugging Face.

Autrement dit, Google ne veut plus seulement publier une famille de modèles : il veut l’installer immédiatement dans un écosystème de déploiement concret.

Gemma 4 E2B et E4B : le vrai signal envoyé au mobile

Les deux variantes les plus stratégiques à moyen terme sont peut-être les plus petites. E2B et E4B sont conçues pour conserver une faible empreinte mémoire et une latence minimale sur des appareils comme les smartphones, avec un travail d’optimisation mené avec Qualcomm et MediaTek pour les usages on-device. Google affirme aussi que ces modèles consomment moins de mémoire et d’énergie que la génération précédente.

Ce point compte beaucoup, car il relie directement Gemma 4 à la feuille de route Android. Google a confirmé que Gemini Nano 4 existera bien en deux variantes, dérivées de Gemma 4 E2B et Gemma 4 E4B, via l’AI Core Developer Preview. C’est la première confirmation claire d’une nouvelle génération de Nano, et elle montre que la frontière entre « modèles ouverts pour développeurs » et « IA locale sur smartphone » devient de plus en plus fine chez Google.

Des ambitions plus larges : raisonnement, code, agents, vision

Sur le plan des capacités, Google présente Gemma 4 comme sa famille de modèles ouverts la plus solide à ce jour, avec des progrès en raisonnement, mathématiques, suivi d’instructions, génération de code et compréhension visuelle. Les modèles prennent en charge le function calling natif, les sorties JSON structurées et des instructions pensées pour les workflows outillés — autant de briques devenues essentielles dans la vague actuelle des agents IA.

Google met aussi en avant un contexte de 128k tokens pour les modèles edge et 256k pour les variantes 26B et 31B, ainsi qu’une compatibilité dans plus de 140 langues. Ce n’est pas au niveau des très grands modèles cloud de la maison, mais c’est significatif pour des déploiements locaux, notamment dans des contextes où la confidentialité, le coût ou la souveraineté des données priment sur la taille brute du contexte.

Le changement de licence est peut-être la nouveauté la plus importante

La vraie bascule est juridique autant que technique. Google abandonne sa licence Gemma maison au profit de l’Apache 2.0. Après plusieurs générations de modèles publiés sous un cadre plus spécifique et plus contraignant, ce changement répond à une critique récurrente de l’écosystème : beaucoup de développeurs trouvaient les conditions de Gemma trop floues ou trop intrusives pour bâtir des projets commerciaux ou des produits dérivés en toute sérénité.

Google l’admet implicitement en présentant Apache 2.0 comme un moyen de donner plus de contrôle aux développeurs sur leurs données et leurs plans de déploiement.

C’est un mouvement important, parce qu’Apache 2.0 est une licence connue, prévisible et largement acceptée dans le monde logiciel. Dans l’IA open-weight, la confiance ne se joue pas seulement sur les performances : elle se joue aussi sur la stabilité des règles du jeu. En passant à une licence beaucoup plus permissive, Google retire un frein réel à l’adoption de Gemma dans les environnements professionnels.

Google veut transformer Gemma en passerelle entre open models et IA embarquée

Gemma 4 raconte une stratégie plus cohérente qu’il n’y paraît. D’un côté, Google continue de réserver ses modèles Gemini les plus puissants à une logique plus fermée et cloud. De l’autre, il fait de Gemma un terrain d’expérimentation beaucoup plus crédible pour le local, l’embarqué et les déploiements maîtrisés. Cette complémentarité devient particulièrement visible avec le lien officiel entre Gemma 4 et Gemini Nano 4.

En clair, Google ne cherche pas à opposer Gemini et Gemma. Il organise une hiérarchie : Gemini pour la puissance maximale et les services cloud, Gemma pour la flexibilité locale, l’intégration edge et la communauté développeur. En corrigeant la licence au passage, la firme rend enfin cette seconde branche beaucoup plus attractive.

Une mise à jour plus stratégique qu’elle n’en a l’air

Gemma 4 n’est pas seulement une montée en version. C’est une remise à plat de la proposition de valeur de Google sur les modèles ouverts. Plus performants, mieux adaptés au mobile, mieux connectés à Android, et surtout publiés sous une licence beaucoup plus acceptable, ces modèles pourraient relancer très sérieusement l’intérêt autour de l’écosystème Gemma.

Pour Google, l’enjeu est évident : ne pas laisser le terrain du local AI et de l’open-weight utile aux seuls concurrents. Et cette fois, la firme semble avoir compris qu’un bon modèle ne suffit pas. Il faut aussi un cadre que les développeurs aient envie d’adopter.