OpenAI élargit sa gamme GPT-5.4 avec deux nouveaux modèles plus légers : GPT-5.4 mini et GPT-5.4 nano. L’objectif est clair : apporter une partie importante des capacités de GPT-5.4 à des usages où la latence, le coût et le volume comptent autant que l’intelligence brute.

OpenAI présente GPT-5.4 mini comme son « mini-modèle le plus puissant à ce jour », tandis que nano devient l’option la plus légère et la moins chère de la famille.

GPT-5.4 mini et nano : OpenAI vise les usages où chaque milliseconde compte

Avec ces deux modèles, OpenAI ne cherche pas seulement à enrichir sa nomenclature. La société adresse un besoin très concret : celui des systèmes qui doivent répondre vite, souvent, et à grande échelle. OpenAI cite notamment les assistants de code, les sous-agents exécutant des tâches en parallèle, les systèmes capables d’interpréter des captures d’écran, ainsi que les applications multimodales qui doivent raisonner sur des images en temps réel.

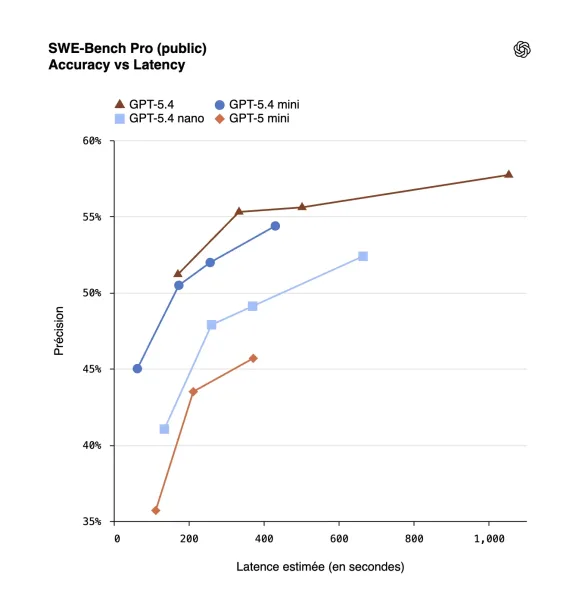

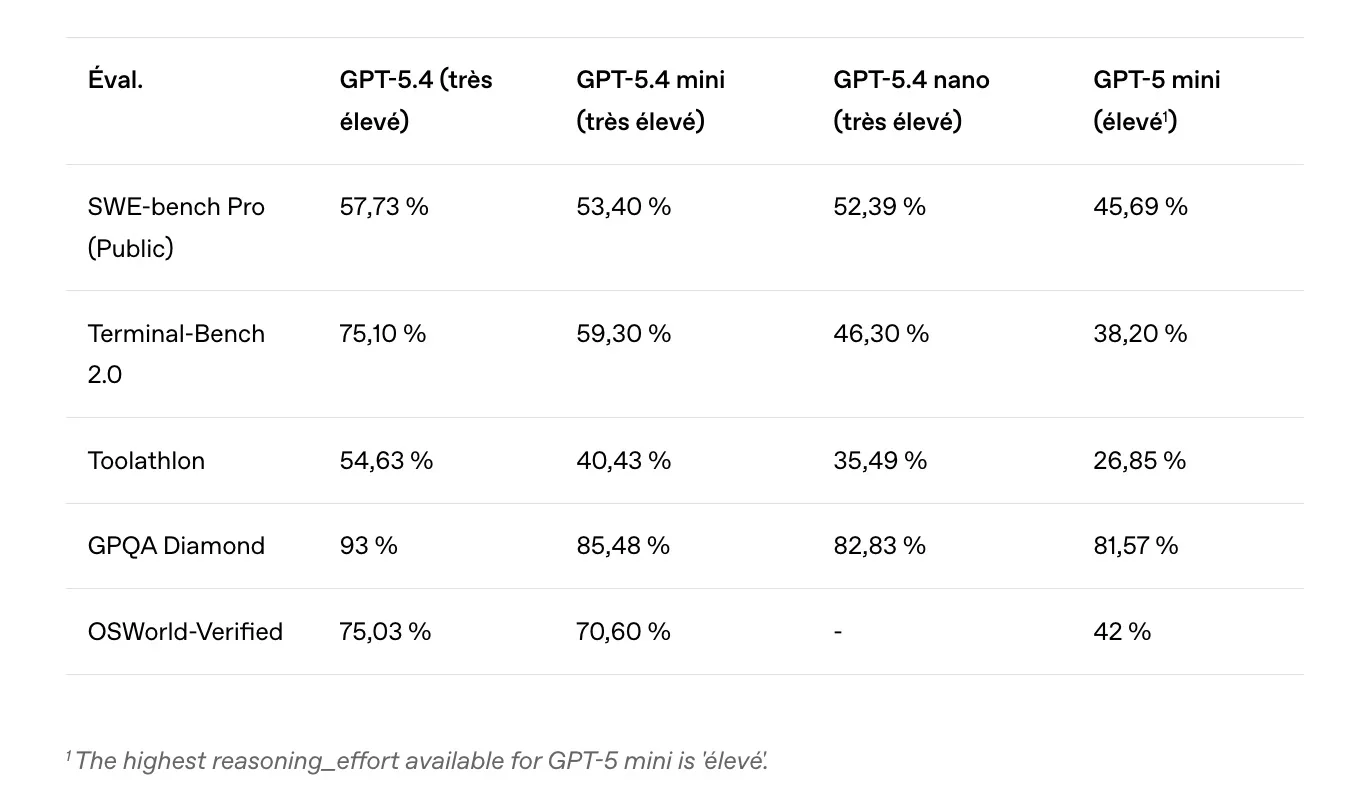

Dans cette logique, GPT-5.4 mini est positionné comme un compromis très offensif entre vitesse et niveau de performance. OpenAI indique qu’il améliore GPT-5 mini en programmation, en raisonnement, en compréhension multimodale et dans l’usage des outils, tout en fonctionnant à une vitesse annoncée comme supérieure à 2x.

La société ajoute qu’il se rapproche des performances de GPT-5.4 sur des évaluations comme SWE-Bench Pro et OSWorld-Verified.

GPT-5.4 nano, le modèle pensé pour l’efficacité brute

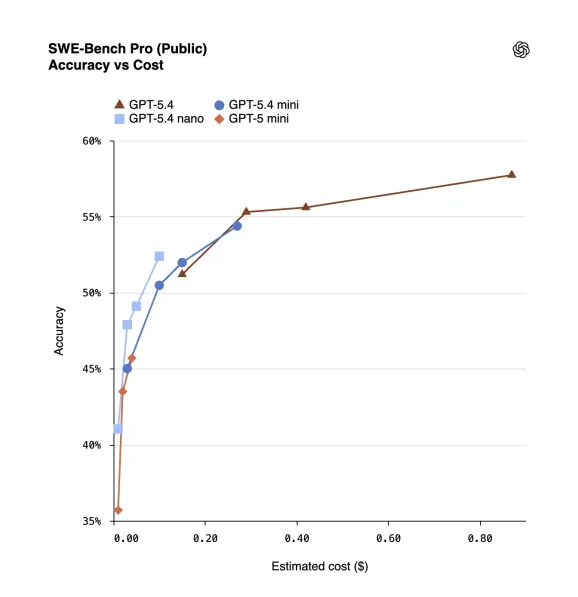

De son côté, GPT-5.4 nano joue une autre partition. OpenAI le décrit comme son plus petit modèle GPT-5.4, optimisé pour les tâches où la rapidité d’exécution et le coût sont prioritaires. Il est présenté comme particulièrement adapté à la classification, à l’extraction de données, au ranking ou encore à des sous-agents de code chargés de tâches plus simples.

Autrement dit, OpenAI affine ici sa stratégie produit. Là où GPT-5.4 reste pensé pour le travail complexe et plus exigeant, mini et nano viennent occuper les couches opérationnelles où l’on préfère souvent une IA un peu moins ambitieuse, mais beaucoup plus rapide et bien moins chère. Cette lecture est une analyse du positionnement tarifaire et fonctionnel décrit par OpenAI.

Le vrai terrain de bataille : le code, les agents et le multimodal léger

OpenAI insiste particulièrement sur trois terrains d’usage. D’abord, le coding, avec des workflows d’itération rapide, des modifications ciblées, de la navigation dans les bases de code et des boucles de débogage plus réactives. Ensuite, les sous-agents, dans des architectures où un grand modèle pilote l’ensemble pendant que des modèles plus petits exécutent des tâches ciblées comme fouiller un codebase ou traiter des documents annexes.

Enfin, le computer use et le multimodal, où GPT-5.4 mini est censé interpréter rapidement des interfaces visuelles denses.

Ce point est important, car il montre comment OpenAI structure désormais sa gamme non plus uniquement par « niveau d’intelligence », mais par rôle dans une chaîne de travail IA. Le grand modèle planifie. Le petit modèle exécute. Et c’est sans doute l’une des évolutions les plus stratégiques du moment dans les architectures agentiques. Cette dernière phrase relève d’une inférence fondée sur les cas d’usage officiellement mis en avant.

Prix, disponibilité et intégration dans ChatGPT

Sur le plan commercial, GPT-5.4 mini est disponible dans l’API, dans Codex et dans ChatGPT. Son tarif API est fixé à 0,75 dollar par million de tokens en entrée et 4,50 dollars par million de tokens en sortie. GPT-5.4 nano, lui, est uniquement disponible via l’API, à 0,20 dollar par million de tokens en entrée et 1,25 dollar par million de tokens en sortie.

OpenAI précise aussi que, dans Codex, GPT-5.4 mini consomme 30 % du quota GPT-5.4, ce qui permet de déléguer certaines tâches simples à moindre coût. Dans ChatGPT, GPT-5.4 mini est accessible aux utilisateurs Free et Go via la fonction Thinking. Pour les autres utilisateurs, il sert aussi de solution de repli lorsque GPT-5.4 Thinking atteint ses limites de débit.

Une sortie qui en dit long sur la maturité de la gamme OpenAI

Au fond, cette annonce raconte quelque chose de plus large que le simple lancement de deux variantes. OpenAI structure de plus en plus sa gamme comme une pile complète, où chaque modèle a une fonction économique et technique précise. GPT-5.4 pour les travaux complexes. Mini pour les usages rapides mais encore exigeants. Nano pour les tâches de soutien, massives et sensibles au coût. Cette analyse découle du positionnement comparé des modèles sur les pages officielles de présentation et de tarification.

C’est une évolution logique. À mesure que l’IA quitte la démonstration pour entrer dans la production, la question n’est plus seulement « quel modèle est le plus intelligent ? », mais « quel modèle est le plus adapté à telle étape du système ? ». Et sur ce terrain, GPT-5.4 mini et nano montrent qu’OpenAI veut désormais gagner autant sur l’architecture que sur la performance brute.