OpenAI franchit un cap que beaucoup redoutaient autant qu’ils l’attendaient : faire de ChatGPT un compagnon de santé du quotidien, plus « personnalisé », plus « sécurisé », et surtout plus connecté à nos données.

Avec ChatGPT Health, l’IA quitte le terrain des conseils génériques pour s’aventurer dans ce que nous avons de plus intime : nos symptômes, nos analyses, nos habitudes… et nos angoisses.

L’annonce ressemble à une promesse de simplification. Elle ressemble aussi, forcément, à une prise de risque.

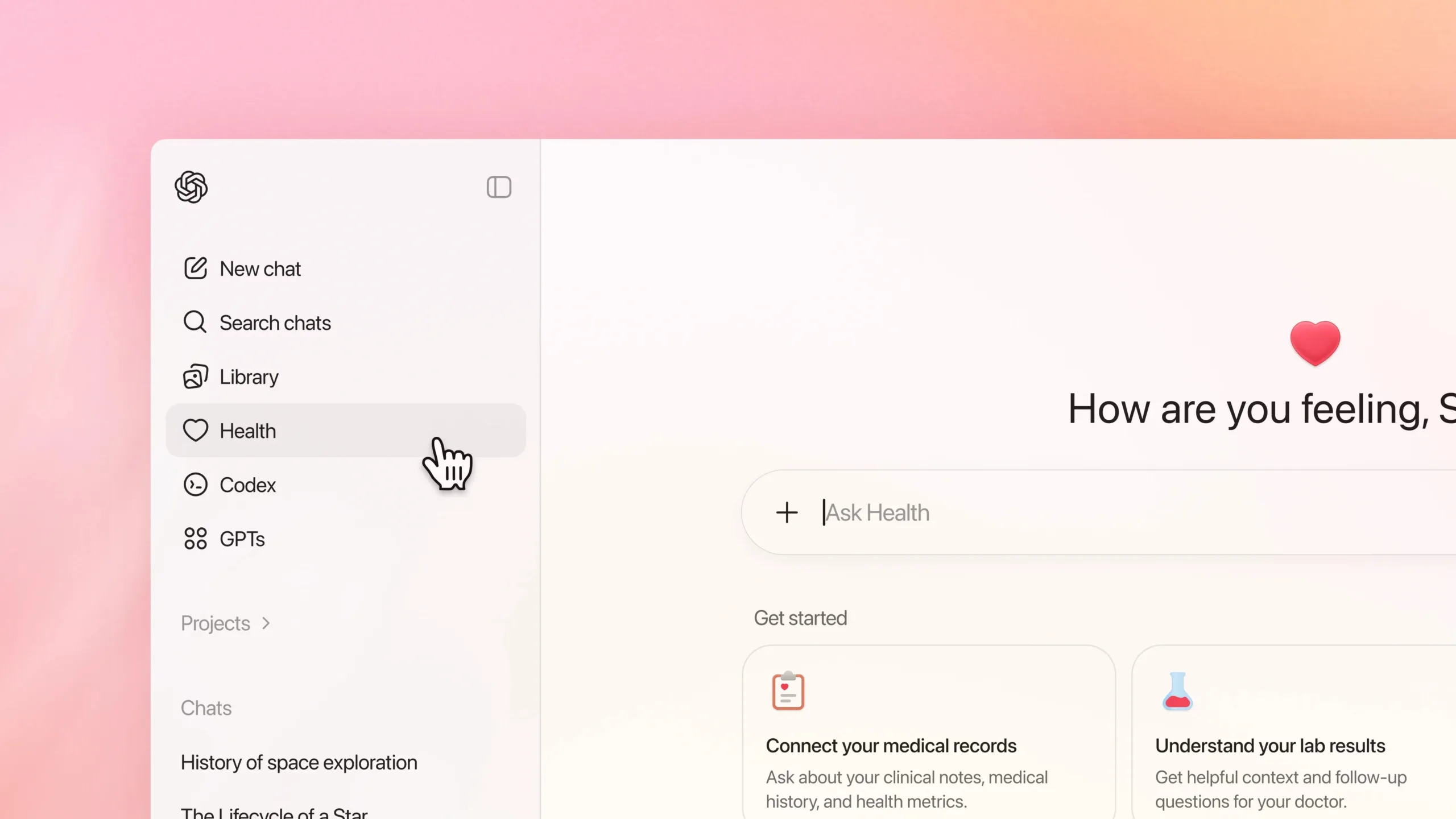

ChatGPT Health : Une « onglet santé » sandboxé, pensé comme une pièce à part

ChatGPT Health prend la forme d’un tab dédié dans ChatGPT, avec un historique et une mémoire séparés du reste des conversations. L’idée : isoler les échanges sensibles, et créer un espace où l’utilisateur peut poser ses questions santé dans un contexte présenté comme plus protecteur.

Ce lancement s’inscrit dans une séquence plus large où OpenAI multiplie les signaux sur « l’IA alliée du système de santé » — un thème déjà mis en avant dans un document publié ce mois-ci.

Le point clé, c’est la connexion aux données. OpenAI encourage les utilisateurs à relier :

- des dossiers médicaux (analyses, comptes rendus, antécédents),

- et des apps « bien-être » comme Apple Health, Peloton, MyFitnessPal, Weight Watchers, Function, pour des réponses censées être plus « ancrées » dans le réel.

Pour l’intégration des dossiers médicaux, OpenAI s’appuie sur b.well, qui servirait de couche technique d’accès à des données issues d’environ 2,2 millions de fournisseurs.

Côté déploiement : liste d’attente, bêta, puis ouverture « progressive » à tous les utilisateurs, sans distinction de formule.

Côté garde-fous : OpenAI répète que le produit n’est pas destiné au diagnostic ou au traitement. Les échanges ChatGPT Health ne seraient pas utilisés pour entraîner les modèles par défaut. L’entreprise parle de « couches de chiffrement » spécifiques, tout en précisant que ce n’est pas du chiffrement de bout en bout — et rappelle qu’en cas de procédure légale valide, l’accès aux données peut être requis.

Enfin, OpenAI indique que HIPAA ne s’applique pas ici, le produit étant présenté comme un service « consumer », pas un outil clinique.

Le vrai sujet : la confiance… dans un moment où l’IA a déjà dérapé sur la santé

OpenAI arrive sur un terrain miné par un paradoxe : la santé est déjà un des usages majeurs de ChatGPT, mais c’est aussi celui où les erreurs coûtent le plus cher (au sens littéral). OpenAI elle-même a travaillé ces derniers mois à renforcer ses réponses dans les conversations sensibles, notamment autour de la détresse.

Or, l’actualité récente rappelle à quel point les IA peuvent « halluciner » avec aplomb :

- Un cas clinique a documenté une intoxication au bromure après qu’un patient a remplacé le sel par du bromure de sodium à la suite d’échanges attribués à ChatGPT — avec hospitalisation et symptômes neuropsychiatriques.

- De son côté, Google a été pris dans une série de polémiques autour des AI Overviews, dont des conseils santé trompeurs jugés potentiellement dangereux par des experts (et, plus tôt, des réponses absurdes devenues virales).

C’est là que ChatGPT Health devient un objet culturel autant qu’un produit : il ne s’agit pas seulement d’améliorer des réponses, mais de faire accepter que l’IA puisse s’installer durablement dans notre hygiène de vie, nos résultats de labo, nos décisions d’assurance — bref, dans la logistique intime de nos existences.

Et, il y a un angle que l’annonce effleure à peine : la santé mentale. OpenAI sait que les gens utilisent déjà ChatGPT pour parler anxiété, dépression, crises, solitude. Mais « produit santé » + « données personnelles » + « conversation sensible » = une zone où la moindre erreur de ton ou de priorité peut faire très mal, même sans « conseil médical » explicite.

Pourquoi OpenAI le fait maintenant

Stratégiquement, ChatGPT Health ressemble à une pièce de puzzle : transformer ChatGPT d’un outil universel en plateforme personnelle, plus difficile à quitter parce qu’elle comprend vos métriques, votre historique, votre contexte.

Et ce n’est pas un coup isolé : dès fin 2025, des signaux indiquaient qu’OpenAI explorait des produits santé grand public au-delà du chatbot « généraliste », en recrutant et en structurant une équipe dédiée.

La santé, c’est aussi un marché où l’IA peut prouver quelque chose de rare : un bénéfice immédiat (comprendre un résultat, préparer un rendez-vous, formuler des questions, suivre une routine) — à condition d’être radicalement humble sur ses limites.

Ce qu’il faudra surveiller en 2026

Trois points décideront si ChatGPT Health devient un outil utile… ou un nouveau générateur d’angoisse :

- La qualité des garde-fous (réponses non alarmistes, redirection vers le soin humain, gestion des situations de détresse).

- La transparence sur les données (qu’est-ce qui est stocké, combien de temps, et comment l’utilisateur contrôle réellement mémoire et accès).

- La preuve par l’usage : est-ce que l’outil aide à mieux naviguer le système de santé… sans se substituer à lui ?

OpenAI joue ici une partie délicate : rendre l’IA plus « proche » sans la rendre envahissante, plus « personnelle » sans la rendre inquiétante. Le futur de l’IA grand public se jouera peut-être là : dans la capacité à inspirer confiance… quand le sujet n’autorise ni l’approximation, ni la mise en scène.