Les chatbots IA ont rendu banal un geste qui aurait paru risqué il y a encore peu : envoyer un document, coller un bloc de texte, téléverser une photo, puis demander un résumé, une correction ou une transformation visuelle. En quelques secondes, un contrat devient synthèse, un PDF médical devient explication simplifiée, et un selfie peut se transformer en illustration façon anime. C’est précisément là que le confort se met à frôler le danger.

Car derrière cette facilité, une réalité demeure : ce que vous partagez avec un assistant comme ChatGPT ne s’évapore pas simplement après la réponse.

Une partie de ces données est traitée sur des serveurs distants, parfois conservée, parfois utilisée pour améliorer les modèles selon les réglages choisis, et parfois soumise à des obligations légales de conservation. Chez OpenAI, la politique officielle précise que le contenu transmis peut inclure des fichiers, images, audio, vidéo et données issues de services connectés.

Pour les services grand public comme ChatGPT, Codex ou Sora, l’entreprise indique qu’elle peut utiliser ce contenu pour améliorer ses modèles, sauf si l’utilisateur se retire explicitement de cette utilisation.

Ce qui se passe vraiment quand vous envoyez quelque chose à ChatGPT

Le premier réflexe à corriger est une idée très répandue : penser qu’un prompt ou un fichier sert uniquement à produire une réponse, puis disparaît. OpenAI explique au contraire que les conversations et fichiers sont traités dans ses systèmes, et que les chats éphémères ne sont supprimés qu’au bout de 30 jours, sauf nécessité de sécurité ou obligation légale. Son aide officielle précise aussi que les Chats éphémères ne sont pas utilisés pour l’entraînement, n’apparaissent pas dans l’historique et peuvent être examinés seulement pour la détection d’abus.

Autrement dit, même lorsqu’un service propose des options de confidentialité, le bon réflexe n’est pas de présumer une disparition immédiate des données. Le vrai cadre est plus nuancé : usage du contenu selon les réglages, suppression différée, et exceptions légales possibles. Cette nuance est essentielle si l’on manipule des documents sensibles.

Le vrai risque : on partage souvent trop sans s’en rendre compte

Le problème n’est pas seulement ce que l’IA « voit ». C’est aussi ce qu’on lui donne sans y penser. Quand on colle un e-mail, un rapport, une ordonnance, une facture ou une capture d’écran dans un chatbot, on transmet souvent plus que la partie que l’on voulait analyser. Un document peut contenir un nom complet, une adresse, un numéro de contrat, un IBAN, un identifiant, un historique médical, ou même des métadonnées invisibles à l’œil nu.

OpenAI indique d’ailleurs explicitement que les contenus transmis dans ses services grand public peuvent inclure des fichiers et images, et que, selon les paramètres de l’utilisateur, ces contenus peuvent servir à améliorer les modèles. Cela signifie qu’un PDF médical ou un contrat annoté ne doit jamais être considéré comme neutre simplement parce qu’il est envoyé pour « obtenir un avis » ou « faire un résumé ».

Les photos posent un problème similaire. Au-delà de l’image elle-même, elles peuvent embarquer des métadonnées EXIF contenant l’heure, le modèle de l’appareil, voire parfois la géolocalisation. Or, si vous uploadez une photo dans un service cloud d’IA, ce n’est plus seulement votre visage qui est analysé : c’est aussi tout l’environnement informationnel attaché au fichier, sauf si vous l’avez nettoyé au préalable.

Ce qu’il ne faut vraiment pas envoyer

La règle la plus solide reste aussi la plus simple : ne jamais téléverser ce que vous ne seriez pas prêt à voir hébergé sur un système tiers. En pratique, cela inclut les mots de passe, identifiants de connexion, clés API, informations bancaires, documents médicaux nominatifs, pièces d’identité, contrats non anonymisés, bulletins de salaire, captures d’écran d’interfaces internes, et photos dont les métadonnées n’ont pas été supprimées.

Même lorsqu’un chatbot est extrêmement utile pour analyser un problème, il vaut mieux reformuler manuellement le contexte que lui envoyer une capture brute contenant trop d’informations. Et lorsqu’un document doit vraiment être traité, l’idéal est de supprimer en amont les noms, numéros, coordonnées, montants sensibles, signatures et références uniques.

Comment utiliser ChatGPT avec plus de retenue ?

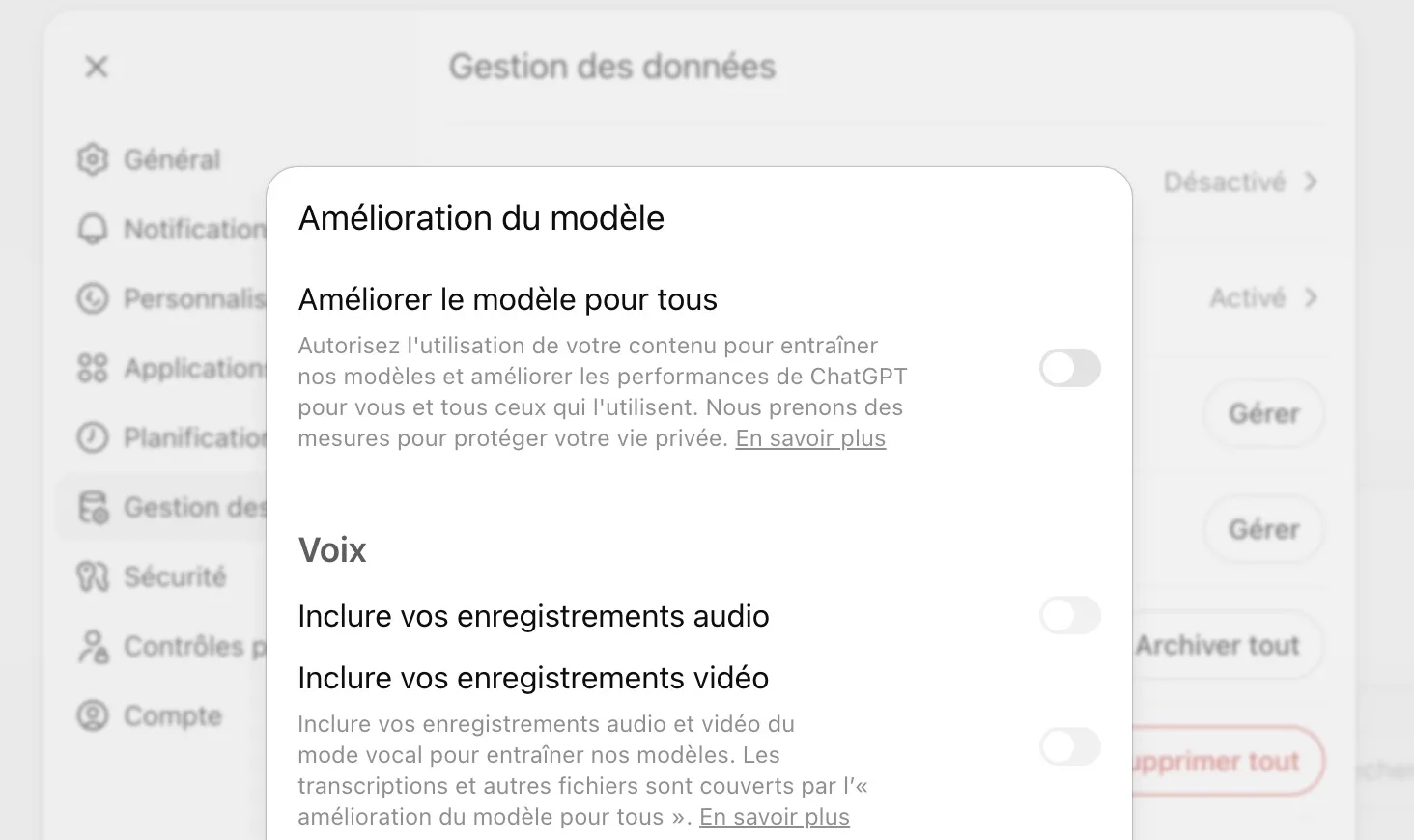

OpenAI permet heureusement de réduire une partie de l’exposition. Dans les réglages de Gestion des données, il est possible de désactiver « Améliorer le modèle pour tous ». OpenAI précise qu’une fois ce réglage coupé, les nouvelles conversations ne seront plus utilisées pour entraîner ses modèles. Les Chats éphémères ajoutent une couche supplémentaire : ils ne sont pas utilisés pour l’entraînement et sont effacés dans un délai de 30 jours.

Mais, il faut être lucide : cela ne transforme pas automatiquement ChatGPT en coffre-fort. Ces réglages réduisent l’usage des données pour l’amélioration des modèles, pas la réalité du traitement sur serveur ni les cas où une conservation temporaire ou légale peut s’appliquer. C’est pourquoi le meilleur principe reste la minimisation : n’envoyer que le strict nécessaire, jamais l’original complet si une version expurgée suffit.

L’alternative la plus discrète : les modèles locaux

Pour ceux qui manipulent souvent des contenus sensibles, la vraie alternative n’est pas forcément un meilleur réglage cloud, mais un LLM local. Le principe est simple : le modèle tourne sur votre machine, et le document n’a pas besoin de quitter votre ordinateur pour être résumé ou analysé.

LM Studio, par exemple, indique dans sa politique de confidentialité que les messages, historiques et documents ne sont pas transmis depuis votre système par défaut, et restent sauvegardés localement sur l’appareil. Cela ne rend pas l’usage « magiquement sûr » — un poste compromis reste un poste compromis —, mais cela élimine au moins la couche de transmission à un fournisseur tiers pour l’inférence elle-même.

C’est aujourd’hui l’option la plus rationnelle pour résumer des documents confidentiels, relire des notes sensibles ou expérimenter sur des fichiers que l’on ne souhaite pas faire sortir de son environnement personnel ou professionnel. Le cloud garde un avantage net en vitesse, en qualité et en confort.

Mais dès que la confidentialité devient une priorité réelle, le local cesse d’être une lubie de passionné pour redevenir une option sérieuse.

Le bon réflexe en 2026 : traiter un chatbot comme un service tiers, pas comme un carnet privé

La vraie erreur consiste peut-être à confondre intimité conversationnelle et confidentialité technique. Un chatbot répond dans un ton personnel, se souvient du contexte, semble proche, presque privé. Mais sur le plan du traitement des données, il reste un service informatique avec ses politiques, ses logs, ses exceptions et ses contraintes légales.

C’est pourquoi la meilleure hygiène d’usage tient en une phrase : n’envoyez jamais à une IA cloud ce que vous ne lui confieriez pas en toute conscience. Les modèles sont devenus assez bons pour nous faire oublier l’infrastructure qui les soutient. Le vrai enjeu, aujourd’hui, est justement de ne pas l’oublier.