Lundi, Anthropic a dévoilé une nouvelle fonctionnalité très attendue pour son chatbot Claude : la mémoire conversationnelle. Cette nouveauté permet à l’IA de retrouver et résumer vos anciennes discussions afin de reprendre un projet là où vous l’aviez laissé.

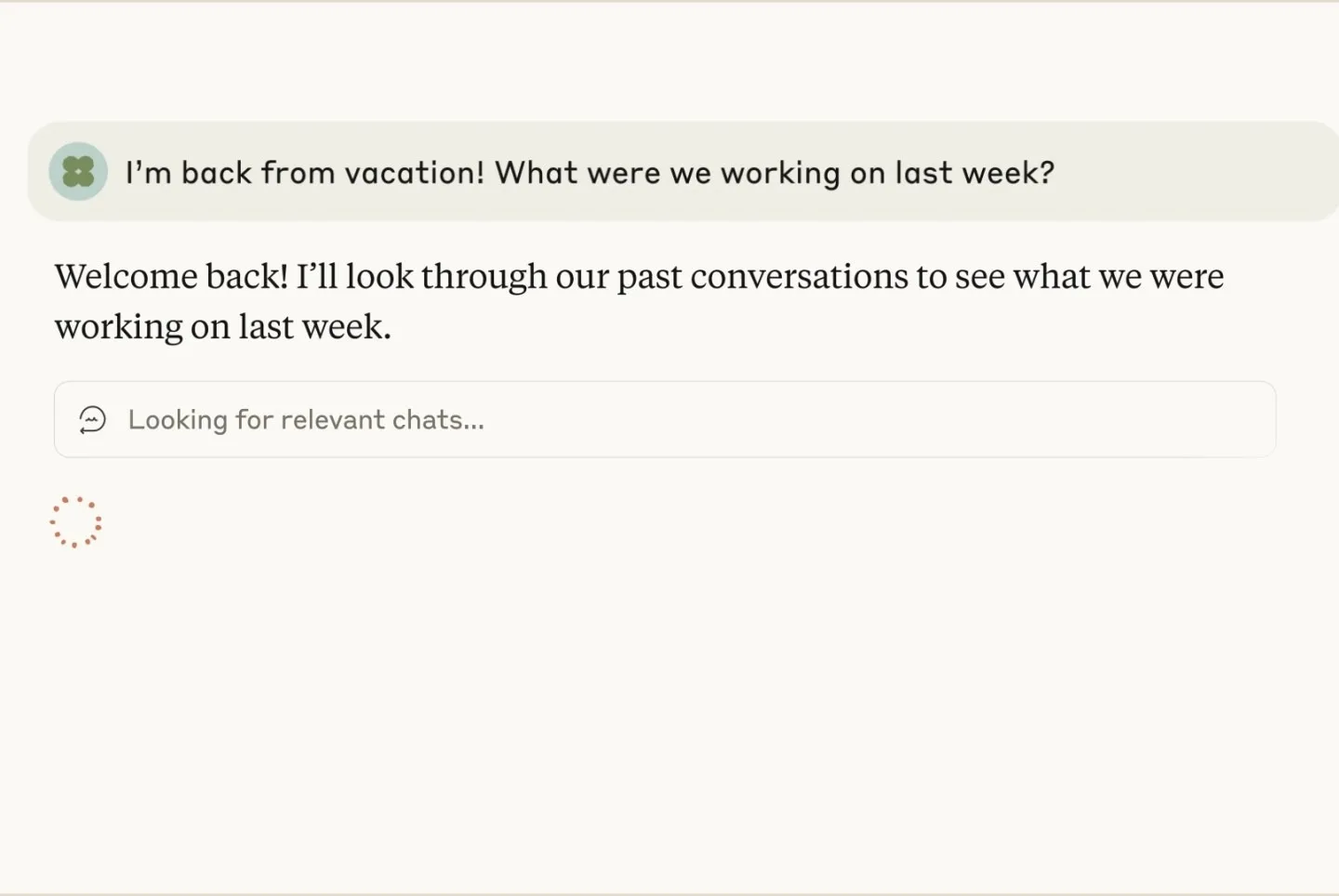

Dans une vidéo publiée sur YouTube, Anthropic montre un utilisateur demandant à Claude : « De quoi parlions-nous avant mes vacances ? ». Claude recherche alors dans l’historique, résume les échanges précédents et propose de poursuivre le projet en cours. L’objectif est clair : ne plus jamais perdre le fil de vos travaux ou idées.

Cette mémoire fonctionne sur le Web, sur desktop et sur mobile. Elle permet aussi de garder vos projets séparés pour éviter les mélanges entre conversations.

Activation et disponibilité dans Claude

La fonctionnalité est déjà disponible pour les abonnés Claude Max, Team et Enterprise :

- Rendez-vous dans Paramètres > Profil.

- Activez Rechercher et référencer les conversations.

Anthropic précise que les autres formules devraient y avoir accès prochainement.

Contrairement à ChatGPT d’OpenAI, cette mémoire n’est pas persistante. En effet, Claude ne conserve pas automatiquement des données sur vous, il n’élabore pas de profil utilisateur et il ne récupère vos anciennes conversations que si vous lui demandez.

Selon le porte-parole Ryan Donegan, l’objectif est de fournir un outil pratique sans franchir les limites en matière de vie privée.

Une bataille directe avec OpenAI

Cette annonce intervient dans un contexte de compétition intense entre Anthropic et OpenAI. Les deux entreprises enchaînent les nouveautés : modes vocaux, contextes étendus, nouvelles formules payantes…

La semaine dernière, OpenAI lançait GPT-5, tandis qu’Anthropic serait en train de finaliser une levée de fonds valorisant la société à 170 milliards de dollars.

Les fonctions mémoire représentent un atout stratégique pour fidéliser les utilisateurs et augmenter l’engagement sur une plateforme donnée.

Débat et précautions d’usage

Les mémoires conversationnelles suscitent un vif débat. Certains utilisateurs de ChatGPT les adorent pour la continuité qu’elles offrent, tandis que d’autres y voient un risque, notamment pour les personnes qui développent une dépendance émotionnelle à l’IA — un phénomène parfois surnommé « psychose ChatGPT ».

Anthropic semble vouloir éviter cet écueil avec une approche sur demande, moins intrusive.