Sous presque toutes les applications d’IA générative pour l’entraînement ou l’inférence aujourd’hui, vous trouverez probablement des conteneurs Docker comme principale approche de déploiement.

Lors de la conférence Dockercon à Los Angeles ce weekend, Docker Inc, la société éponyme à l’origine de la technologie de conteneur open source Docker, plonge dans les profondeurs de l’IA avec une série d’initiatives conçues pour aider les développeurs à créer plus rapidement des applications d’IA générative.

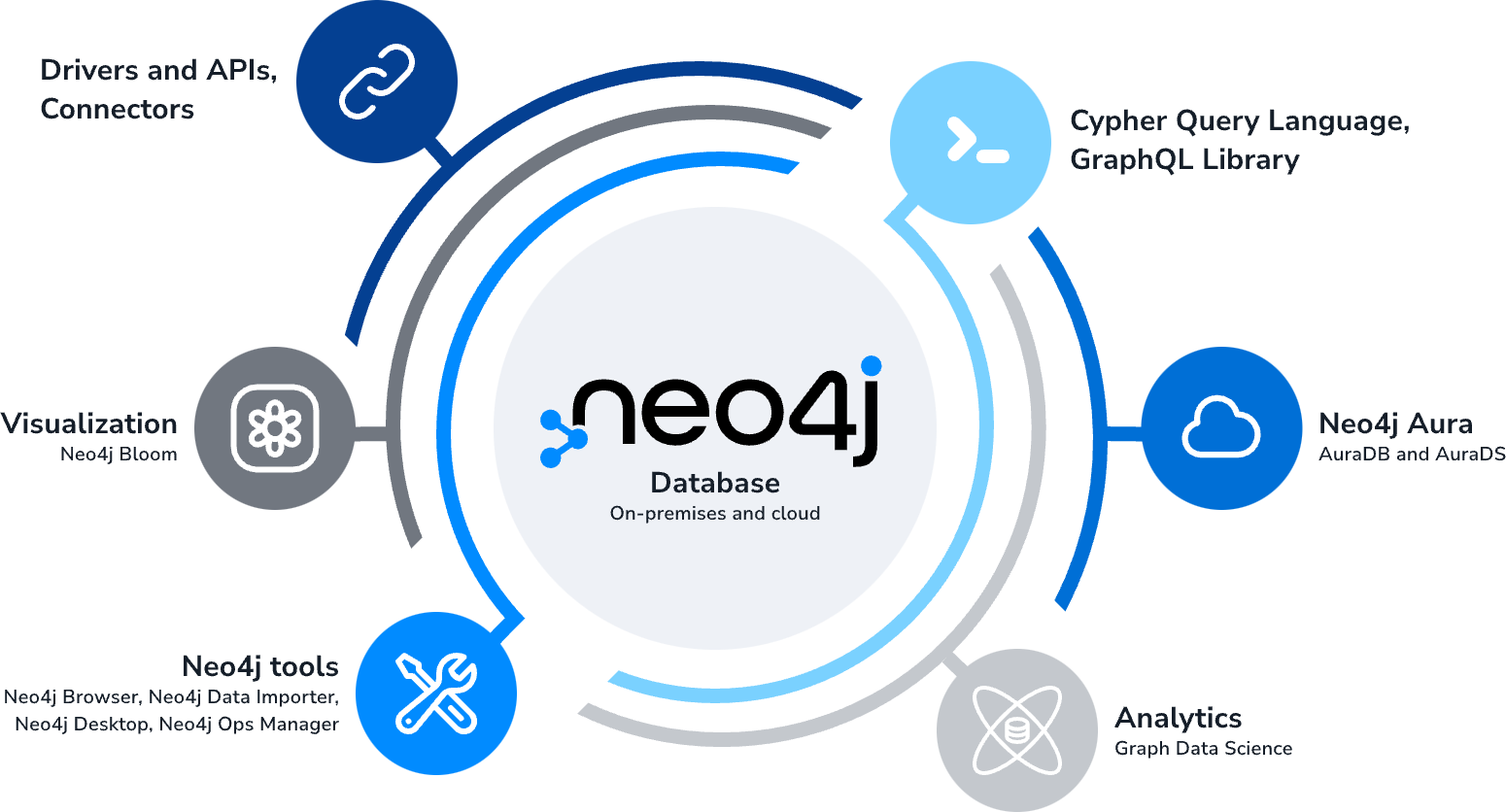

Parmi ces initiatives figure le lancement d’une nouvelle stack GenAI qui intègre Docker à la base de données graphique Neo4j, à la technologie de chaînage de modèles LangChain et à Ollama pour l’exécution de grands modèles de langage (LLM). Le nouveau produit Docker AI est également présenté pour la première fois lors de la conférence Dockercon. Il s’agit d’un moyen intégré permettant aux développeurs d’obtenir des informations et des orientations en matière d’IA pour le développement avec des conteneurs.

L’importance critique de Docker pour l’écosystème de développement moderne ne peut être surestimée, et les nouveaux efforts en matière d’IA pourraient avoir un impact important sur les efforts de développement de GenAI. Ces dernières années, Docker a redoublé d’efforts pour se concentrer sur les développeurs, un effort qui, selon le PDG de l’entreprise, porte ses fruits.

Ce que la stack Docker GenAI apporte aux développeurs

Si l’utilisation des conteneurs Docker pour faciliter le partage et le déploiement de l’IA est omniprésente, Docker a déclaré qu’il était également nécessaire de faciliter le développement des applications GenAI.

Les applications GenAI nécessitent généralement quelques éléments de base, tels qu’une base de données vectorielle, que Neo4j propose désormais dans le cadre de sa plateforme de base de données graphique. Ensuite, bien sûr, GenAI a besoin d’un LLM, ce que Ollama fournit avec sa plateforme qui permet aux utilisateurs d’exécuter des LLM, y compris Llama 2, pour les exécuter localement. Les applications GenAI modernes sont également souvent multi-étapes, et c’est là que LangChain intervient avec son framework. La configuration de tous ces éléments dans des conteneurs pour qu’ils fonctionnent ensemble demande normalement un peu d’effort qui peut maintenant être considérablement simplifié grâce à la stack GenAI.

La stack Docker GenAI est conçue pour aider les développeurs et les entreprises pour lesquelles ils travaillent à se lancer plus facilement dans le développement de l’IA à l’aide de conteneurs. Avec la stack GenAI, plusieurs cas d’utilisation sont ciblés, notamment la possibilité de créer un bot agent d’assistance avec une capacité de génération augmentée de recherche (RAG), un assistant de codage en python et une génération de contenu automatisée.

L’ensemble de la stack est conçu de manière à pouvoir fonctionner localement sur le système d’un développeur et est mis à disposition gratuitement. Au fur et à mesure que les développeurs élaborent des applications et ont besoin d’une assistance commerciale et d’un déploiement, Docker et ses partenaires proposeront des options.

Docker AI : une « combinaison » pour les développeurs

Le marché actuel ne manque pas d’outils de développement GenAI, avec des options populaires telles que GitHub Copilot et Amazon CodeWhisper, entre autres.

Docker entre maintenant dans la mêlée avec son propre outil GenAI, simplement appelé Docker AI. Plutôt que de désigner Docker AI comme un copilote, terme que Microsoft et d’autres fournisseurs utilisent de plus en plus pour les outils GenAI qui assistent les utilisateurs, Docker utilise le terme de mech suit. L’idée de base est qu’avec la mech suit, les développeurs disposent de davantage de puissance et de force pour accomplir leurs tâches.

L’IA de Docker a été formée sur les données propriétaires de Docker provenant de millions de fichiers Docker, de fichiers de composition et de journaux d’erreurs. Docker AI s’intègre directement dans les workflows des développeurs pour leur fournir une assistance en cas d’erreur. Il affichera de potentiels correctifs dans l’environnement de développement et permettra aux développeurs de tester le correctif avant de valider les changements. L’objectif est d’améliorer l’expérience des développeurs en matière de dépannage et de résolution des problèmes lorsqu’ils surviennent.