YouTube renforce ses protections contre les vidéos truquées par intelligence artificielle. La plateforme a annoncé ce 10 mars 2026 l’extension de sa technologie de « likeness detection » à un groupe pilote composé de responsables publics, candidats politiques et journalistes.

L’outil leur permet de repérer des contenus générés par IA qui imitent leur visage, puis de demander leur suppression s’ils estiment que ces vidéos enfreignent les règles de YouTube.

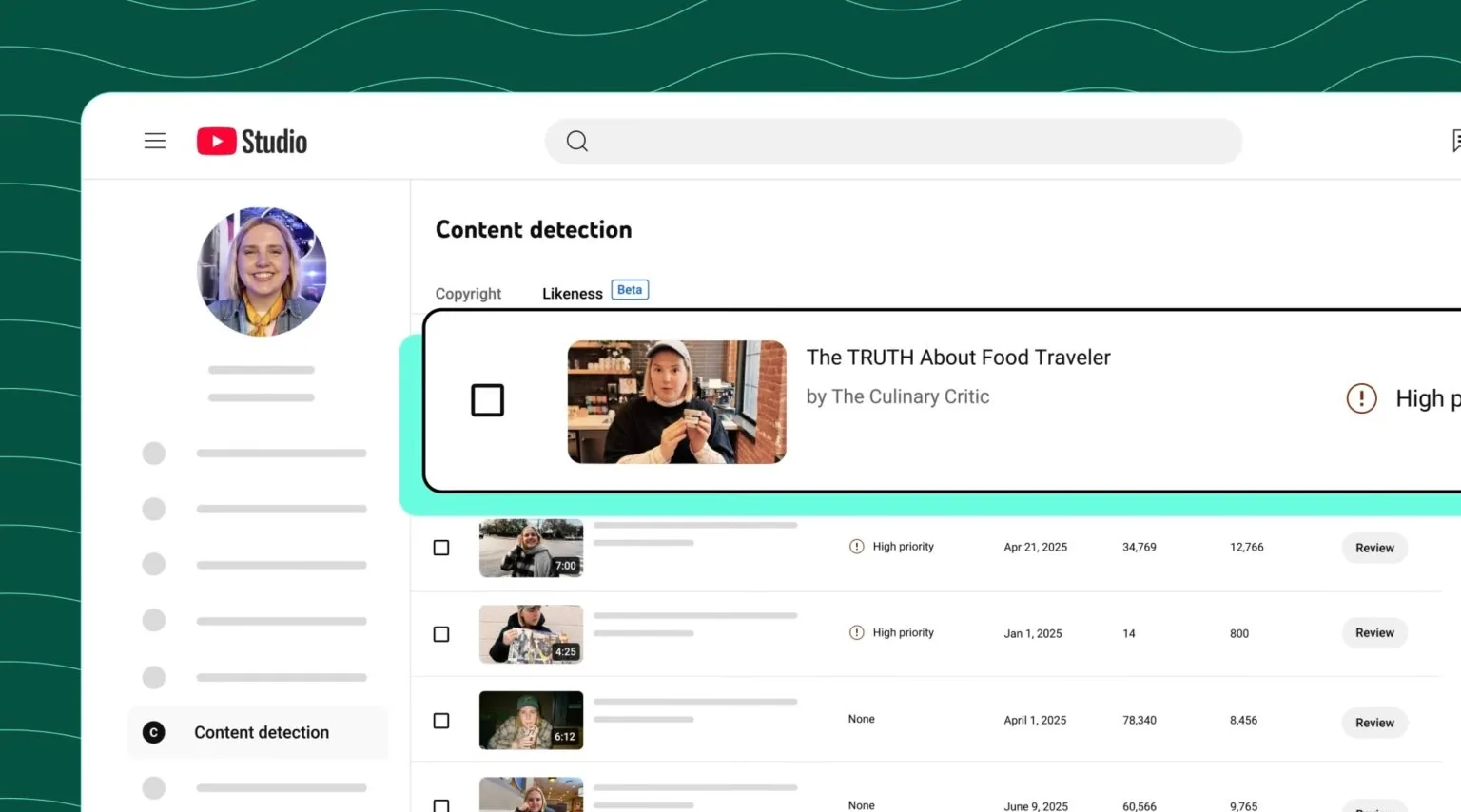

Cette technologie n’est pas totalement nouvelle. YouTube l’avait déjà ouverte l’an dernier à environ 4 millions de créateurs du YouTube Partner Program, après une première phase de tests. Le principe rappelle celui de Content ID, mais appliqué non plus au droit d’auteur, plutôt à l’identité visuelle : le système cherche des correspondances entre un visage réel et des vidéos simulées par IA.

Un enjeu particulièrement sensible dans la sphère civique

L’enjeu est particulièrement sensible dans la sphère civique. YouTube explique que les risques d’usurpation par IA sont plus élevés pour les personnalités publiques, notamment les élus, candidats ou journalistes, parce que leurs faux doubles peuvent être utilisés pour diffuser de la désinformation ou manipuler le débat public.

La vice-présidente de YouTube chargée des affaires publiques, Leslie Miller, a d’ailleurs présenté cette extension comme une mesure visant à protéger « l’intégrité de la conversation publique ».

YouTube précise toutefois que tous les contenus détectés ne seront pas automatiquement retirés. Chaque demande restera examinée au regard de la politique de confidentialité existante. La plateforme dit vouloir préserver les usages protégés comme la parodie, la satire ou la critique politique, qui relèvent de la liberté d’expression.

Autrement dit, l’outil sert d’abord à signaler et à instruire, pas à effacer mécaniquement tout ce qui ressemble à un deepfake.

Pas de suppression automatique, mais un examen au cas par cas

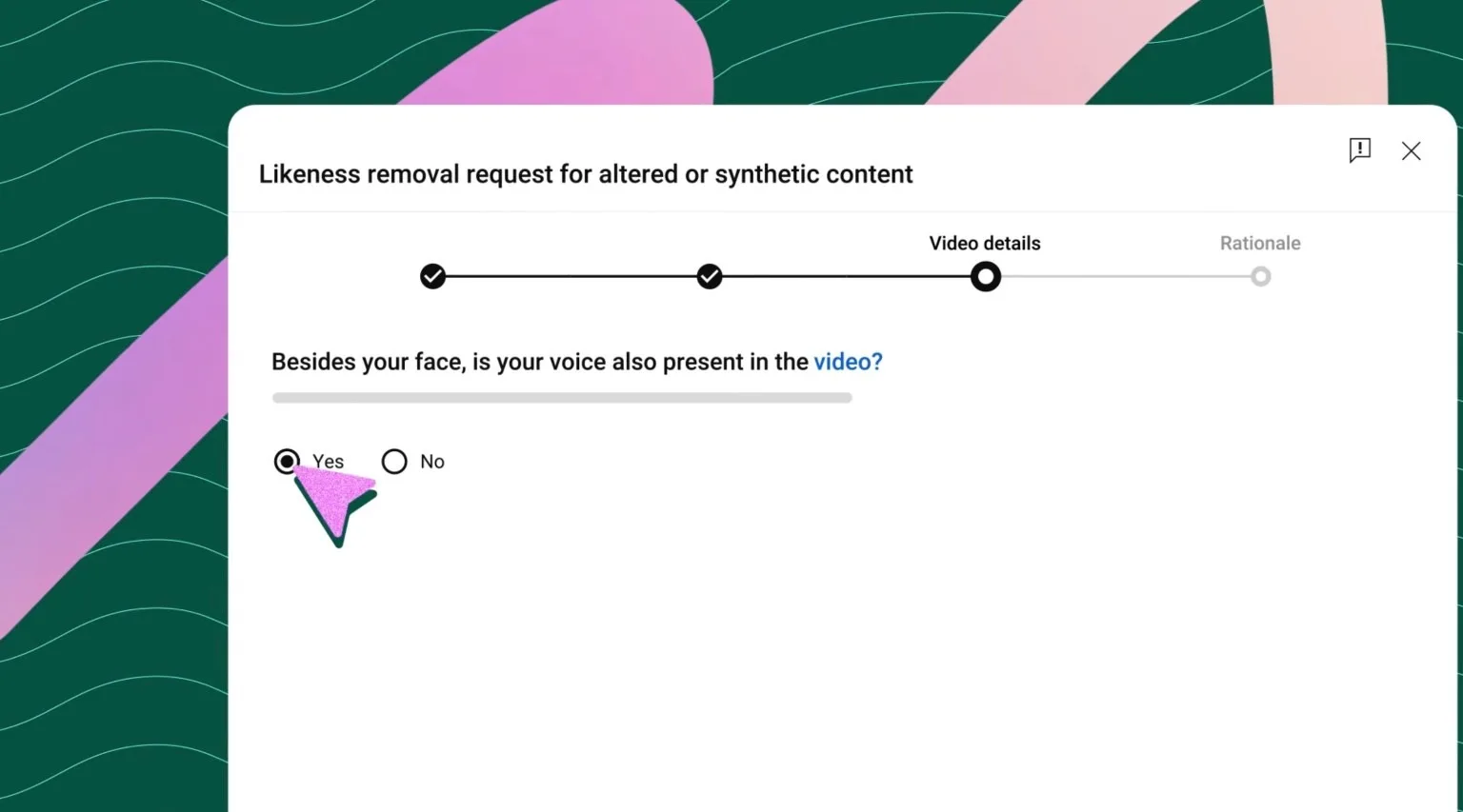

Pour accéder au programme pilote, les participants doivent d’abord prouver leur identité en envoyant un selfie et une pièce d’identité officielle. Ils peuvent ensuite créer un profil, consulter les correspondances trouvées par l’outil et, le cas échéant, demander la suppression d’une vidéo. YouTube explique aussi réfléchir à des protections plus avancées à l’avenir, comme la possibilité de bloquer certains uploads avant leur mise en ligne, voire d’ouvrir un modèle proche de Content ID permettant d’en monétiser certains usages autorisés.

La plateforme n’a pas voulu révéler quels responsables politiques ou journalistes participent à cette première vague. En revanche, elle affirme vouloir élargir progressivement l’accès à cette technologie. Pour l’instant, YouTube indique que le volume de suppressions demandé par les créateurs déjà équipés reste très faible, en partie parce qu’une grande part des contenus détectés étaient jugés bénins ou même utiles à leur activité. La situation pourrait être différente pour les figures politiques ou médiatiques.

YouTube rappelle aussi que les contenus générés par IA doivent être identifiés, mais l’affichage de cette mention varie selon le type de vidéo. Sur certains contenus, l’indication apparaît surtout dans la description ; sur les sujets plus sensibles, elle peut être affichée directement de façon plus visible. Là encore, la logique de YouTube consiste à adapter le niveau d’avertissement au risque de confusion pour le public.

Un accès réservé à un programme pilote encadré

Enfin, l’entreprise soutient aussi un encadrement plus large au niveau fédéral américain, notamment via son appui au NO FAKES Act, un texte qui vise à réguler l’usage non autorisé de la voix et de l’image d’une personne par l’IA. YouTube laisse aussi entendre que sa détection pourrait plus tard couvrir d’autres éléments, comme les voix reconnaissables ou certains personnages célèbres.

Au fond, cette annonce montre surtout que YouTube veut traiter les deepfakes politiques et médiatiques comme un risque distinct du reste du contenu IA. La plateforme ne remet pas en cause tous les usages génératifs, mais elle commence à bâtir une protection spécifique pour les personnes les plus exposées à l’imitation trompeuse. Et à l’approche d’échéances électorales et de campagnes toujours plus numérisées, ce type d’outil pourrait vite devenir beaucoup plus stratégique qu’un simple réglage de modération.