Anthropic déploie une nouvelle mise à jour majeure de Claude, son assistant conversationnel, qui lui permet désormais de se souvenir automatiquement des conversations passées — sans que l’utilisateur ait besoin de le lui rappeler à chaque fois.

Claude : Une mémoire activable dès aujourd’hui pour les abonnés Max

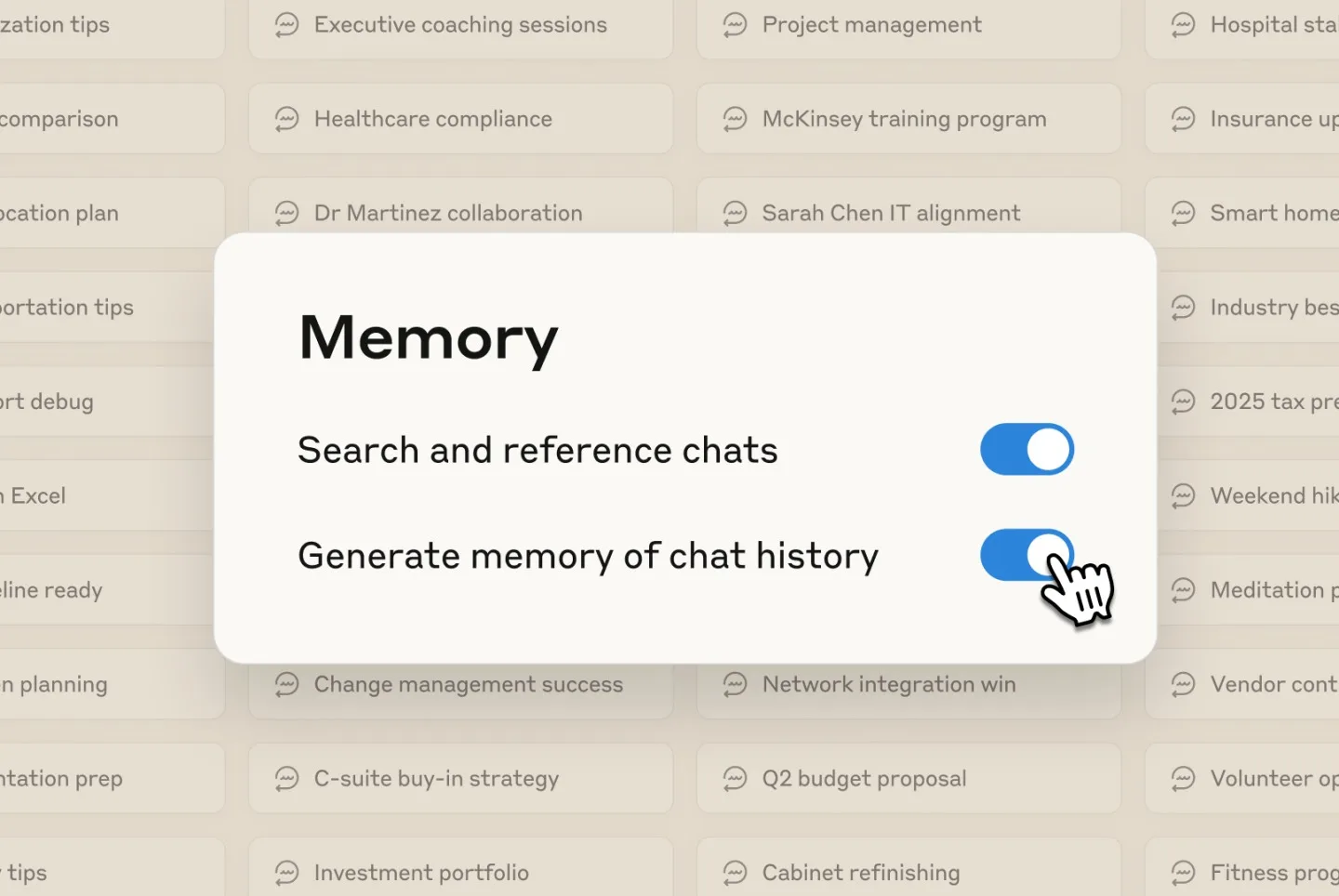

Dès aujourd’hui, les abonnés Max peuvent activer la mémoire dans les paramètres de Claude. Les abonnés Pro y auront accès « dans les prochains jours », tandis que les utilisateurs Team et Enterprise bénéficiaient déjà de la fonction depuis septembre.

Aucune date n’a encore été donnée pour les utilisateurs gratuits.

Concrètement, cette mémoire permet à Claude de retenir des informations importantes d’une discussion à l’autre : projets, préférences, ou contexte professionnel.

Une transparence totale sur ce que l’IA retient

Anthropic insiste sur un mot d’ordre : la transparence. Chaque utilisateur pourra voir précisément ce que Claude a mémorisé, et non de simples résumés flous.

Il sera possible de :

- modifier ou supprimer une mémoire spécifique,

- demander à Claude d’oublier certaines informations (« oublie mon ancien poste », par exemple),

- ou même de créer des « espaces mémoire distincts » pour séparer vie pro, projets personnels ou échanges privés.

Cette approche vise à éviter les mélanges entre différents contextes — un problème fréquent avec les assistants IA multitâches.

Importer ou exporter ses souvenirs

Anthropic promet aussi une portabilité totale :

les utilisateurs pourront importer leurs souvenirs depuis ChatGPT ou Gemini (en copiant-collant les informations), mais aussi exporter à tout moment leurs données depuis Claude.

« Aucun verrouillage », précise la startup.

Une avancée, mais aussi des risques

Avec cette fonctionnalité, Claude rattrape ses concurrents directs, OpenAI et Google, qui avaient déjà introduit la mémoire dans ChatGPT et Gemini en 2024.

Mais, cette évolution divise : certains experts alertent sur le risque de « psychose de l’IA », lorsque les assistants renforcent des croyances erronées ou des comportements obsessionnels à force de « connaître » trop bien leurs utilisateurs.

Claude devient donc plus personnel, plus utile — et potentiellement plus envahissant. Pour Anthropic, la mémoire est une étape clé pour rendre son assistant plus fluide, contextuel et cohérent dans le temps, tout en gardant la confiance des utilisateurs grâce à un contrôle total des données.