Lors de sa conférence Cloud Next » 25 à Las Vegas, Google Cloud a dévoilé une série d’annonces stratégiques qui redessinent le paysage de l’intelligence artificielle d’entreprise.

De la nouvelle puce TPU Ironwood aux modèles Gemini « pensants », en passant par un ambitieux système multi-agents interopérable, Google entend imposer sa vision d’une IA plus puissante, plus efficace et surtout plus collaborative.

Ironwood : des performances sans précédent pour l’ère de l’inférence

Le cœur des annonces infrastructurelles est la nouvelle puce TPU Ironwood, conçue exclusivement pour l’inférence, c’est-à-dire la mise en œuvre des modèles déjà entraînés. Chaque pod Ironwood, composé de 9 216 puces, offre une puissance de calcul inégalée de 42 exaflops, soit 24 fois plus que le supercalculateur El Capitan, actuellement le plus rapide du monde.

Chaque puce embarque 192 Go de mémoire HBM et délivre une bande passante de 7,2 térabits par seconde, tout en doublant l’efficacité énergétique par rapport à la génération précédente, Trillium. Google affirme que cette architecture permet de répondre à la montée en flèche de la demande en IA, tout en réduisant significativement les coûts énergétiques pour les entreprises.

Gemini 2.5 : des modèles capables de raisonner

Côté logiciels, Google enrichit sa gamme avec Gemini 2.5 Pro, un modèle hautement performant dédié à des cas d’usage complexes comme la recherche médicale ou la modélisation financière.

Sa déclinaison, Gemini 2.5 Flash, plus économique, adapte dynamiquement la profondeur de raisonnement en fonction de la complexité de la requête. Contrairement aux LLM traditionnels, ces modèles adoptent une approche de raisonnement multi-étapes, avec une capacité d’auto-évaluation, comme une forme de réflexion algorithmique.

Une IA créative et multimédia centralisée dans Vertex AI

Google a également étendu ses capacités en création de contenu avec une suite d’outils génératifs réunis au sein de Vertex AI.

Les modèles Imagen pour l’image, Veo pour la vidéo, Chirp pour l’audio, et Lyria pour la génération musicale à partir de texte peuvent désormais être combinés dans des flux créatifs. Lors d’une démonstration, Google a montré comment créer une vidéo promotionnelle avec une bande-son personnalisée et des effets avancés, sans compétences en montage.

Un écosystème d’agents IA interconnectés

Mais l’innovation la plus audacieuse est sans doute la création d’un écosystème multi-agents. Google propose désormais un Agent Development Kit, permettant de construire des systèmes multi-agents avec moins de 100 lignes de code. Le tout repose sur un protocole ouvert baptisé Agent2Agent, destiné à permettre la communication entre agents IA issus de fournisseurs différents. Plus de 50 entreprises, dont Salesforce, SAP et ServiceNow, soutiennent déjà cette norme.

Pour les utilisateurs non techniques, Google introduit Agent Space, une interface centralisant tous les agents disponibles, ainsi que Agent Designer, une plateforme no-code pour créer ses propres assistants intelligents personnalisés.

Lors de la conférence, Google a montré comment un gestionnaire de comptes bancaires pouvait utiliser ces outils pour analyser un portefeuille client, anticiper les problèmes de trésorerie et rédiger automatiquement une communication — sans écrire une seule ligne de code.

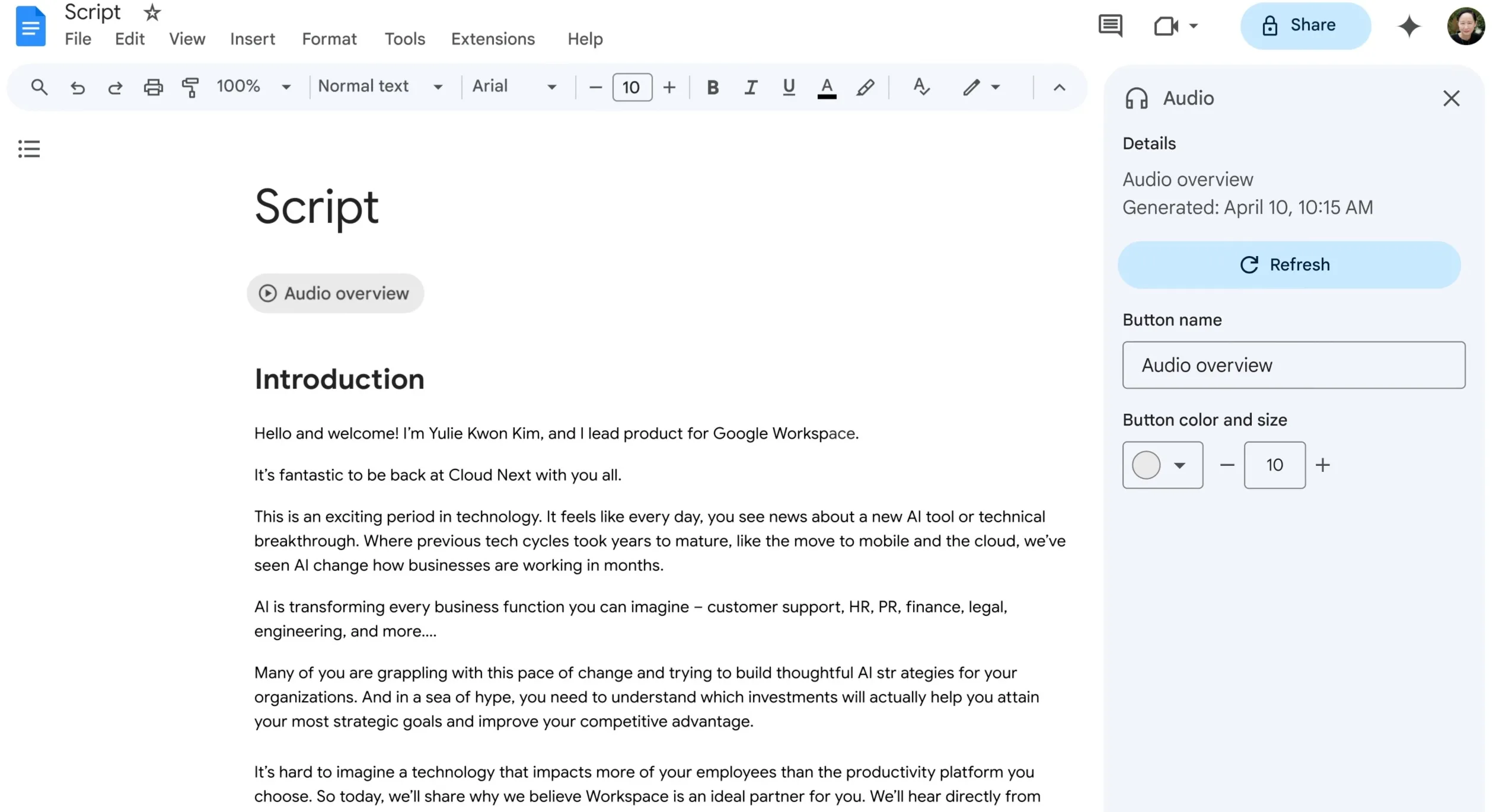

L’IA dans Workspace et les cas d’usage concrets

Google intègre aussi ses innovations dans la suite Workspace. Dans Google Sheets, une nouvelle fonction baptisée « Help me Analyze » permet d’extraire automatiquement des insights à partir de données brutes. Dans Google Docs, la fonctionnalité Audio Overviews génère une version audio réaliste des documents. Ces nouveautés s’ajoutent à l’adoption croissante d’agents spécialisés, notamment dans les secteurs du service client, de la création, de la data, du développement ou encore de la cybersécurité.

Des entreprises comme Wendy’s utilisent l’IA de Google pour automatiser les commandes drive, et The Home Depot déploie l’agent « Magic Apron » pour guider les consommateurs dans leurs projets de bricolage. Quant au géant de la communication WPP, il s’appuie déjà sur Vertex AI pour industrialiser ses campagnes marketing.

Une stratégie cloud intégrée face à Microsoft et Amazon

Google se positionne face à ses concurrents historiques avec une approche intégrée et ouverte. Là où Microsoft capitalise sur OpenAI dans Azure, et Amazon sur ses puces Trainium, Google joue la carte de la maîtrise complète, du silicium à l’application, avec une ouverture aux standards interopérables.

Sa stratégie repose sur trois piliers : infrastructure de classe mondiale, plateforme IA complète (modèles + agents), et interopérabilité multi-cloud.

Google veut bâtir l’architecture de l’IA moderne

Au lieu de s’enfermer dans une logique propriétaire, Google propose une IA distribuée, modulaire et communicante, capable de s’intégrer à n’importe quel environnement. L’accent mis sur l’inférence, les économies d’échelle, et la coopération entre agents IA ouvre la voie à une adoption massive et efficiente de l’IA par les entreprises.

Avec Ironwood, Gemini 2.5, et son écosystème d’agents interopérables, Google n’ambitionne pas seulement de rendre les machines plus intelligentes, mais de leur apprendre à travailler ensemble.