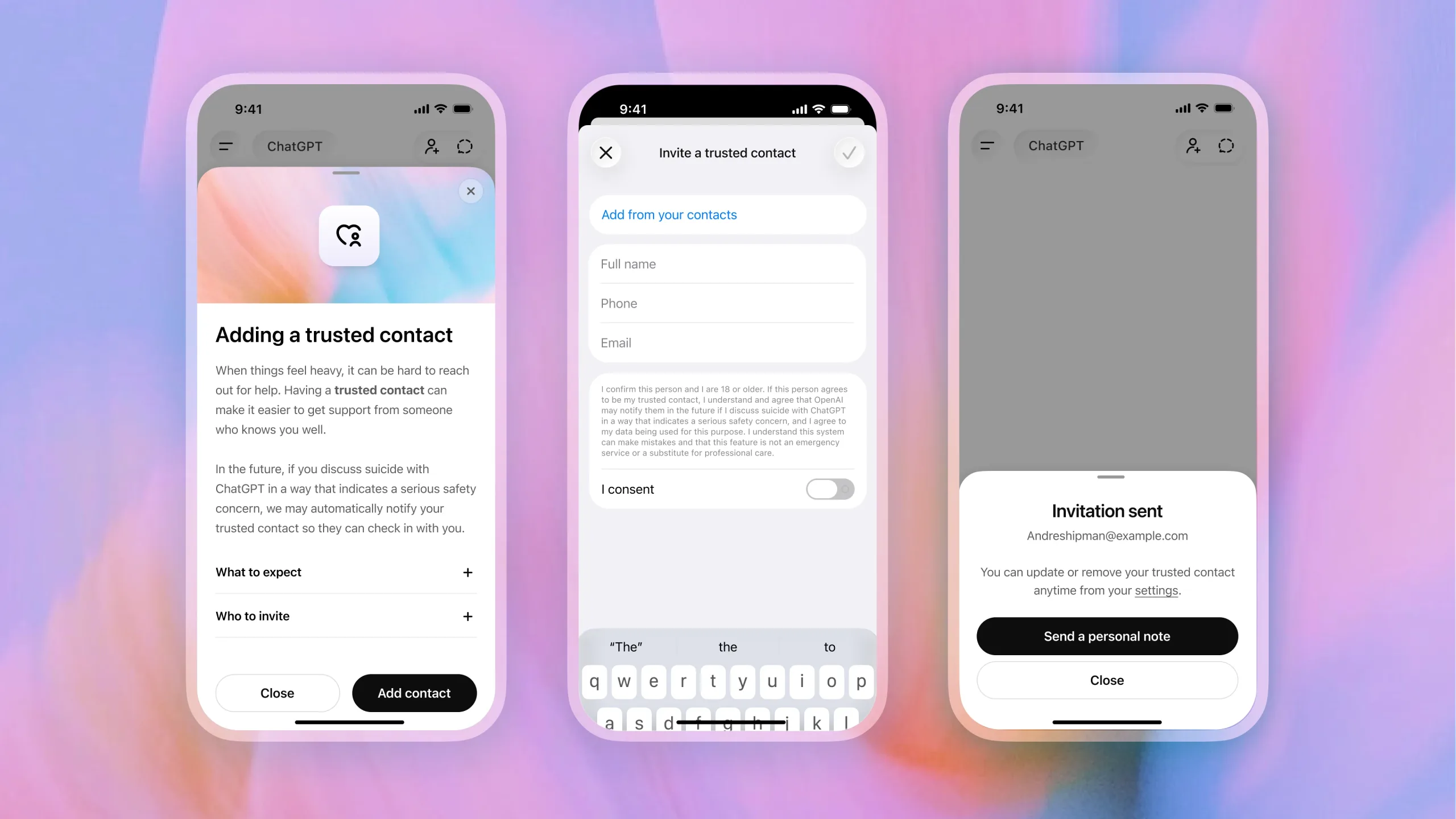

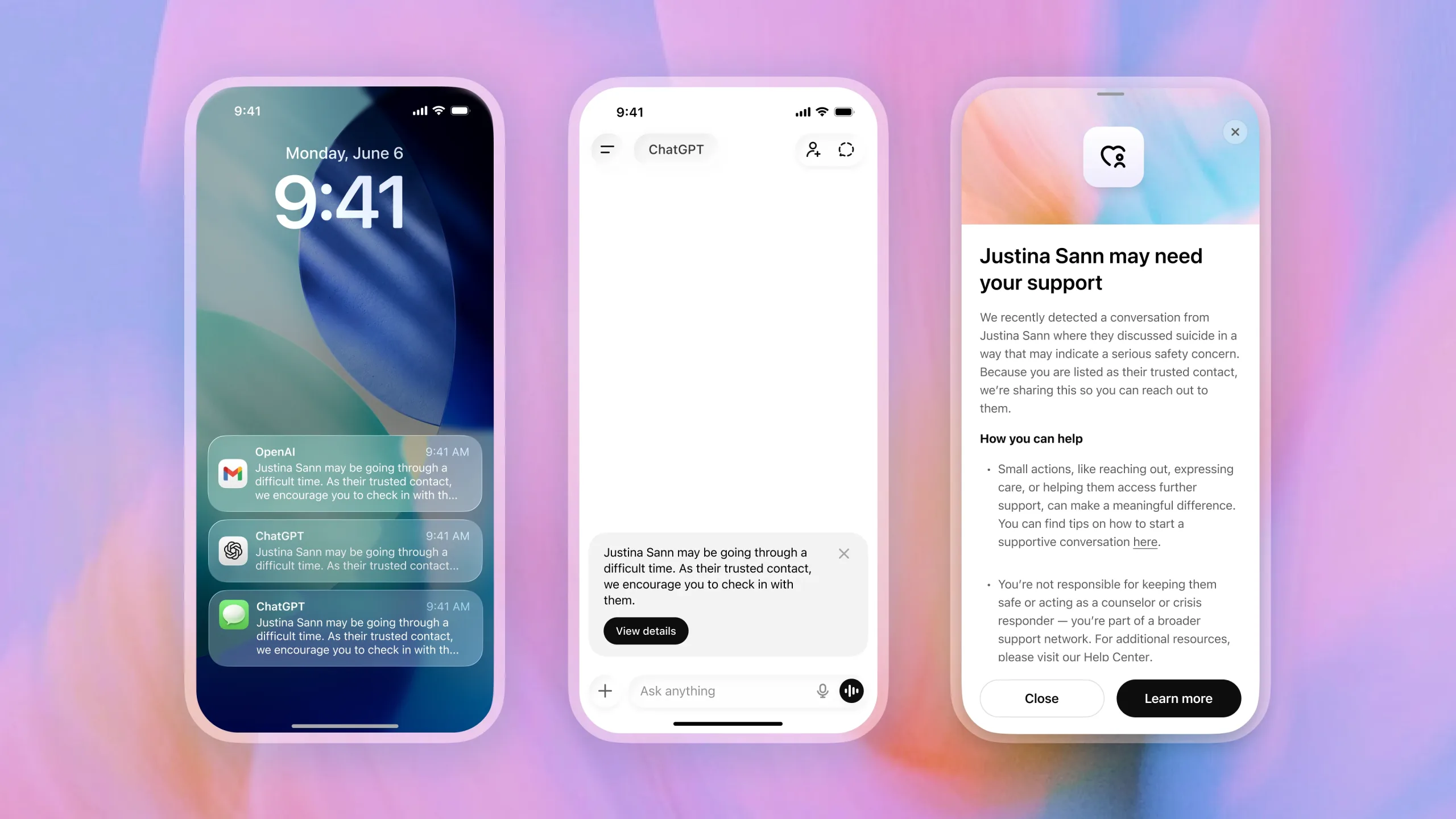

OpenAI déploie une nouvelle fonction de sécurité dans ChatGPT : « Trusted Contact ». Elle permet à un utilisateur adulte de désigner une personne de confiance pouvant être alertée si une conversation laisse apparaître un risque sérieux d’automutilation ou de suicide.

Un contact de confiance, mais pas une alerte automatique

L’option est facultative. L’utilisateur choisit une personne majeure, qui reçoit une invitation et dispose d’une semaine pour accepter. Si ChatGPT détecte un signal inquiétant, l’utilisateur est d’abord encouragé à contacter lui-même cette personne.

Ensuite, une équipe humaine formée examine le cas avant toute notification.

L’alerte envoyée ne partage pas les conversations ni les détails privés. Elle indique seulement qu’un sujet lié à l’automutilation a été évoqué de manière préoccupante, afin d’inciter le proche à prendre des nouvelles.

Une réponse à un usage devenu très intime

Cette fonction prolonge les outils déjà proposés pour les comptes adolescents liés à un parent ou tuteur. Elle arrive aussi dans un contexte sensible, alors qu’OpenAI fait face à une attention accrue sur les conversations de crise et la manière dont les chatbots répondent aux utilisateurs vulnérables.

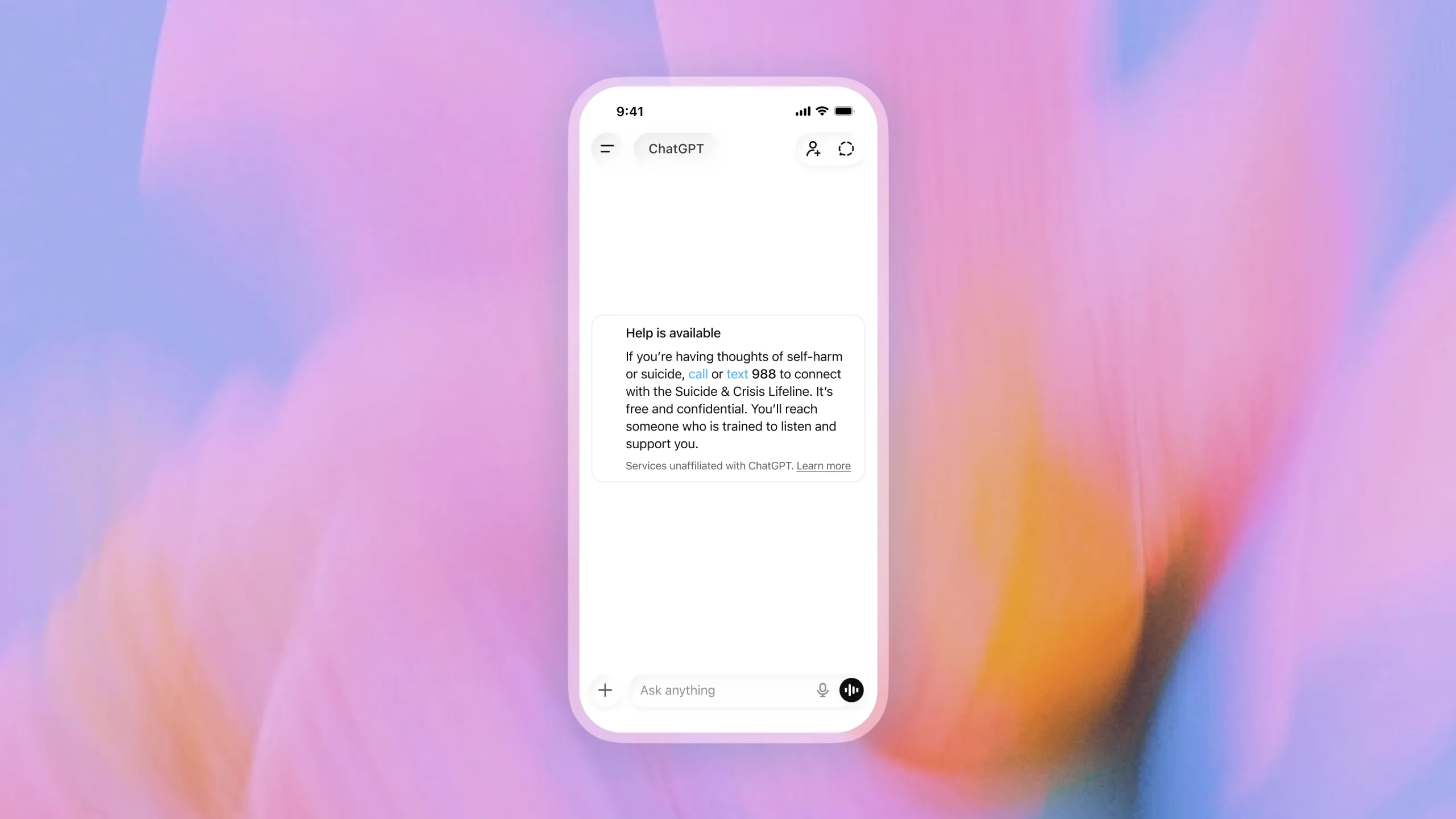

Un garde-fou, pas une solution médicale

Trusted Contact ne remplace ni les lignes d’urgence, ni les services de secours, ni un suivi professionnel. Mais il reconnaît une réalité : ChatGPT est parfois utilisé comme espace de confidence, y compris sur des sujets lourds.

Avec cette fonction, OpenAI admet implicitement qu’un chatbot ne peut pas tout porter seul. Dans les moments critiques, la meilleure réponse reste parfois de faire revenir un humain dans la boucle.