Google a présenté un nouveau modèle d’intelligence artificielle baptisé Gemini 2.5 Computer Use, conçu pour interagir directement avec des interfaces Web comme un véritable utilisateur humain.

Ce modèle expérimental peut naviguer sur un navigateur, comprendre visuellement les éléments à l’écran et exécuter des actions, telles que remplir et soumettre un formulaire.

Gemini 2.5 Computer Use : Une IA qui comprend et agit comme un humain

Le modèle s’appuie sur les capacités de compréhension visuelle et de raisonnement de Gemini 2.5 pour analyser les pages Web et accomplir des tâches complexes, même sur des sites ne disposant pas d’API.

Google explique que cette technologie peut servir à :

- Tester des interfaces utilisateur (UI),

- Automatiser des tâches de navigation dans des environnements conçus pour les humains,

- Ou encore simuler des actions humaines pour des recherches et des démonstrations.

Cette approche s’inspire de projets internes comme « AI Mode » et « Project Mariner », où des agents intelligents étaient capables d’exécuter seuls des actions dans un navigateur — comme ajouter automatiquement des produits à un panier en fonction d’une liste d’ingrédients.

Une réponse directe à OpenAI et Anthropic

L’annonce de Google intervient un jour seulement après les DevDay d’OpenAI, où Sam Altman a présenté les nouvelles « apps » de ChatGPT et ses fonctionnalités d’agents autonomes capables de réaliser des tâches complexes.

De son côté, Anthropic a déjà lancé en 2024 une version de Claude dotée de capacités similaires de « computer use ». Google entre donc dans la course des IA capables d’agir dans un environnement réel, une étape cruciale pour les futurs « agents autonomes » capables d’assister les utilisateurs dans leur travail quotidien.

Une IA qui sait utiliser un navigateur — mais pas encore tout un PC

Contrairement aux outils concurrents, Gemini 2.5 Computer Use ne contrôle pas l’intégralité d’un ordinateur.

Il est limité à un navigateur web et prend actuellement en charge 13 actions différentes, notamment :

- Ouvrir un navigateur,

- Cliquer,

- Taper du texte,

- Faire glisser et déposer des éléments.

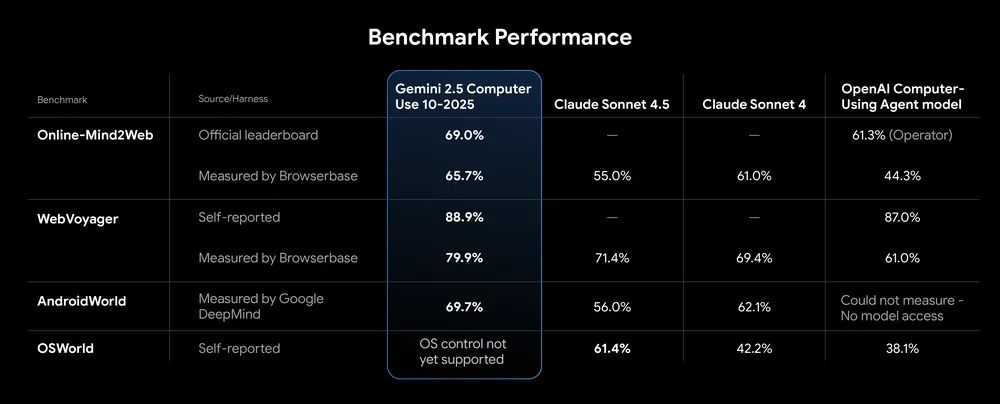

Google précise que le modèle « n’est pas encore optimisé pour un contrôle complet du système d’exploitation », mais qu’il surpasse déjà ses concurrents sur plusieurs benchmarks Web et mobiles.

L’entreprise a également partagé des vidéos de démonstration — accélérées trois fois — où l’on peut voir l’IA effectuer diverses tâches comme jouer au jeu 2048 ou naviguer sur Hacker News à la recherche de sujets tendances.

Disponibilité pour les développeurs

Les développeurs peuvent dès maintenant tester Gemini 2.5 Computer Use via :

- Google AI Studio,

- Vertex AI,

- Et une démo publique sur Browserbase, où il est possible d’observer en temps réel la façon dont l’IA interagit avec le web.