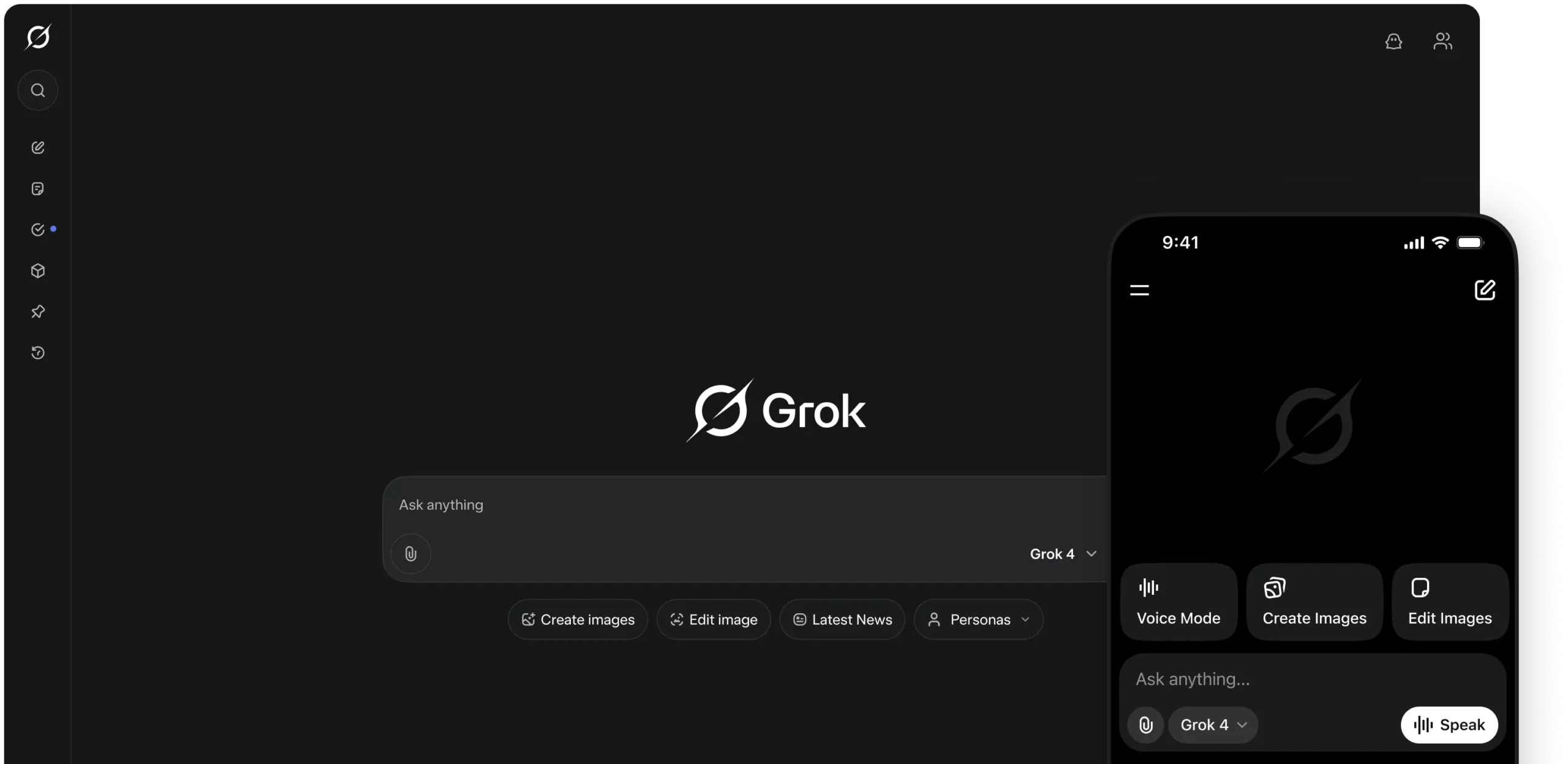

L’affaire secoue le monde de l’intelligence artificielle. Selon un rapport explosif de Forbes, plus de 370 000 conversations issues du chatbot Grok (développé par xAI, société d’Elon Musk) ont été référencées par Google — sans que les utilisateurs en soient informés.

Le problème ? Ces discussions, souvent très personnelles, sont devenues accessibles publiquement via une simple recherche. On y trouve des détails intimes, parfois sensibles ou même illégaux. Une faille grave de confidentialité qui relance le débat sur la sécurité des IA conversationnelles.

Un simple bouton « Partager »… qui rend tout public

Tout part d’une fonctionnalité anodine : le bouton « Partager » de Grok. Lorsqu’un utilisateur l’utilise, une URL publique est générée, mais aucune balise empêchant l’indexation par les moteurs de recherche (type « noindex ») n’est ajoutée.

Conséquence directe : Google a indexé ces pages, les rendant visibles à n’importe qui.

Parmi les contenus retrouvés :

- Des problèmes de santé

- Des conflits de couple

- Des mots de passe ou données sensibles

- Des questions sur la fabrication de drogues

- Et même des projets criminels simulés

Des liens sans expiration ni contrôle d’accès

Contrairement à un message privé ou à une capture d’écran :

- Ces liens sont permanents

- Aucune authentification n’est nécessaire

- Ils peuvent être retrouvés en tapant quelques mots-clés sur Google

Bien que les conversations soient anonymisées, certains éléments pourraient permettre d’identifier l’auteur, notamment si des noms, lieux ou événements personnels sont évoqués.

Que faire si vous avez partagé une conversation Grok ?

Voici les mesures à prendre immédiatement :

- Ne partagez plus de conversations via Grok, sauf si vous êtes parfaitement à l’aise avec une diffusion publique.

- Si vous avez déjà partagé un lien, essayez de le retrouver et utilisez l’outil de suppression de contenu de Google : https://www.google.com/webmasters/tools/removals

- Sur X (Twitter), désactivez l’option permettant d’utiliser vos posts pour l’entraînement de Grok dans les paramètres de confidentialité.

Un problème récurrent chez les chatbots IA

Grok n’est pas le seul à avoir fait fuiter des conversations :

- OpenAI a dû retirer des conversations ChatGPT des résultats Google après une polémique similaire.

- Meta a été critiquée lorsque des discussions avec son IA sont apparues dans la section « Découverte » de ses apps.

Les conversations avec l’IA sont de plus en plus personnelles, proches d’un journal intime. Mais les protections ne suivent pas toujours.

L’illusion de la confidentialité avec l’IA

Les utilisateurs confient de plus en plus leurs pensées profondes aux IA thérapies improvisées, jeux de rôle romantiques et confessions personnelles. Mais, les entreprises, elles, favorisent le partage pour accroître l’engagement — au détriment de la vie privée.

Cette affaire Grok montre que rien n’est vraiment privé sur Internet, surtout dans l’univers encore immature de l’intelligence artificielle générative. Tant que les éditeurs d’IA continueront à pousser des outils de partage sans garde-fous, la prudence reste votre meilleure défense.

Ne traitez jamais une IA comme un confident. Et rappelez-vous : si vous le partagez, c’est que c’est déjà public.