En 2026, la santé devient le terrain de jeu le plus convoité de l’IA grand public. Après Microsoft Copilot Health, ChatGPT Health ou encore Claude for Healthcare, Perplexity avance ses pions avec Perplexity Health : une approche qui ne se contente plus de « chercher » sur le web, mais qui raisonne à partir de vous — vos bilans, vos traitements, vos mesures d’activité.

Une promesse aussi séduisante que sensible.

De la recherche santé « générique » à l’IA contextuelle

Jusqu’ici, l’IA santé grand public ressemblait surtout à un Google amélioré : vous posez une question, elle synthétise des sources. Le problème, c’est que vos données personnelles restent hors champ, donc les réponses restent… générales.

Perplexity reprend un constat simple : nos informations de santé sont éparpillées entre portails d’hôpitaux, applis de suivi, labos, ordonnances et historiques médicaux. Perplexity Health veut recomposer une vue unifiée pour produire des réponses personnalisées dans Perplexity Computer.

Dans le même mouvement, Microsoft a lancé Copilot Health aux États-Unis, avec l’idée d’agréger dossiers et données de wearables, tout en rappelant que ce n’est pas un outil de diagnostic.

Ce que Perplexity Health apporte concrètement

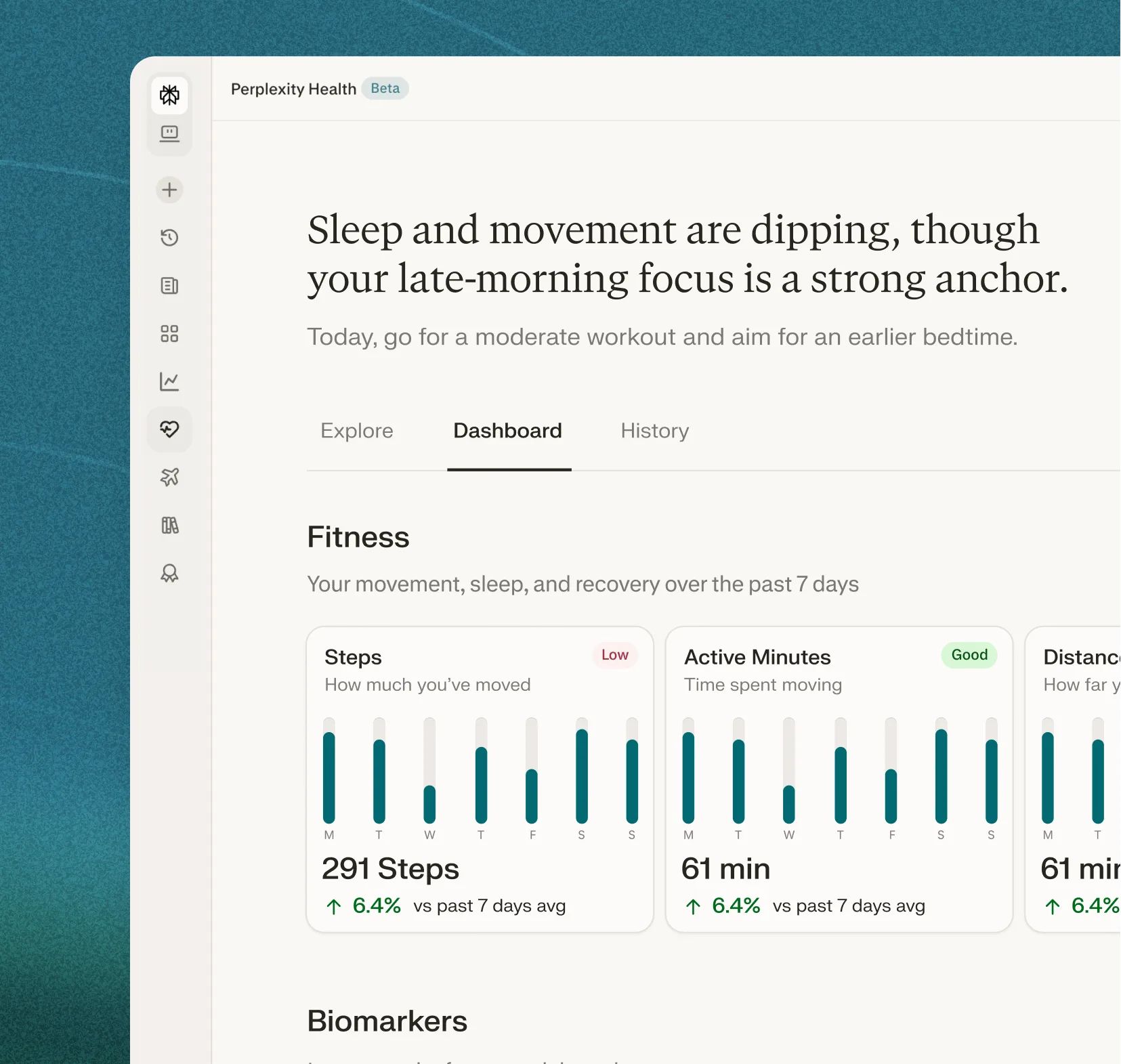

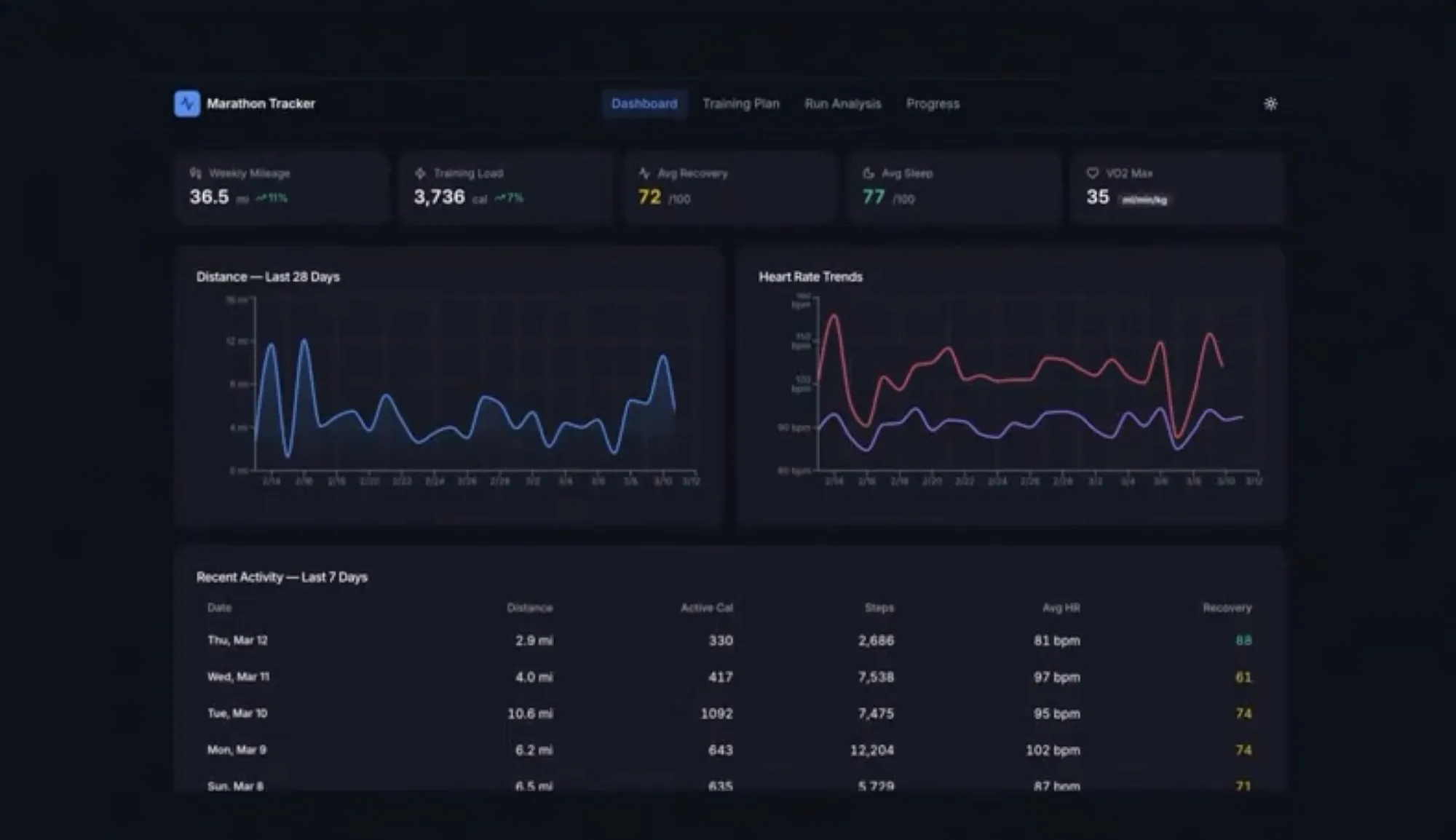

Au lancement, Perplexity Health annonce des connexions à Apple Health, des dossiers médicaux (DME) couvrant plus de 1,7 million de soignants (selon la communication produit) et des plateformes comme Fitbit, Ultrahuman, Withings… avec Oura et d’autres fonctionnalités annoncées « à venir ». L’idée : quand vous interrogez un symptôme, un marqueur (ex. fréquence cardiaque au repos) ou une tendance (fatigue, sommeil), l’IA croise activité récente, antécédents, biomarqueurs, résultats de labo — et vous répond avec ce contexte.

Perplexity promet aussi un tableau de bord personnalisé pour visualiser l’évolution des biomarqueurs et des habitudes dans le temps — une manière de passer du « point-in-time » (un examen) au continu (une trajectoire).

Pourquoi c’est différent d’une recherche santé classique ?

La différence clé tient en une phrase : une IA santé connectée n’explique pas la santé en général, elle explique votre situation.

- Une recherche classique répond : « Voici ce que dit la littérature sur X. »

- Perplexity Health ambitionne : « Voici ce que dit la littérature sur X au regard de vos données (activité, sommeil, bilans, historique) ».

C’est un changement de catégorie : on passe d’un moteur de réponse à un moteur d’interprétation. Et c’est précisément là que la valeur (et le risque) augmente.

Peut-on faire confiance à ce type d’outil ?

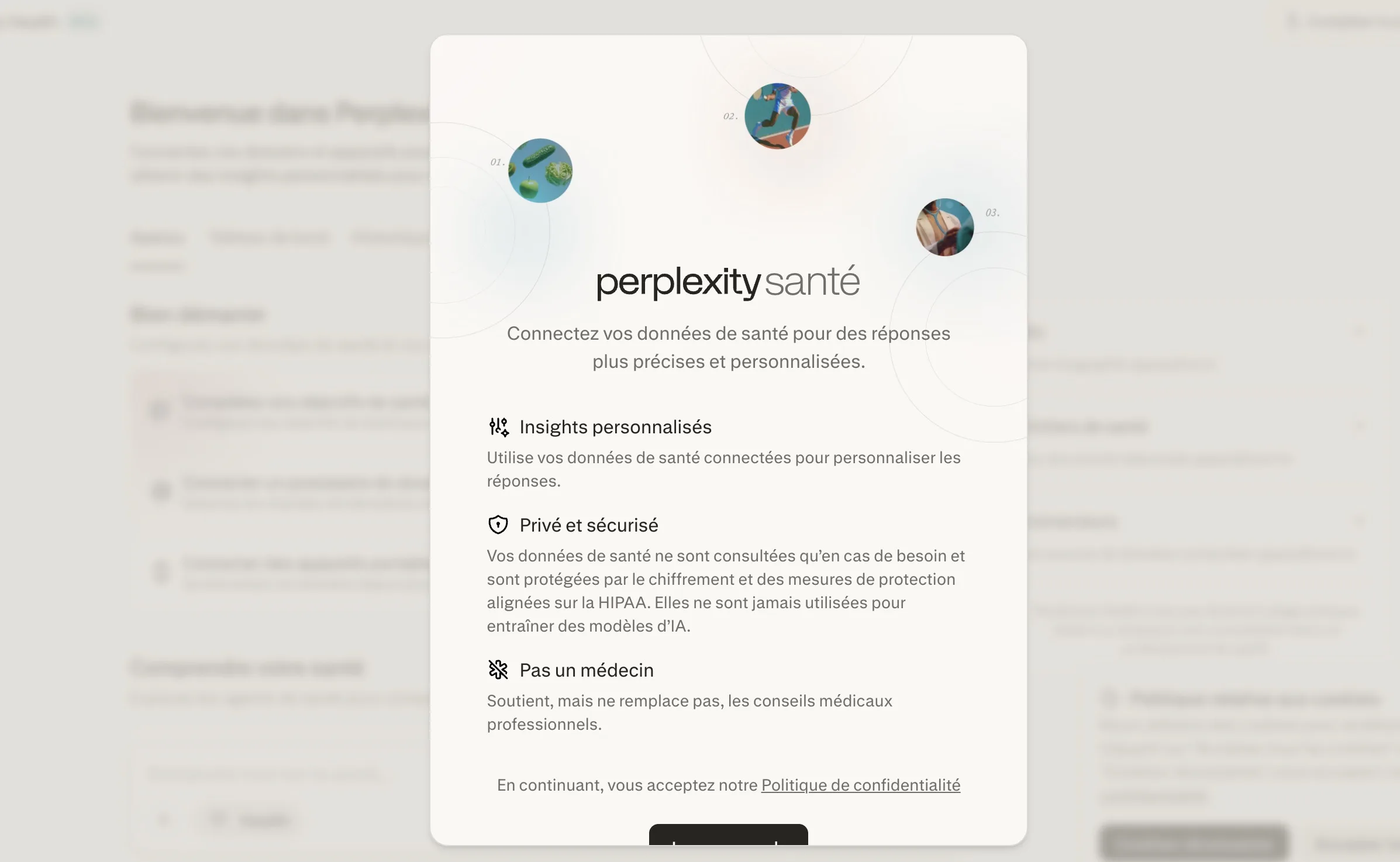

Perplexity affirme s’appuyer sur des recommandations cliniques et des revues à comité de lecture, plutôt que sur du contenu « SEO ». L’entreprise met en avant des réponses accompagnées de citations pointant vers les sources. Elle annonce aussi un Health Advisory Board (médecins, chercheurs, leaders health tech) pour cadrer les choix de produit et les standards.

Perplexity promet : données chiffrées en transit et au repos, pas d’usage pour l’entraînement des modèles, pas de vente à des tiers, possibilité de déconnecter les sources et supprimer les données.

Cela dit, il faut lire ces promesses comme un contrat de confiance : en santé, la barre n’est pas « est-ce chiffré ? », mais « qui accède à quoi, dans quel cadre, et avec quelles garanties auditables ? ». Autrement dit : les mots comptent, mais les implémentations comptent plus.

Même Microsoft insiste sur le fait que Copilot Health n’est pas destiné à diagnostiquer/traiter et ne remplace pas un avis médical. C’est une précaution qui va devenir standard, parce que l’IA peut synthétiser, prioriser, suggérer… mais aussi se tromper, surtout quand la question est clinique.

Déploiement : pour qui, et quand ?

Perplexity Health sur Computer est annoncé pour un déploiement progressif auprès des abonnés Pro et Max aux États-Unis sur les prochaines semaines.

Perplexity Health illustre parfaitement la nouvelle course : connecter les IA à notre réalité, pas seulement au web. Si l’exécution est solide, c’est potentiellement un saut d’usage — comprendre ses tendances, préparer une consultation, repérer des signaux faibles. Mais en ouvrant la porte aux données les plus intimes, l’IA joue aussi sa crédibilité sur un terrain où la moindre erreur coûte cher : la confiance, elle, ne se « scale » pas.