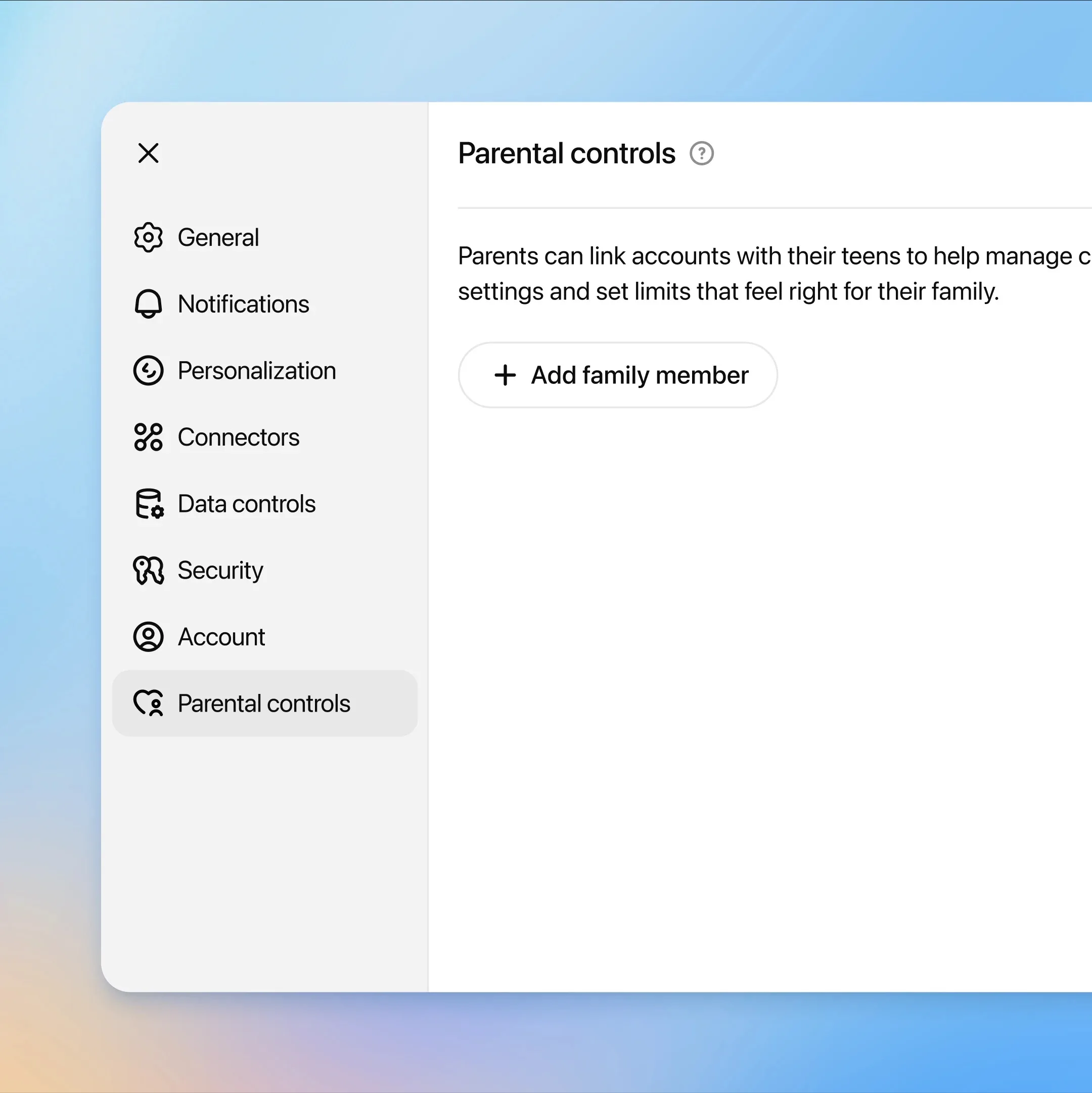

OpenAI vient de déployer une fonctionnalité très attendue : des contrôles parentaux intégrés à ChatGPT. Ces outils, disponibles dès maintenant sur le Web (et bientôt sur mobile), permettent aux parents de paramétrer l’expérience de leurs adolescents, avec l’objectif de rendre l’IA plus sûre et plus adaptée à leur âge.

Comment fonctionnent les contrôles parentaux sur ChatGPT ?

Le système est simple :

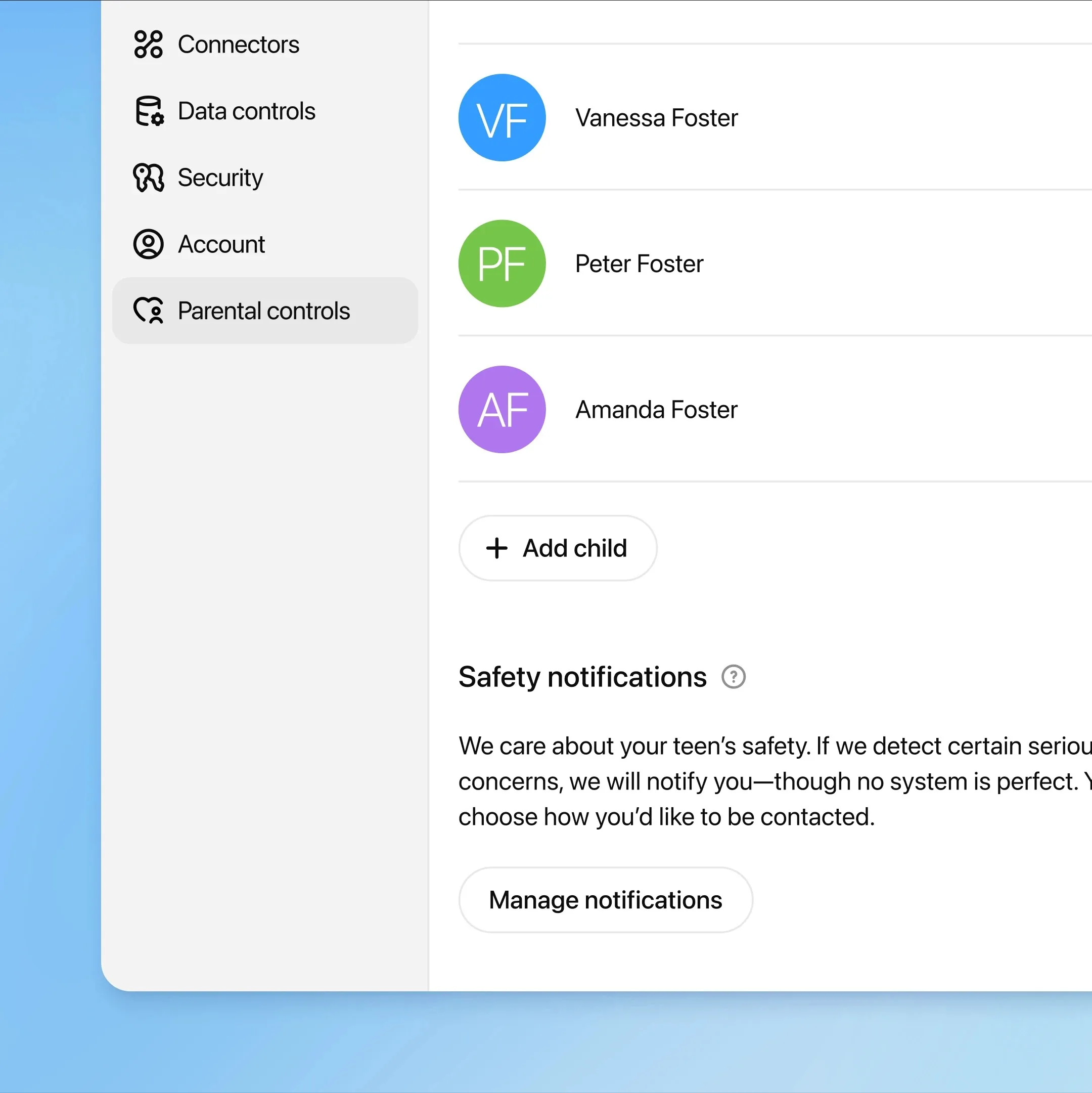

- Un parent ou tuteur envoie une invitation à son ado pour lier son compte.

- L’ado accepte ou refuse.

- Une fois liés, le parent accède à un tableau de bord dédié pour gérer l’expérience de ChatGPT.

Les ados peuvent se désinscrire à tout moment, mais les parents sont notifiés en cas de déconnexion. Important : les parents n’ont pas accès aux conversations de leur ado, sauf dans des cas rares de risque grave identifié par l’IA et revu par une équipe spécialisée.

Des protections renforcées pour les jeunes utilisateurs

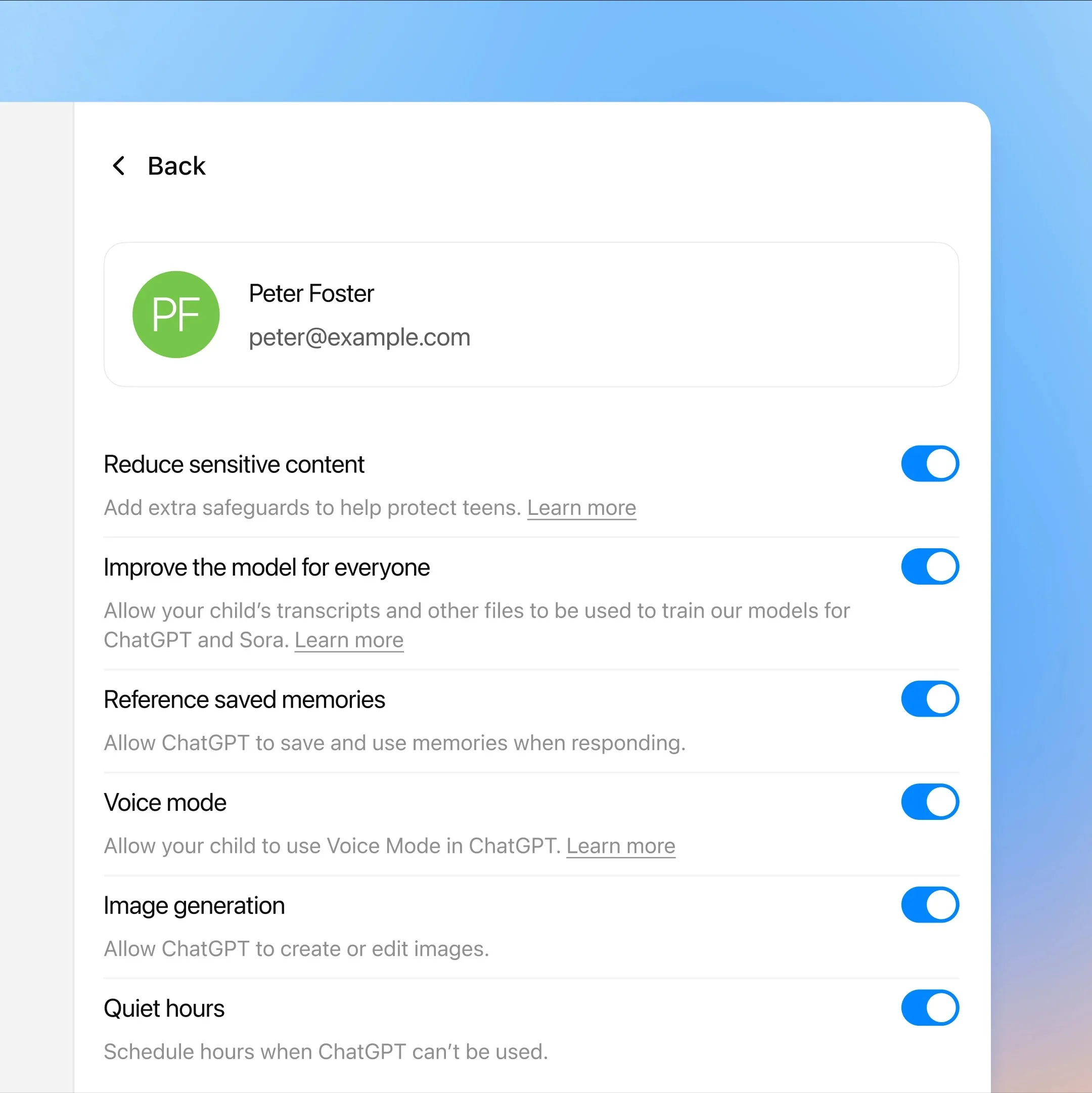

Une fois le compte lié, ChatGPT active par défaut des protections supplémentaires :

- Réduction du contenu sensible (violence, sexualité, défis viraux, idéaux de beauté extrêmes).

- Limitation des scénarios de jeu de rôle inappropriés.

- Filtres renforcés contre les conseils à risque (ex. automutilation).

Les options disponibles pour les parents

OpenAI propose aux parents des réglages fins et personnalisables :

- Définir des « heures calmes » : bloquer ChatGPT à certains moments (ex. après 22 h).

- Désactiver le mode vocal : échanges uniquement en texte.

- Désactiver la mémoire : ChatGPT n’enregistre pas les conversations passées.

- Bloquer la génération d’images.

- Exclure les conversations des données d’entraînement des modèles d’OpenAI.

- Recevoir des alertes (email, SMS, push) en cas d’activité préoccupante.

Ces réglages sont optionnels et peuvent être ajustés à tout moment via le compte parent.

Une réponse tardive mais nécessaire

Cette nouveauté arrive dans un contexte sensible. OpenAI est poursuivie après le suicide d’un adolescent, Adam Raine, qui aurait été « coaché » par ChatGPT dans ses messages privés. L’affaire a été évoquée au Sénat américain et a mis en lumière l’absence de garde-fous robustes pour les mineurs.

Matthew Raine, le père de l’adolescent, a déclaré lors de l’audition : « Ce qui a commencé comme un assistant pour les devoirs est devenu un confident, puis un coach au suicide. En tant que parents, vous ne pouvez pas imaginer ce que c’est que de lire une telle conversation ».

OpenAI dit avoir travaillé avec des experts en sécurité des mineurs, l’association Common Sense Media et les procureurs généraux de Californie et du Delaware pour concevoir ces outils.

Un premier pas, mais pas suffisant

Ces contrôles parentaux marquent une étape importante vers un ChatGPT plus sûr pour les ados. Mais comme le rappelle Robbie Torney, Senior Director chez Common Sense Media : « Les contrôles parentaux sont un bon point de départ, mais ils ne remplacent pas le dialogue et l’éducation. Ils fonctionnent mieux combinés à des règles claires et à une implication active des parents ».

En parallèle, OpenAI prépare un système de détection automatique d’âge pour appliquer les protections sans intervention parentale — une mesure qui pourrait bouleverser l’accès des mineurs aux IA dans les prochaines années.

Protéger tout en éduquer

Les contrôles parentaux d’OpenAI offrent aux familles un nouvel outil pour encadrer l’utilisation de l’IA. Mais au-delà de la technique, la clé reste l’éducation aux usages responsables et l’apprentissage du recul face à l’information générée par l’IA, dans un monde où la frontière entre réel et virtuel est de plus en plus floue.