Google veut rendre l’IA locale réellement exploitable sur des appareils grand public. Avec l’arrivée des nouveaux « MTP drafters » pour Gemma 4, la firme promet des gains de vitesse majeurs sans sacrifier la qualité des réponses.

Gemma 4 gagne un mode turbo

Google a lancé de nouveaux modules expérimentaux baptisés Multi-Token Prediction (MTP) pour ses modèles ouverts Gemma 4.

Le principe repose sur une technique appelée décodage hypothétique : au lieu de générer les mots un par un de manière classique, un petit modèle auxiliaire tente de prédire plusieurs tokens à l’avance pendant que le modèle principal vérifie ces prédictions en parallèle.

Résultat : une génération beaucoup plus rapide, notamment sur du matériel limité, comme les smartphones ou les GPU grand public.

Pourquoi l’IA locale est souvent lente ?

Les Large Language Model (LLM) fonctionnent normalement de manière auto-régressive : chaque token dépend du précédent. Le problème, c’est que cette méthode sollicite énormément la mémoire vidéo et les transferts de données entre mémoire et processeur.

Sur des infrastructures cloud optimisées comme celles de Gemini, ce n’est pas un problème majeur. Mais sur un PC ou un téléphone, les temps d’attente augmentent rapidement.

Les drafters MTP exploitent justement les périodes où les unités de calcul restent sous-utilisées pour générer des séquences spéculatives en avance.

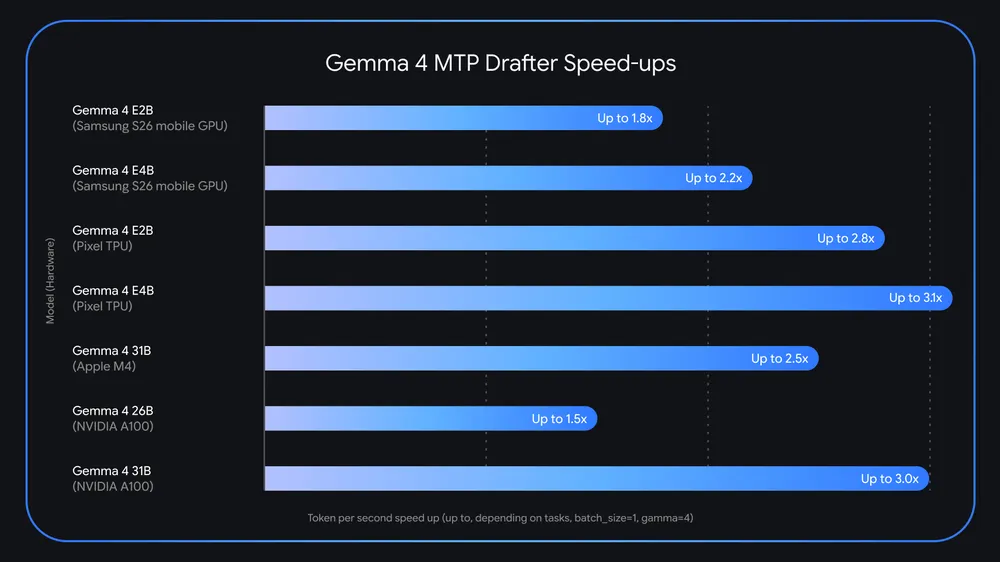

Jusqu’à 3x plus rapide sur mobile

Google affirme que certains modèles Gemma 4 peuvent désormais tourner jusqu’à trois fois plus vite selon le matériel utilisé :

- Gemma E2B : jusqu’à 2,8x plus rapide sur Pixel

- Gemma E4B : jusqu’à 3,1x plus rapide

- Gemma 31B : environ 2,5x plus rapide sur puces Apple M4

L’entreprise précise également que cette approche n’entraîne théoriquement aucune dégradation de qualité, puisque le modèle principal valide les tokens avant affichage.

Une stratégie importante pour l’IA hors cloud

Cette évolution est loin d’être anodine. L’IA locale devient un enjeu majeur pour l’industrie : meilleure confidentialité, réduction des coûts cloud, fonctionnement hors connexion et latence réduite.

Google pousse clairement Gemma comme alternative ouverte et locale à ses modèles Gemini cloud.

Le changement de licence vers Apache 2.0 va aussi dans ce sens : Google cherche désormais à séduire développeurs, entreprises et communautés open source plus agressivement.

Le vrai combat : rendre l’IA personnelle

L’objectif dépasse la simple vitesse. Pour que l’IA devienne omniprésente sur PC, smartphones ou objets connectés, elle doit fonctionner efficacement sur du matériel courant.

Avec MTP, Google tente précisément de résoudre ce problème : faire tourner des modèles puissants localement sans exiger des infrastructures de datacenter.

Et dans cette bataille, la rapidité compte presque autant que l’intelligence.