Google franchit une nouvelle étape dans la transparence des contenus générés par IA. Dès aujourd’hui, il devient possible de demander directement à Gemini si une image a été créée — ou modifiée — par un outil d’IA Google.

Une fonction simple, presque banale en apparence, mais qui pourrait devenir essentielle à mesure que la frontière entre réel et synthétique continue de s’effacer.

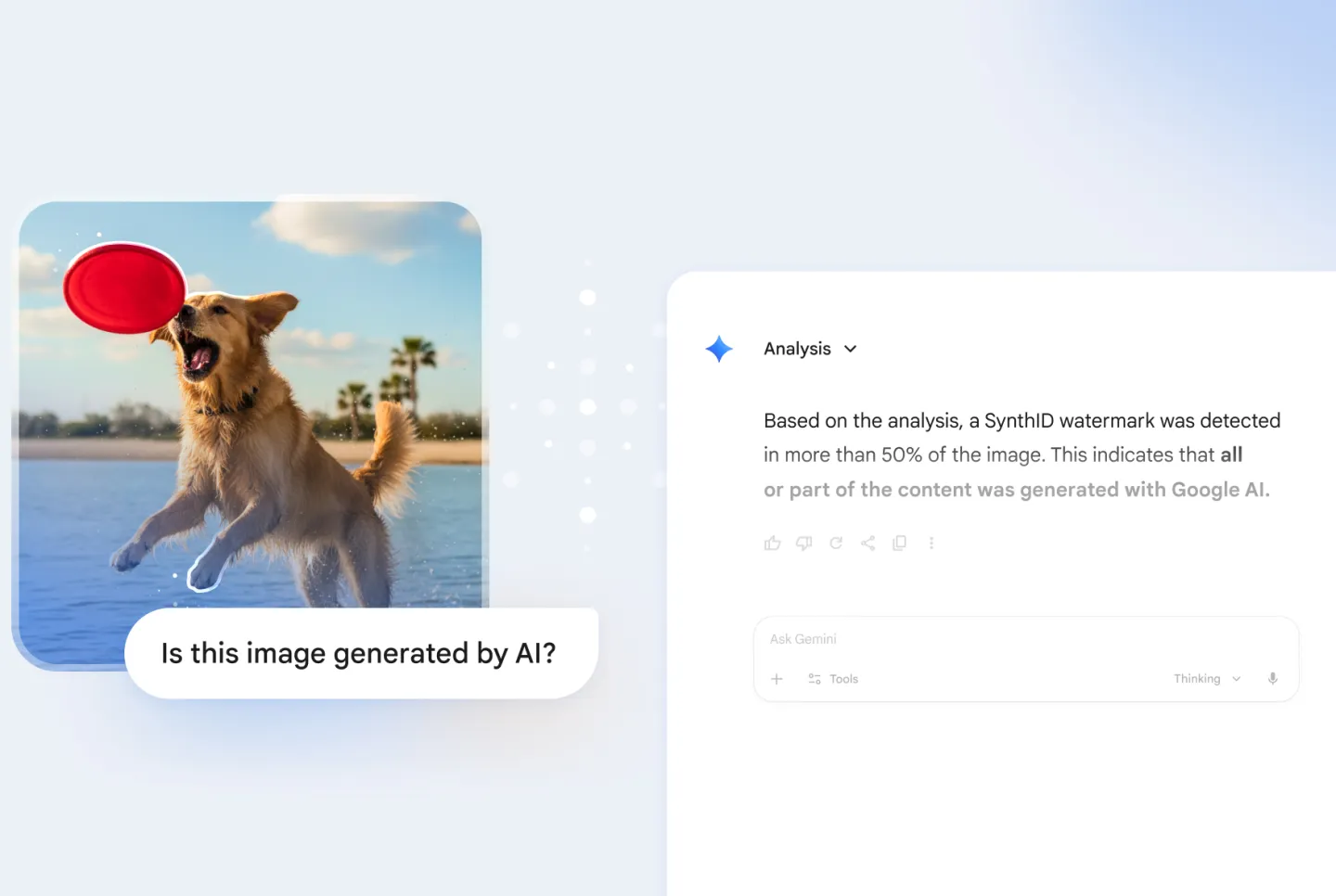

« Is this AI-generated? » : la vérification d’image intégrée à Gemini

Pour l’instant, la vérification repose exclusivement sur SynthID, le watermark invisible développé par Google DeepMind. Il suffit de charger une image dans l’app Gemini et de demander : « Is this AI-generated? ».

Gemini pourra alors confirmer si l’image a été générée par un modèle Google, éditée par un de leurs outils (ex : Nano Banana, Nano Banana Pro, Canvas).

Cette première version ne couvre que les images, mais Google promet que la vidéo et l’audio suivront « bientôt » — un ajout qui s’annonce crucial à l’ère des deepfakes haute fidélité.

L’entreprise prévoit aussi d’intégrer la fonction directement dans Search, permettant à n’importe qui de vérifier l’origine d’un contenu trouvé en ligne.

Vers une traçabilité élargie grâce au standard C2PA

Pour l’instant, la détection repose uniquement sur la technologie maison SynthID. Mais, Google annonce la prochaine étape : une intégration complète du standard C2PA, adopté par un nombre croissant d’acteurs de l’industrie.

Concrètement, cela permettra à Gemini d’identifier des contenus générés par :

- OpenAI (ex. Sora),

- Adobe Firefly,

- TikTok et ses outils IA,

- ainsi que de nombreuses solutions créatives compatibles C2PA.

Autrement dit, un pas vers une interopérabilité réelle dans la lutte contre les faux contenus, bien plus puissante qu’un watermark propriétaire.

À noter : Nano Banana Pro, le nouveau modèle image de Google présenté aujourd’hui, générera systématiquement des images avec métadonnées C2PA intégrées. Une initiative alignée avec TikTok, qui a annoncé cette semaine l’intégration de C2PA dans son propre watermark invisible.

Une avancée utile… mais insuffisante tant que les plateformes ne suivent pas

Cette vérification manuelle est un progrès important : elle donne à l’utilisateur un outil de contrôle immédiat. Mais, elle révèle aussi une faiblesse structurelle : la responsabilité repose encore sur l’utilisateur final, alors que la majorité des plateformes sociales ne détectent pas automatiquement les contenus générés par IA.

Tant que les réseaux sociaux n’intègrent pas eux-mêmes ces systèmes de signalement, la détection restera un acte volontaire — et donc limité dans son efficacité.

La généralisation des métadonnées C2PA est un pas nécessaire, mais c’est l’adoption systémique, côté plateformes, qui déterminera la réussite de cette initiative.

Une étape clé dans la bataille contre la désinformation visuelle

Avec Gemini capable de reconnaître ses propres productions et bientôt celles d’autres outils IA, Google pose les bases d’un écosystème de confiance autour de l’image générative.

Dans un monde où les deepfakes deviennent indiscernables de la réalité, cette transparence — même partielle — n’est plus une option, mais une nécessité.

La vraie question est désormais : l’industrie suivra-t-elle suffisamment vite pour que ces outils fassent une différence à grande échelle ?