Xiaomi ne veut plus seulement être un mastodonte du smartphone, de l’IoT ou de la voiture électrique. Avec MiMo-V2-Pro, le groupe chinois affiche désormais une ambition beaucoup plus large : devenir un acteur crédible de l’IA de fondation, et plus précisément de l’IA agentique, celle qui ne se contente pas de répondre, mais qui agit.

Xiaomi présente son nouveau modèle comme son « flagship foundation model » pour les workloads agentiques réels, tandis que VentureBeat le décrit comme une percée capable de rapprocher Xiaomi des références américaines sur certains usages.

MiMo-V2-Pro : Un modèle géant, mais pensé pour rester efficace

Sur le plan technique, Xiaomi affirme que MiMo-V2-Pro dépasse 1 000 milliards de paramètres au total, avec 42 milliards de paramètres actifs par passe, soit une architecture rare beaucoup plus efficace qu’un modèle dense de taille équivalente.

Le groupe explique aussi que le modèle reprend son mécanisme de Hybrid Attention, avec un ratio porté de 5:1 à 7:1, et qu’il prend en charge jusqu’à 1 million de tokens de contexte. Un module léger de Multi-Token Prediction (MTP) est également intégré pour accélérer la génération.

MiMo-V2-Pro & Omni & TTS is out. Our first full-stack model family built truly for the Agent era.

I call this a quiet ambush — not because we planned it, but because the shift from Chat to Agent paradigm happened so fast, even we barely believed it. Somewhere in between was a…

— Fuli Luo (@_LuoFuli) March 18, 2026

Dit autrement, Xiaomi essaie de résoudre l’un des grands problèmes de l’IA moderne : conserver une bonne qualité de raisonnement sur des contextes très longs sans faire exploser le coût et la latence. C’est exactement le type de compromis qui devient critique dans les systèmes d’agents, où l’on enchaîne planification, appels d’outils, mémoire longue et exécution multi-étapes. Cette lecture est une analyse à partir de l’architecture décrite officiellement par Xiaomi.

Xiaomi ne vend plus seulement un chatbot, mais un « cerveau » pour agents

Le discours de Xiaomi est très clair : MiMo-V2-Pro est conçu pour passer « du chat à l’agent ». L’entreprise explique vouloir faire du modèle le cerveau de systèmes capables d’orchestrer des workflows complexes, de piloter des tâches d’ingénierie de production et de s’intégrer à des scénarios de productivité réels. Xiaomi insiste particulièrement sur son optimisation pour OpenClaw et sur sa capacité à servir de moteur à des frameworks agentiques.

Cette orientation compte beaucoup. Elle montre que Xiaomi ne cherche pas simplement à lancer un LLM de plus pour exister dans les benchmarks. Le groupe veut se positionner sur la couche qui pourrait devenir la plus stratégique dans les prochaines années : celle des modèles capables de faire fonctionner des agents logiciels, pas seulement de tenir une conversation.

Des performances qui commencent à compter hors de Chine

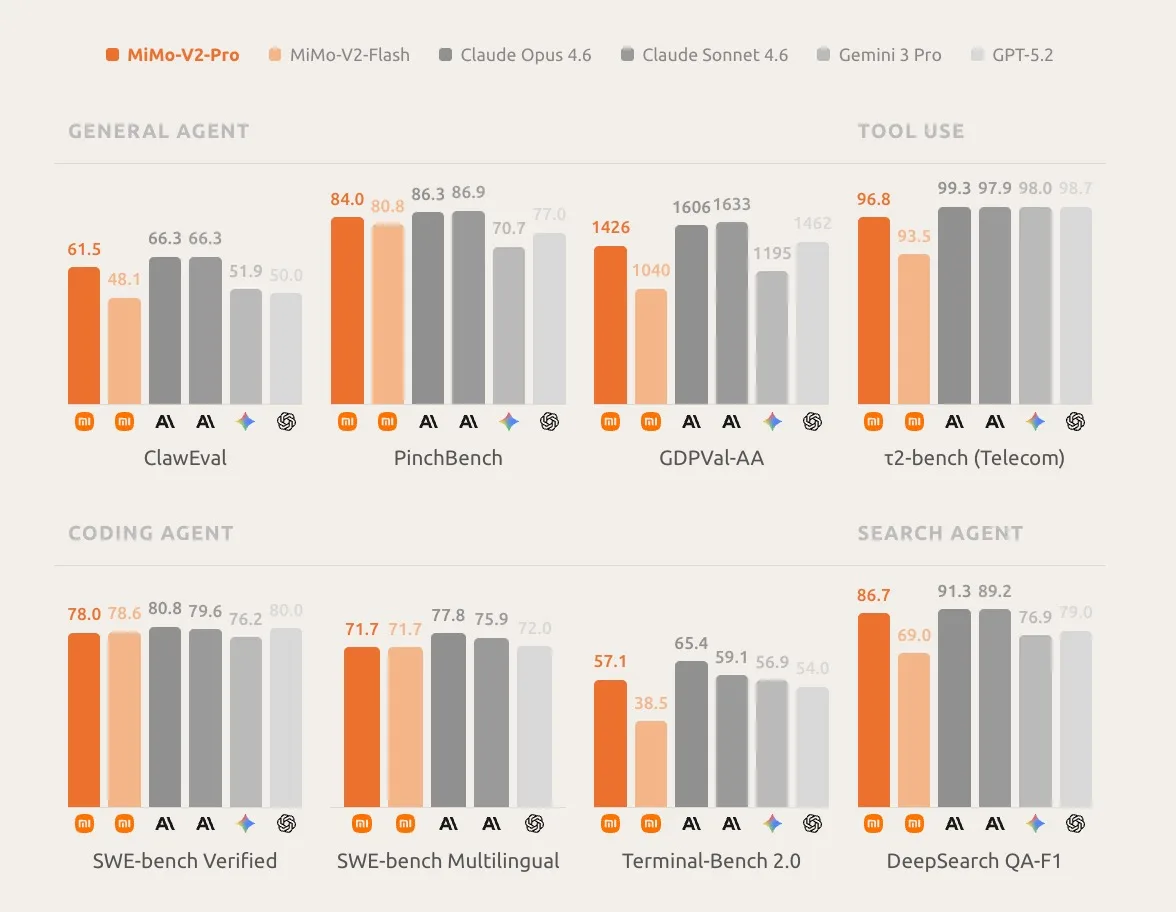

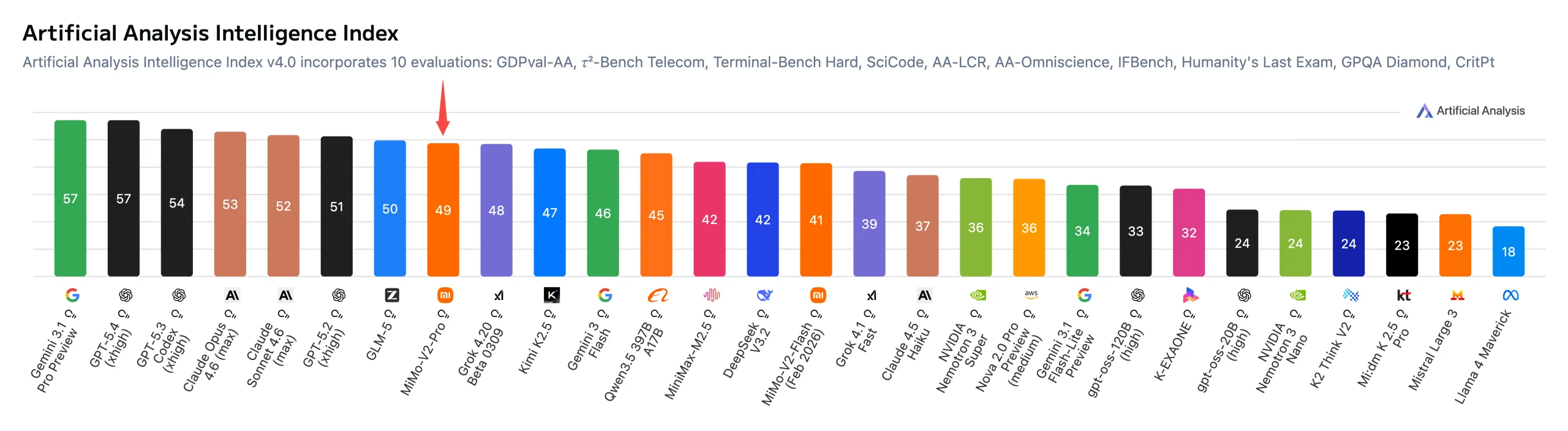

Xiaomi s’appuie sur des résultats internes, mais aussi sur des comparatifs externes. Sur son site, l’entreprise affirme que MiMo-V2-Pro se classe 8e mondial et 2e parmi les LLM chinois selon l’Artificial Analysis Intelligence Index. Xiaomi met aussi en avant un score de 61,5 sur ClawEval, que la société présente comme approchant les performances de Claude Opus 4.6, ainsi qu’un score de 84,0 sur PinchBench.

Artificial Analysis a positionné MiMo-V2-Pro dans le top 10 global de son index, avec un score de 49, au niveau de certains modèles très compétitifs sur le code et au-dessus de Grok 4.20 Beta. Il s’agit là d’une nette amélioration par rapport à MiMo-V2-Flash, notamment sur le taux d’hallucination, la concision de sortie et certains indicateurs de « knowledge quality ».

Il faut évidemment garder une nuance importante : une partie des chiffres de performance mis en avant provient de Xiaomi elle-même. Mais le fait que des référentiels externes comme Artificial Analysis reprennent au moins une partie du positionnement du modèle donne à l’annonce un poids plus sérieux qu’un simple exercice marketing.

Le vrai choc, c’est peut-être le prix

L’autre levier offensif de Xiaomi, c’est la tarification. L’API officielle de MiMo-V2-Pro est proposée à 1 dollar par million de tokens en entrée et 3 dollars par million en sortie jusqu’à 256K de contexte, puis 2 dollars/6 dollars entre 256K et 1M. Xiaomi facture aussi la lecture de cache à 0,20 dollar, puis 0,40 dollar selon le palier, tout en laissant pour l’instant la cache écriture gratuite.

C’est un positionnement extrêmement agressif au regard des modèles premium occidentaux. Xiaomi compare directement ses tarifs à ceux de Claude Sonnet 4.6 et Claude Opus 4.6, et reste très inférieur aux offres les plus chères d’OpenAI et d’Anthropic.

Autrement dit, Xiaomi n’essaie pas seulement d’être bon. Le groupe veut être très bon pour beaucoup moins cher. Et dans le marché actuel de l’IA, ce positionnement peut compter presque autant que la qualité brute du modèle.

Une offre encore incomplète, mais déjà très lisible

Pour l’instant, MiMo-V2-Pro est disponible via l’API first-party de Xiaomi et prend en charge le texte avec très long contexte. En parallèle, Xiaomi met déjà en avant d’autres briques de sa gamme, comme MiMo-V2-Omni pour les usages multimodaux et MiMo-V2-TTS pour la synthèse vocale. Le site MiMo montre donc que Xiaomi ne lance pas un produit isolé, mais bien les premiers éléments d’une famille de modèles pensée pour des cas d’usage différents.

Il manque encore certaines choses pour parler d’une offre totalement mature à l’échelle des leaders mondiaux, notamment une présence omnimodale complète sur le même modèle et un écosystème de distribution plus large. Mais la trajectoire est très claire : Xiaomi construit déjà une pile IA qui va du modèle rapide au modèle agentique premium, en passant par l’omni et la voix.

Xiaomi change de dimension dans l’IA

Au fond, MiMo-V2-Pro raconte quelque chose de plus large que le lancement d’un nouveau modèle. Xiaomi tente de convertir son ADN historique — matériel, IoT, software intégré, systèmes complexes — en avantage sur l’IA de demain. Là où d’autres vendent encore, surtout des assistants conversationnels, Xiaomi pousse déjà un récit centré sur l’action, l’orchestration et les agents.

La vraie question n’est donc plus seulement de savoir si Xiaomi peut faire un bon LLM. Elle est de savoir si le groupe peut transformer MiMo en plateforme d’exécution intelligente, suffisamment crédible pour séduire les développeurs, les outils de code et, à terme, ses propres produits et services. Si cette stratégie fonctionne, Xiaomi ne sera plus seulement un constructeur qui utilise l’IA. Il pourrait devenir l’un de ceux qui la structurent.