Les arnaques en ligne ont changé de texture : moins de spam grossier, plus de conversations crédibles, de faux recruteurs, de « conseillers » crypto, de comptes qui semblent humains — parfois dopés à l’IA. Meta le reconnaît implicitement en lançant une nouvelle salve de protections sur Facebook et Messenger, tout en affichant des résultats industriels (suppression d’annonces frauduleuses, démantèlements de réseaux) et des partenariats plus visibles avec les forces de l’ordre.

Des garde-fous « avant la chute » : le focus bascule vers la prévention

Meta n’essaie plus seulement de nettoyer après coup : l’objectif annoncé est d’interrompre la mécanique de l’escroquerie au moment où elle s’amorce.

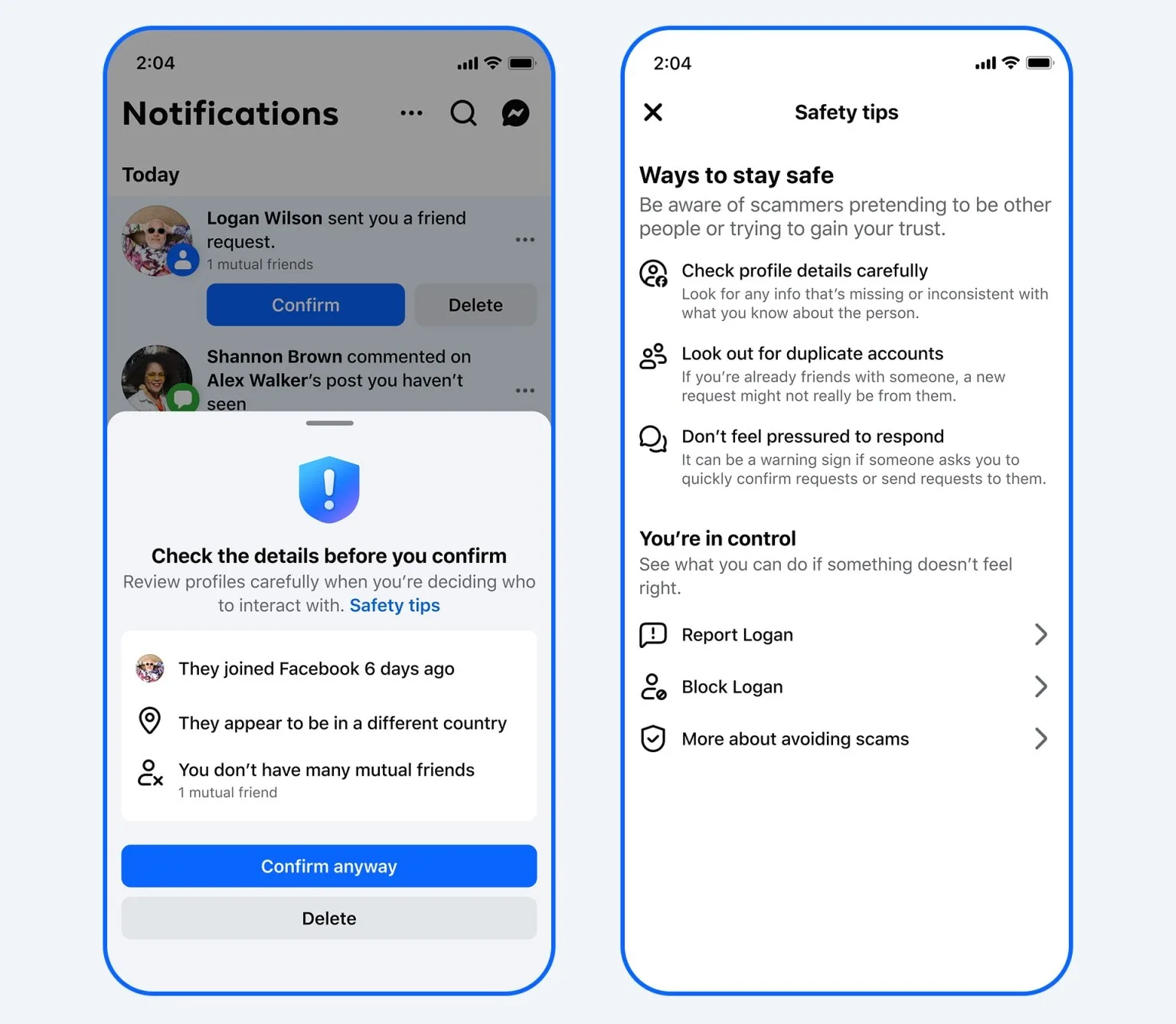

Facebook teste désormais des alertes de demande d’ami suspecte : signaux comme l’absence d’amis en commun, une localisation incohérente, ou d’autres indices comportementaux qui ressemblent aux schémas d’arnaques.

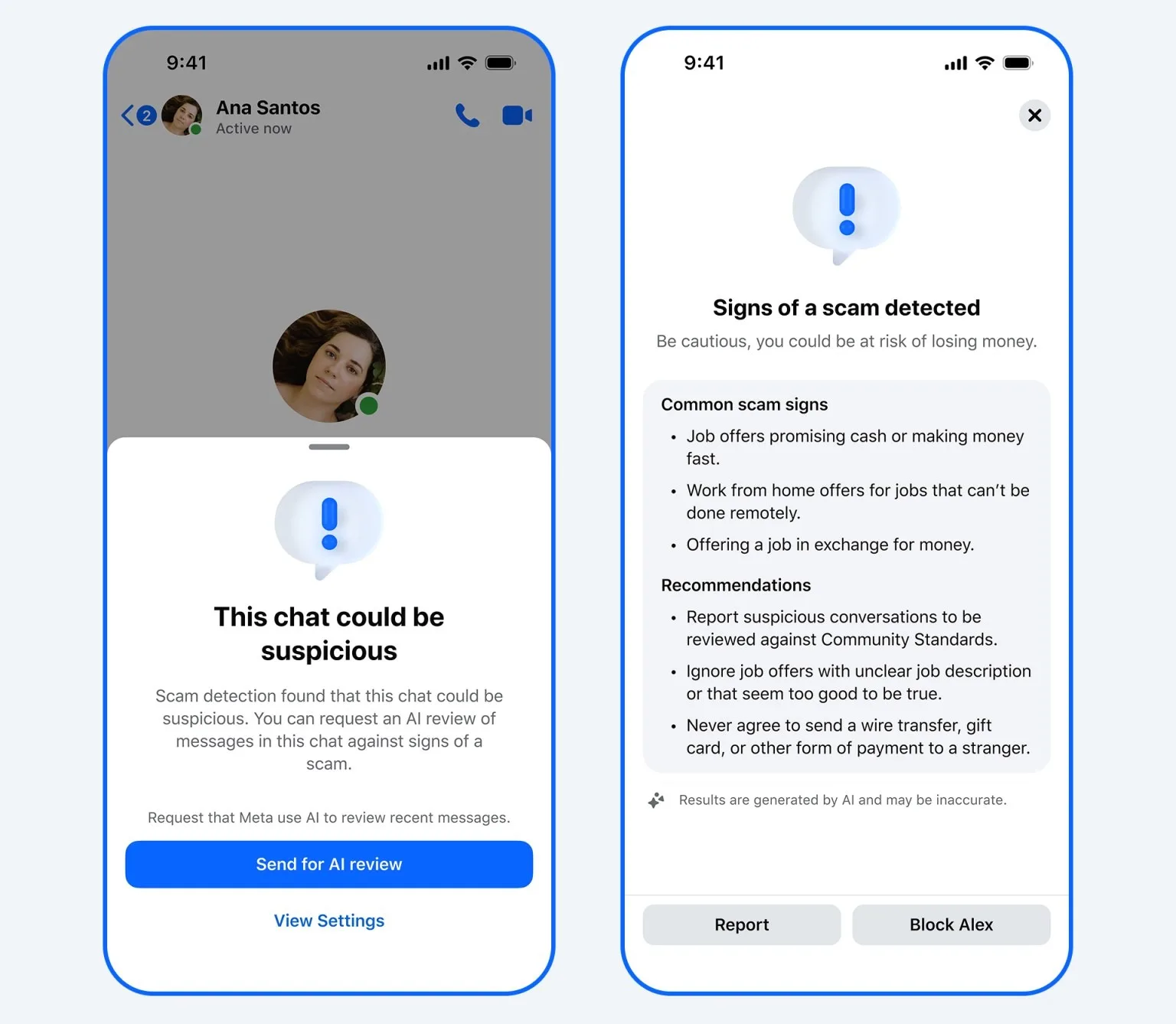

Quant à Messenger, il étend sa détection d’arnaques à davantage de pays et renforce la logique « conversationnelle » : si un échange avec un nouveau contact présente des signes typiques (ex. offres d’emploi non sollicitées), l’app peut proposer une analyse assistée par IA et, en cas de risque, afficher du contexte + actions rapides (bloquer/signaler).

Dans l’ensemble, Meta veut rendre l’arnaque plus onéreuse : plus de friction, plus de signalement, plus de « moments d’hésitation » intégrés dans l’UX. C’est exactement ce qui manque aux utilisateurs : une alerte au bon moment, avant que l’émotion (urgence, peur, promesse) prenne le dessus.

Publicité : Meta promet une vérification plus large des annonceurs

Côté publicitaire, Meta annonce accélérer la vérification d’annonceurs avec un objectif ambitieux : faire en sorte que les annonceurs vérifiés pèsent 90 % du chiffre d’affaires publicitaire d’ici fin 2026, contre 70 % aujourd’hui (selon les chiffres cités dans plusieurs sources).

C’est un point clé, parce que beaucoup d’arnaques « modernes » ne commencent pas par un DM : elles commencent par une pub. Et Meta joue ici sa crédibilité, après des critiques récurrentes sur la présence d’annonces frauduleuses sur ses plateformes (dont des enquêtes très dures sur les incitations économiques et les arbitrages internes).

Frapper « à la source » : 150 000 comptes neutralisés et des arrestations

Meta met aussi en avant une dimension plus offensive : des opérations conjointes visant les scam centers (notamment en Asie du Sud-Est), ces « usines » à fraude qui industrialisent romance scams, investissements bidon et usurpations d’identité.

Selon Meta et des médias qui ont relayé l’opération, l’entreprise a désactivé plus de 150 000 comptes liés à ces réseaux, et l’opération aurait contribué à des arrestations avec l’appui d’autorités (dont la Royal Thai Police).

À côté, Meta communique des chiffres « nettoyage » très élevés sur l’année écoulée : centaines de millions de contenus/annonces supprimés et millions de comptes liés à des centres criminels — une façon de dire : « on ne parle pas d’un problème marginal, mais d’une industrie. »

Des outils utiles… mais une bataille d’UX, d’économie et de confiance

Ces protections peuvent réellement aider, parce qu’elles ciblent l’endroit où l’utilisateur perd : le contexte. Le scam est un scénario, pas un simple message. Mettre une alerte au moment d’accepter un ami ou de poursuivre un DM, c’est casser la narration.

Mais trois points décideront de l’impact réel :

- Le taux de faux positifs : si Messenger « crie au loup » trop souvent, les utilisateurs ignoreront l’avertissement.

- La transparence : Meta parle d’IA et de signaux multiples, mais l’acceptabilité dépendra de la clarté sur ce qui est analysé, comment, et avec quelles garanties.

- L’incitation économique : la pub est le cœur du business, et durcir la vérification peut créer des frictions commerciales. Les révélations et enquêtes passées expliquent pourquoi Meta doit désormais prouver que « sécurité » n’est pas qu’un slogan.

Au fond, Meta tente un rééquilibrage : faire de la plateforme non seulement un lieu de conversation, mais un environnement qui interrompt les conversations quand elles ressemblent trop à une arnaque. C’est une évolution logique à l’ère de l’IA générative — et un aveu discret : le spam d’hier est devenu la persuasion d’aujourd’hui.