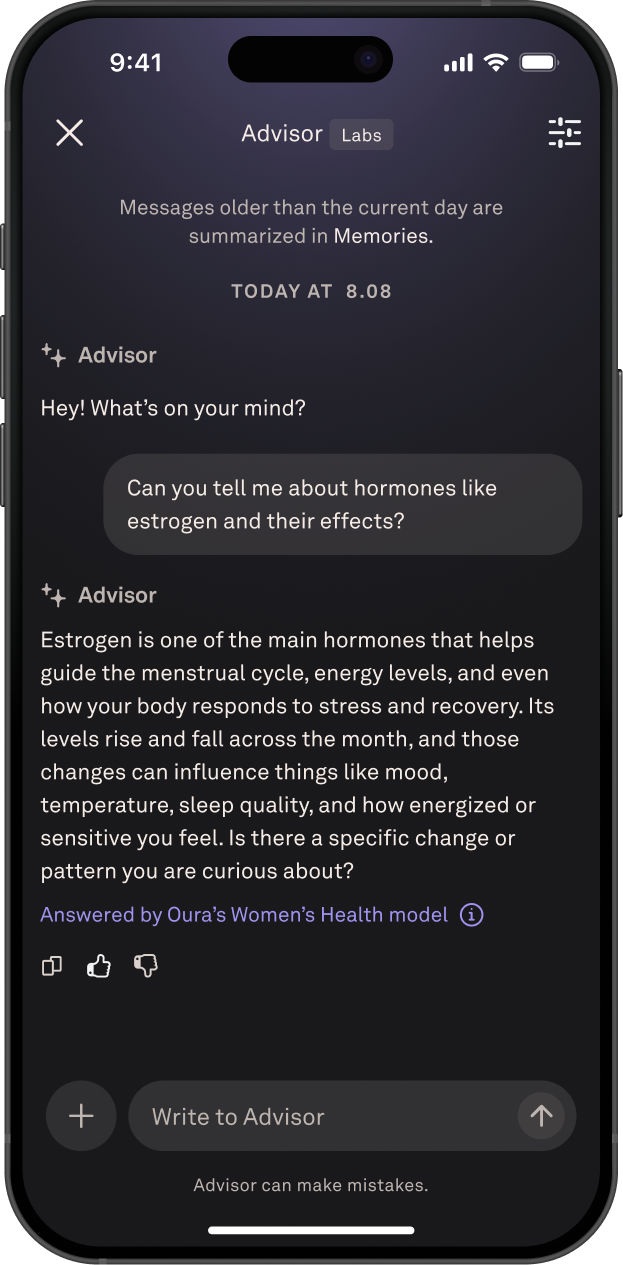

Oura franchit un cap : après avoir lancé Oura Advisor (son coach santé « IA ») en 2024, Oura annonce désormais son propre modèle de langage dédié à la santé des femmes, conçu pour produire des réponses plus cliniquement « ancrées » que celles d’un LLM généraliste.

Un modèle « women-first », testé via Oura Labs

Oura présente ce nouveau modèle comme son premier LLM propriétaire, déployé en test dans Oura Labs et intégré à l’expérience Advisor. Il est censé couvrir « tout le spectre de la santé reproductive », des premiers cycles jusqu’à la ménopause, en s’appuyant sur des standards médicaux et des sources revues par une équipe interne de cliniciens certifiés et d’experts en santé des femmes.

L’argument central n’est pas la magie de l’IA, mais le dataset et la gouvernance :

- Base de connaissances soigneusement sélectionnée : Oura dit entraîner/adapter le modèle sur des standards et recherches médicales validés par ses cliniciens.

- Personnalisation par données longitudinales : la promesse, c’est de croiser la question de l’utilisatrice avec ses tendances de long terme (sommeil, activité, stress, cycle, grossesse, etc.) pour contextualiser les réponses.

- Ton : Oura insiste sur une IA pensée pour éviter le côté expéditif ou minimisant que beaucoup de femmes rapportent dans le parcours de soins.

En filigrane, Oura répond à un problème documenté : les modèles actuels peuvent être très inégaux sur des sujets de santé féminine — certaines évaluations académiques évoquent des taux d’erreurs importants sur des scénarios femmes.

Et la question qui fâche : vos données

Oura affirme que le modèle est hébergé sur son infrastructure contrôlée, et que les données des membres ne sont pas partagées avec d’autres modèles. La société précise aussi qu’une participation à l’amélioration du modèle peut être optionnelle, avec possibilité de ne pas participer/se retirer.

Oura veut être une « IA clinique grand public »… sans se prendre pour un médecin

C’est un mouvement cohérent : Oura a bâti sa réputation sur la mesure continue et la recherche, puis a « monté la couche » conversationnelle. Là, elle fait un pas de plus vers une IA santé spécialisée, avec une promesse implicite : moins de réponses jolies, plus de réponses justifiables.

La clé sera la transparence : quelles sources, quelles limites, et comment le système gère l’incertitude (symptômes, urgences, signaux faibles). Parce qu’en santé — surtout avec des données personnelles aussi sensibles — ce n’est pas la fluidité du texte qui fait la confiance, c’est la capacité à rester précis, prudent, et traçable.