Alors que l’engouement pour les outils d’IA générative ne cesse de croître, Anthropic a annoncé l’instauration de limites d’utilisation hebdomadaires pour Claude, son assistant dopé à l’IA.

La raison ? Une minorité d’utilisateurs exploite le système de manière intensive, parfois même en continu 24h/24, affectant ainsi la stabilité de la plateforme. L’annonce, qui a suscité des réactions mitigées dans la communauté tech, entrera en vigueur à partir du 28 août 2025.

Des usages intensifs qui surchargent Claude Code

Selon Anthropic, le service Claude Code, particulièrement prisé des développeurs, est victime de son succès. Certaines personnes exploiteraient l’IA en arrière-plan de façon continue, tandis que d’autres partageraient ou revendront l’accès à leur compte, contrevenant aux conditions d’utilisation.

Dans un communiqué, la société déclare : « Nous avons conçu nos forfaits pour offrir un accès généreux à Claude. Mais nous observons désormais des violations de nos politiques, comme le partage de comptes ou la revente d’accès, ce qui nuit aux performances globales ».

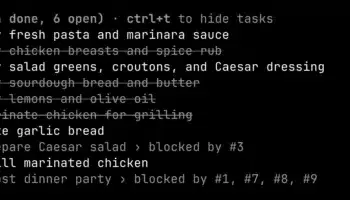

We’re rolling out new weekly rate limits for Claude Pro and Max in late August. We estimate they’ll apply to less than 5% of subscribers based on current usage. pic.twitter.com/X8FAss3jIC

— Anthropic (@AnthropicAI) July 28, 2025

Depuis le lancement de Claude, des limites de 5 heures étaient appliquées par cycle, mais elles seront désormais complétées par un plafond hebdomadaire, en fonction du plan souscrit.

Voici un aperçu des nouvelles limites, selon le plan choisi :

- Plan Pro (20 dollars/mois) : 40 à 80 heures d’accès Claude Code via Sonnet 4 par semaine.

- Max 100 dollars/mois : 140 à 280 heures (Sonnet 4) et 15 à 35 heures avec Opus 4.

- Max 200 dollars/mois : 240 à 480 heures (Sonnet 4) et 24 à 40 heures (Opus 4).

Anthropic précise que ces limites concernent moins de 5 % de ses abonnés, et que l’utilisateur standard ne devrait pas constater de différence.

Pour les utilisateurs dépassant ces plafonds, il sera possible d’acheter du temps d’utilisation supplémentaire aux tarifs standard de l’API.

Réactions négatives dans la communauté

Sans surprise, l’annonce a suscité de vives réactions dans les cercles de développeurs, notamment ceux qui s’appuient sur Claude pour des projets à long terme. Sur les réseaux sociaux, plusieurs voix dénoncent une mesure pénalisant l’ensemble des abonnés pour les abus d’une minorité.

Le manque de transparence sur les modalités exactes de calcul — tokens, durée ou puissance de calcul — laisse également planer des doutes. Certains abonnés pointent que les nouvelles durées ne semblent pas réellement refléter le différentiel annoncé entre les plans (le plan Max est censé offrir 20x plus de capacités que le plan Pro, mais les heures annoncées n’en reflètent que 6x environ).

Un problème global : l’IA consomme énormément de ressources

Anthropic n’est pas le seul acteur à revoir sa stratégie tarifaire face à l’explosion de la demande. En juin, Cursor (Anysphere) a modifié les conditions de son abonnement Pro, avant de présenter ses excuses pour un manque de clarté. Replit a également adapté sa politique tarifaire pour limiter les utilisateurs les plus gourmands.

Les limites imposées sont donc aussi le reflet d’une pénurie persistante de puissance de calcul, un problème généralisé dans le monde de l’IA, alors que les fournisseurs tentent de construire de nouveaux data centers à marche forcée.

Vers des solutions alternatives à long terme

Anthropic a assuré à ses abonnés qu’il travaille à la mise en place de solutions dédiées aux cas d’usage de longue durée, probablement via des forfaits API adaptés ou des offres entreprises. Pour l’instant, ces limites hebdomadaires visent à maintenir une qualité de service constante pour l’ensemble des utilisateurs. Un compromis difficile à faire accepter à certains, mais nécessaire à court terme, selon la société.

L’explosion de la demande pour les outils d’IA, en particulier dans le domaine du code, pousse les fournisseurs à imposer des règles strictes pour éviter les abus et garantir une expérience fluide à tous. Si ces limitations frustrent certains utilisateurs avancés, elles reflètent surtout les tensions croissantes sur les infrastructures d’IA à l’échelle mondiale.

Dans cette course à l’optimisation, la gestion équitable des ressources devient un enjeu crucial pour garantir la viabilité du modèle. Reste à voir si Anthropic saura convaincre ses utilisateurs… ou s’ils migreront vers des alternatives plus flexibles.