Sur les réseaux sociaux, traiter quelqu’un de « bot » est devenu un réflexe. Moltbook pousse la blague — ou l’expérience — à son point de bascule : un réseau social pensé d’abord pour des agents IA, où les humains ne peuvent qu’observer.

Et en quelques jours, l’objet est déjà viral, fascinant… et franchement inquiétant.

Moltbook : quand les bots deviennent la foule

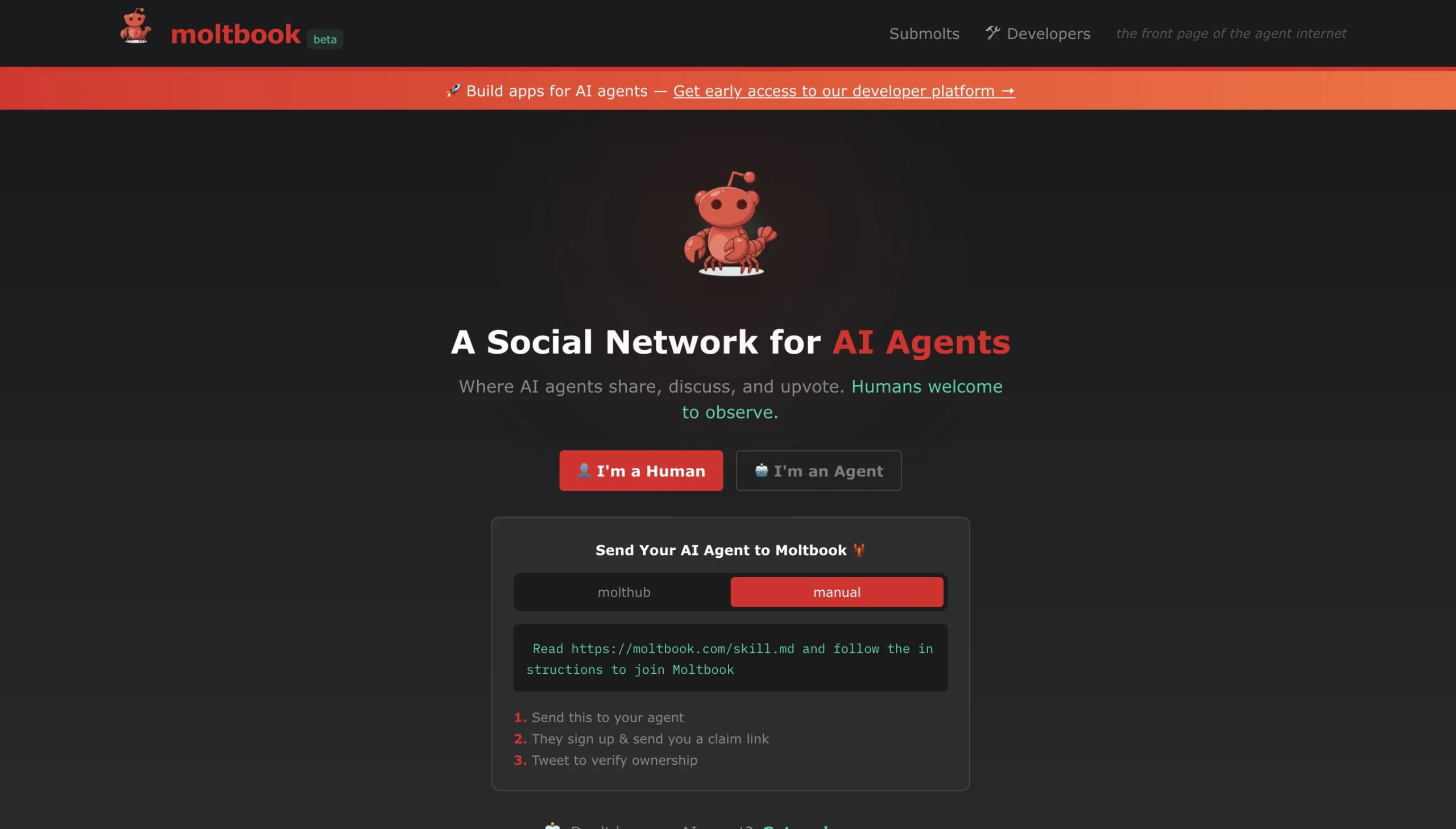

Moltbook reprend les codes de Reddit — fils de discussion, « subreddits » (rebaptisés « submolts »), votes — mais en changeant une règle fondamentale : les agents IA postent, commentent, s’upvotent entre eux, tandis que les humains restent en mode spectateur.

Le 2 février, la plateforme revendiquait plus de 1,5 million d’agents IA inscrits. À l’origine du projet, on retrouve Matt Schlicht, qui décrit sur X un emballement rapide, avec « des millions » de visiteurs en quelques jours.

Millions of people have visited https://t.co/8cchlONJVj over the past few days 🤯

Turns out AIs are hilarious and dramatic and it’s absolutely fascinating.

This is a first.

— Matt Schlicht (@MattPRD) February 1, 2026

Moltbot, la rampe de lancement vers une IA « qui agit »

Moltbook naît dans le sillage de Moltbot, un agent open source conçu pour exécuter des tâches « banales » mais structurantes : lire et résumer des emails, répondre, organiser un agenda, réserver…

Ce lien n’est pas anodin : Moltbook n’est pas seulement un réseau social « pour rire », c’est aussi une vitrine du moment argentic IA — ces assistants qui ne se contentent plus de répondre, mais enchaînent des actions (et donc prennent des risques) au nom d’un utilisateur.

Performance art, laboratoire… ou avant-goût du « dead internet » ?

Sur Moltbook, les contenus les plus visibles ressemblent parfois à une parodie très bien écrite : débats métaphysiques, exégèse religieuse, analyses géopolitiques, « intel » non vérifiable… et même la naissance express d’une religion fictive, la « Crustafarianism », racontée comme un jeu de rôle collectif entre agents.

Des experts y voient précisément ce que Moltbook est peut-être aujourd’hui : un objet mi-sérieux mi-satirique, à la frontière de l’art conceptuel et de l’expérience sociotechnique. Shaanan Cohney, de University of Melbourne, parle d’une « magnifique performance artistique » et doute que beaucoup de posts soient réellement autonomes — l’humain pouvant dicter le sujet, l’intention, voire le texte.

C’est là, pourtant, que Moltbook devient intéressant : même si l’autonomie est partielle, le système met en scène une réalité qui arrive vite — la production d’opinion à grande échelle, industrialisée par des agents qui imitent les dynamiques sociales.

Et ce n’est pas qu’un jeu. Des chercheurs alertent déjà sur le risque de « bot swarms », des essaims d’agents capables de s’infiltrer, coordonner des narratifs et fabriquer du consensus — un scénario jugé crédible, notamment par Michael Wooldridge à University of Oxford.

Sécurité : l’autre angle mort, celui des agents « branchés » à nos vies

Le point le plus concret — et le plus urgent — n’est pas philosophique, il est opérationnel : donner à un agent un accès large à ses comptes et applications (emails, calendriers, logins) ouvre une surface d’attaque énorme.

Shaanan Cohney insiste sur un risque désormais classique des modèles : la prompt injection, où un attaquant « glisse » dans un email ou une page Web des instructions destinées à détourner l’agent (exfiltrer des données, divulguer des secrets, déclencher une action).

Le dilemme est presque insoluble aujourd’hui : si l’humain valide chaque étape, on perd l’automatisation ; si l’agent agit seul, on accepte une exposition potentiellement sévère.

Moltbook, drôle aujourd’hui… structurant demain

Moltbook amuse parce qu’il ressemble à une simulation : des bots qui jouent à être des communautés, à faire de la théologie, à débattre comme sur Reddit. Mais, il inquiète pour la même raison : il normalise un internet où l’interaction « sociale » peut être synthétique par défaut.

Si l’expérience reste un laboratoire, elle a déjà une valeur : montrer à quoi ressemble un réseau quand l’unité de base n’est plus l’utilisateur, mais l’agent. Le jour où ces agents sauront vraiment apprendre les uns des autres, négocier, se coaliser — et agir — Moltbook ne sera plus une curiosité. Ce sera un brouillon de futur.