Google continue de poser les briques de son écosystème Android XR, lancé fin 2024 avec Samsung pour préparer une nouvelle génération de casques et de lunettes connectées.

Dans cette stratégie, la firme vient d’ajouter une pièce particulièrement ambitieuse : Vibe Coding XR, un workflow de prototypage qui permet de transformer une simple description en langage naturel en une expérience WebXR interactive, pensée pour Android XR.

Google présentera officiellement la technologie au salon ACM CHI 2026 en avril, mais la société indique déjà qu’elle est accessible dès maintenant via une démo publique.

Vibe Coding XR : Une idée très simple, mais potentiellement décisive

Le principe est presque déconcertant dans sa simplicité. Google explique que Vibe Coding XR combine Gemini Canvas avec le framework open source XR Blocks pour traduire des prompts utilisateurs en applications WebXR “fully interactive, physics-aware” destinées à Android XR.

Le système peut, selon Google, générer ce type d’expérience en moins de 60 secondes.

Autrement dit, on ne demande plus à l’utilisateur de maîtriser Unity, OpenXR, les pipelines de perception ou les couches basses du spatial computing. On lui demande surtout de savoir exprimer une intention. C’est un glissement important : Google ne cherche pas seulement à fournir de nouveaux outils XR, mais à réduire radicalement la barrière d’entrée créative.

XR Blocks sert de socle, Gemini fait le reste

Google détaille assez clairement la mécanique. Le framework XR Blocks repose sur des technologies web comme WebXR, three.js et LiteRT.js, tandis que Gemini reçoit un contexte spécialisé comprenant des templates, des exemples et des règles de bonnes pratiques pour construire des expériences XR cohérentes. L’idée est de déléguer au modèle la logique spatiale, l’assemblage de scène, les interactions et une partie de la gestion technique.

C’est là que le projet devient intéressant au-delà du simple effet démo. Google ne vend pas seulement une génération automatique de code ; il met en scène une couche d’abstraction qui tente de faire pour la XR ce que les outils de vibe coding ont déjà commencé à faire pour le web et certaines apps 2D ou 3D.

Oui, on peut tester sans casque

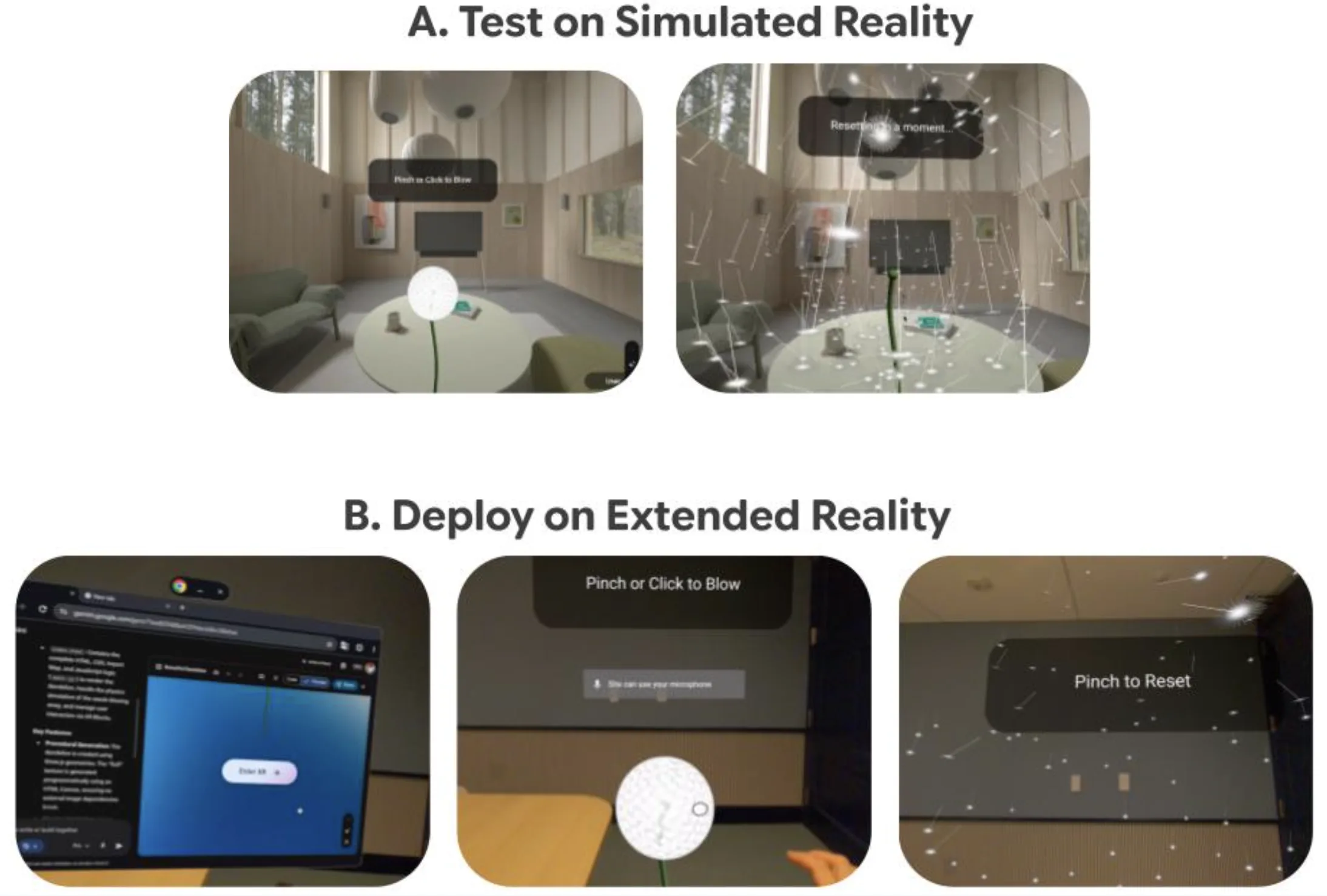

L’un des détails les plus malins du projet tient justement à son accessibilité. Google précise qu’un utilisateur peut lancer XR Blocks Gem dans Chrome sur desktop et prévisualiser son application dans un environnement de “réalité simulée”. Le même workflow peut ensuite être utilisé sur un casque Android XR, comme le Galaxy XR / Project Moohan de Samsung, avec saisie clavier, voix et interactions manuelles.

Cela ne remplace évidemment pas un vrai test en conditions immersives. Google le dit d’ailleurs en creux : certaines fonctions avancées, comme la profondeur, les interactions de mains ou la physique, s’apprécient beaucoup mieux directement sur un appareil Android XR. Mais pour itérer vite, cette simulation desktop change la donne.

Les usages visés restent simples, mais déjà révélateurs

Dans sa démonstration officielle, Google montre par exemple la création d’un pissenlit interactif, mais aussi des prototypes plus pédagogiques ou ludiques comme un math tutor en 3D ou un jeu XR avec dinosaure. La société insiste sur le fait que le système peut aider autant à tester des interfaces, des visualisations spatiales et des expériences éducatives qu’à accélérer l’exploration d’idées qui seraient autrement trop longues à développer à la main.

Il faut toutefois garder les pieds sur terre. Google parle bien d’un prototyping rapide, pas d’un pipeline magique capable de produire demain un équivalent de Half-Life: Alyx. À ce stade, la valeur du projet tient surtout dans la capacité à matérialiser vite une idée XR suffisamment crédible pour la tester.

Android XR reste le grand horizon du projet

Ce lancement a d’autant plus de sens qu’il s’inscrit dans la construction plus large d’Android XR, que Google a présenté comme une plateforme unifiée pour casques et lunettes, créée en collaboration avec Samsung. Google a confirmé dès 2024 que le premier appareil Android XR serait un casque Samsung, Project Moohan, avant d’élargir ensuite l’ambition à d’autres formes de wearables.

En clair, Vibe Coding XR n’est pas une curiosité isolée. C’est un accélérateur d’écosystème. Google sait que pour faire exister Android XR face aux ambitions d’Apple et des autres acteurs du spatial computing, il ne suffit pas de sortir du hardware : il faut rendre la création de contenus et d’expériences beaucoup plus rapide et plus accessible.

Google essaie de faire à la XR ce que l’IA a déjà commencé à faire au software

Le point le plus fort de Vibe Coding XR, ce n’est peut-être pas la technologie elle-même, mais la vision qu’elle traduit. Pendant des années, la XR a souffert d’un problème très concret : même quand le hardware progressait, créer quelque chose d’intéressant restait long, technique et coûteux. En donnant à Gemini le rôle de designer et d’ingénieur XR d’appoint, Google tente de faire sauter ce verrou.

En somme, Vibe Coding XR ne promet pas encore de démocratiser instantanément la réalité étendue. Mais il propose quelque chose de potentiellement plus important : raccourcir violemment la distance entre une idée spatiale et son premier prototype. Et pour une plateforme comme Android XR, c’est peut-être exactement le genre d’outil qui peut transformer une promesse technologique en terrain de jeu créatif.