C’était une intuition de parent, un soupçon de prof, un réflexe de couloir. Pew Research Center vient de le quantifier : aux États-Unis, plus d’un ado sur deux (54 %) dit avoir utilisé des chatbots type ChatGPT ou Copilot pour le travail scolaire.

Les données ont été collectées à l’automne 2025 auprès de 1 458 adolescents (13–17 ans) et leurs parents — l’un des clichés les plus nets à ce jour de la place de l’IA dans la vie étudiante.

L’IA est courante… mais pas universelle, ni « tout le temps »

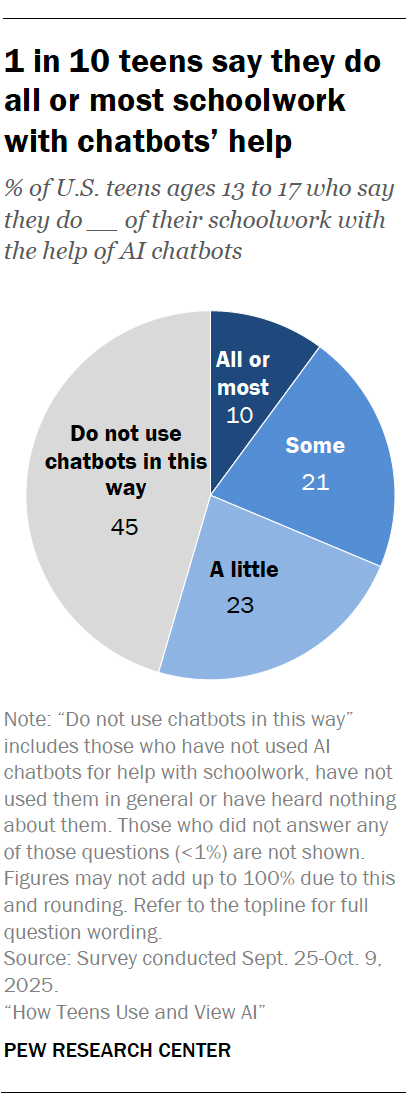

Le chiffre de 54 % ne raconte pas une génération entière « assistée » en permanence. Pew montre un usage en strates :

- 10 % des ados disent faire « tout ou la plupart » de leur travail avec l’aide de chatbots.

- 21 % les utilisent pour une partie de leurs devoirs.

- 23 % seulement un peu.

- 45 % n’y ont pas recours pour l’école.

Autrement dit, l’IA est bien entrée dans la salle de classe, mais elle ressemble davantage à une calculatrice intellectuelle ponctuelle qu’à une machine à « rendre des copies ».

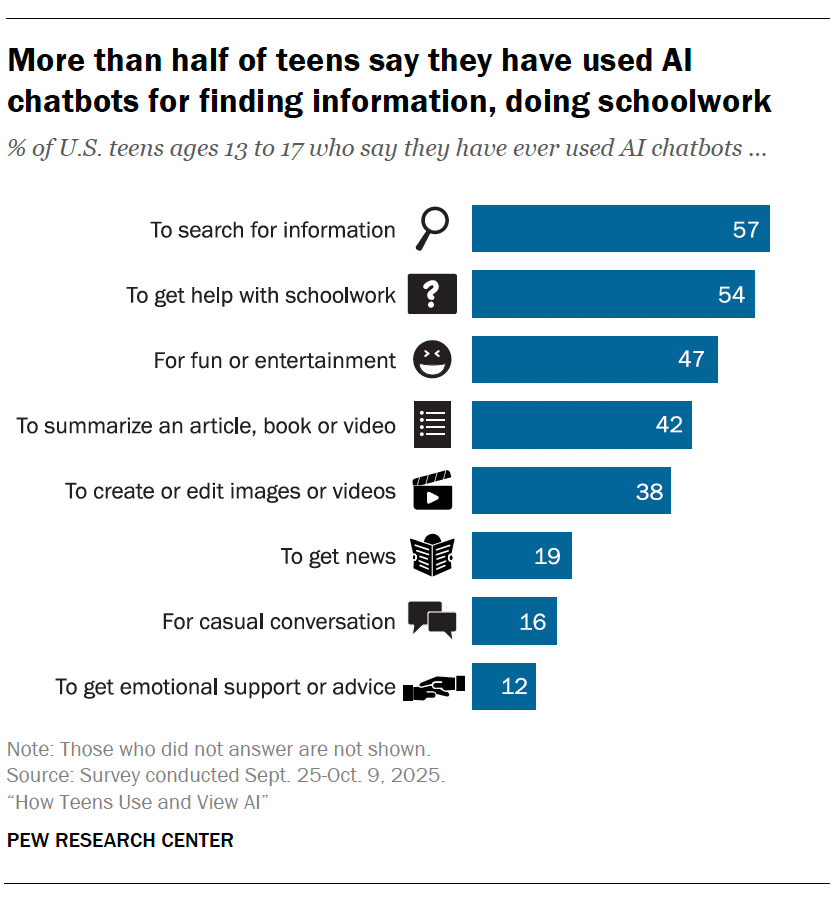

À quoi sert l’IA, concrètement ? Tutorats express, plus que l’écriture fantôme

Les usages dominants sont très « fonctionnels » :

- 48 % s’en servent pour rechercher un sujet

- 43 % pour résoudre un problème de maths

- 35 % pour relire/éditer un texte

Ce trio est important : il dessine une IA utilisée comme tuteur, assistant de compréhension et outil d’édition, plutôt que comme auteur fantôme systématique.

« Ça aide vraiment » : la satisfaction est forte

Quand Pew demande si les chatbots sont utiles pour l’école, la réponse est largement positive :

- 26 % des ados jugent l’IA très ou extrêmement utile

- 25 % la trouvent plutôt utile

- 3 % disent que ça n’aide pas (ou presque pas)

Ce n’est pas un détail : une technologie qui « marche » pour l’utilisateur s’installe vite — et pousse les établissements à clarifier, qu’ils le veuillent ou non.

Le nœud : la triche est perçue comme fréquente… et la norme sociale pèse

L’autre moitié du récit, c’est l’intégrité scolaire. Pew relève que :

- 59 % des ados estiment que la triche via IA arrive au moins « assez souvent » dans leur établissement

- Dont 34 % qui disent très/extrêmement souvent

- 14 % pensent que ça arrive rarement/jamais

- 15 % ne savent pas

Le point le plus révélateur : chez ceux qui utilisent déjà des chatbots pour l’école, 76 % disent que la triche est au moins parfois une réalité.

Cette perception agit comme un accélérateur : si « tout le monde le fait », la pression pour suivre augmente — même chez les élèves qui n’auraient pas franchi la ligne seuls.

Parents : un décalage de visibilité, donc de discussion

Pew mesure aussi une fracture tranquille : 64 % des ados disent utiliser des chatbots, alors que 51 % seulement des parents pensent que leur enfant en utilise.

Et côté compétence, l’outil est omniprésent, mais pas forcément maîtrisé : environ un quart des ados se disent très confiants dans leur capacité à utiliser ces chatbots.

C’est une fenêtre de tir idéale : l’enjeu n’est pas seulement de « surveiller », mais d’enseigner comment s’en servir sans désapprendre.

Analyse : ce que écoles et familles doivent regarder maintenant

Ce que Pew décrit, c’est le basculement d’une question morale (« triche ou pas triche ? ») vers une question de design pédagogique :

- Clarifier les règles : ce qui est autorisé (brainstorm, explication, correction), ce qui ne l’est pas (rédaction intégrale, réponses « prêtes à rendre »), et surtout comment citer l’aide de l’IA.

- Déplacer l’évaluation : davantage d’écrits en classe, d’oraux, de « process » (brouillons, étapes, justification), pour valoriser la démarche plutôt que le rendu.

- Former à l’IA : apprendre à vérifier, à demander des sources, à repérer les erreurs — sinon on obtient des copies « fluides », mais fragiles.

- Parler plutôt que punir par réflexe : avec une adoption déjà massive, la conversation est souvent plus efficace que la police.

L’IA n’a pas « tué » les devoirs : elle a changé la définition du travail scolaire — et la frontière entre aide et triche devient, de fait, un sujet d’éducation.