DeepSeek est l’IA open source chinoise qui a secoué le monde de l’intelligence artificielle en janvier 2025. En proposant un modèle rivalisant avec GPT-4o et Claude, mais entraîné pour une fraction du coût, DeepSeek a forcé toute la Silicon Valley à revoir ses hypothèses.

En 2026, la famille DeepSeek continue de s’imposer comme la référence de l’IA open source mondiale.

Qu’est-ce que DeepSeek ?

DeepSeek (深度求索) est une entreprise d’IA chinoise fondée en 2023, basée à Hangzhou. Sa mission : progresser vers l’AGI via une recherche ouverte. Contrairement à OpenAI ou Anthropic, DeepSeek publie ses poids de modèles publiquement sur Hugging Face, permettant à quiconque de les télécharger, modifier et déployer librement.

Le grand choc est survenu en janvier 2025 : DeepSeek a publié son modèle de raisonnement R1, capable de rivaliser avec o1 d’OpenAI sur les benchmarks de mathématiques et de codage, mais entraîné pour environ 6 millions de dollars au lieu des 100 millions ou plus que dépensent les grands laboratoires. Une véritable révolution économique pour l’industrie.

Les modèles DeepSeek en 2026

DeepSeek V3 — le modèle phare

Sorti en décembre 2024 et mis à jour en V3.2 début 2026, DeepSeek V3 est le modèle généraliste de référence. C’est un modèle MoE (Mixture of Experts) de 671 milliards de paramètres au total, avec seulement 37 milliards activés par token — ce qui garantit une efficacité remarquable à l’inférence.

Ses caractéristiques techniques :

- 671B paramètres (37B activés par token via architecture MoE)

- 128K tokens de fenêtre de contexte

- Entraîné sur 14,8 trillions de tokens

- Architecture Multi-head Latent Attention (MLA) + DeepSeekMoE

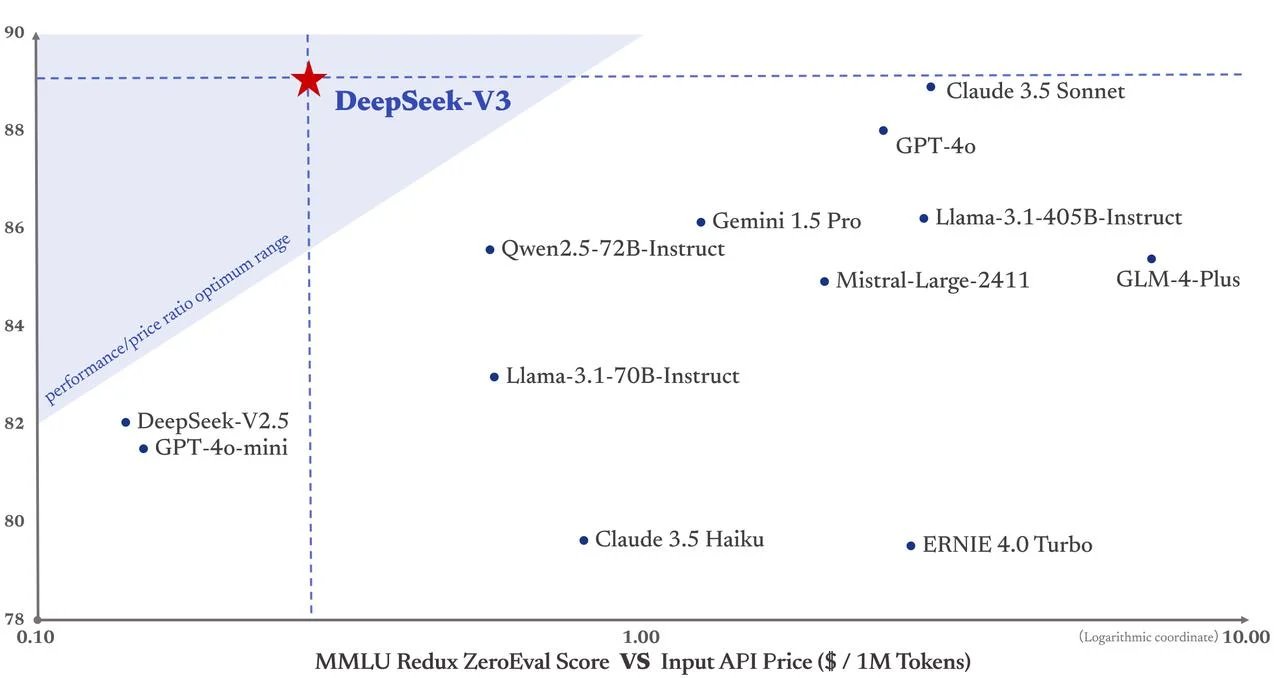

- Performances comparables à GPT-4o et Claude 3,5 Sonnet sur la plupart des benchmarks

DeepSeek R1 — le modèle de raisonnement

Lancé en janvier 2025, DeepSeek R1 est un modèle axé sur le raisonnement, entraîné via apprentissage par renforcement à grande échelle sur la base V3. Il rivalise avec o1 d’OpenAI sur les tâches de mathématiques, code et raisonnement complexe.

Des versions distillées (7B, 14B, 32B, 70B paramètres) permettent une utilisation locale sur matériel grand public via Ollama ou vLLM.

DeepSeek V4 — la prochaine génération (attendue)

DeepSeek V4 est l’un des modèles open source les plus attendus de 2026. Plusieurs fenêtres de lancement ont été annoncées sans confirmation officielle. Au 23 mars 2026, DeepSeek V4 n’a pas encore été lancé publiquement, malgré des signaux forts comme un accès précoce donné aux fabricants de puces domestiques chinois.

Ce que l’on sait sur V4 :

- ~1 trillion de paramètres au total (37B activés par token)

- Fenêtre de contexte d’1 million de tokens

- Architecture Engram MoE avec mémoire conditionnelle

- Multimodal natif (texte, image, vidéo)

- Optimisé pour les puces Huawei Ascend et Cambricon

- Licence Apache 2.0 (open source commercial)

Tarifs et accès en 2026

DeepSeek propose plusieurs modes d’accès :

- Interface web gratuite : chat.deepseek.com, accès direct à V3 et R1 sans abonnement.

- API : à partir de 0,028 $ par million de tokens en entrée — soit environ 10 à 30 fois moins cher que les API d’OpenAI ou Anthropic.

- Auto-hébergement : téléchargement gratuit des poids sur Hugging Face. Le modèle complet (685 Go) nécessite une infrastructure serveur, mais les versions distillées tournent sur du matériel grand public.

Pourquoi DeepSeek a changé la donne ?

L’impact de DeepSeek dépasse la simple performance technique. En janvier 2025, l’annonce de R1 a provoqué une chute boursière de 600 milliards de dollars pour Nvidia en une seule journée — la preuve que le marché avait compris les implications économiques d’une IA frontier accessible à 6 millions d’euros d’entraînement.

Les avantages clés qui expliquent l’adoption rapide :

- Coût d’inférence ultra-bas : l’architecture MoE active seulement une fraction des paramètres par token.

- Open source MIT/Apache : utilisation commerciale libre, modification autorisée.

- Déploiement local : les versions distillées permettent d’héberger l’IA sur ses propres serveurs.

- Performances de pointe : rivalise frontalement avec GPT-4o et Claude sur les benchmarks de code et mathématiques.

Limites et points de vigilance

DeepSeek n’est pas sans inconvénients, et il est important de les connaître avant d’adopter ces modèles :

- Données en Chine : lors de l’utilisation de l’interface web ou de l’API officielle, les données transitent par des serveurs en Chine. Plusieurs gouvernements et administrations ont banni DeepSeek de leurs appareils officiels pour cette raison.

- Disponibilité variable : l’API publique peut retourner des erreurs « server busy » aux heures de pointe.

- Garde-fous moins stricts : DeepSeek applique des restrictions de contenu différentes des modèles occidentaux, ce qui peut poser des questions éthiques.

- Inférence locale complexe : le modèle complet (685 Go) nécessite une infrastructure conséquente. Les versions distillées restent la solution pratique pour l’auto-hébergement.

Recommandation : pour les usages non sensibles et le développement, DeepSeek est un excellent choix. Pour les données confidentielles ou professionnelles sensibles, privilégiez un hébergement local ou les API d’OpenAI/Anthropic avec traitement en Europe.

DeepSeek face à ses concurrents

- ChatGPT/GPT-5 (OpenAI) : référence grand public, meilleur écosystème et support enterprise, mais 10 à 30 fois plus cher sur l’API.

- Claude 3,7 Sonnet (Anthropic) : supérieur pour l’écriture nuancée et les garde-fous de sécurité, traitement des données en Europe possible.

- Gemini 3 (Google) : meilleure intégration dans l’écosystème Google, mais modèle propriétaire.

- Llama 4 (Meta) : autre modèle open source majeur, architecture MoE, sous licence permissive.

Comment utiliser DeepSeek ?

- Rendez-vous sur chat.deepseek.com pour un accès direct gratuit.

- Créez un compte avec votre adresse e-mail.

- Choisissez entre le mode « Chat » (DeepSeek V3) et le mode « Think » (DeepSeek R1 pour le raisonnement).

- Pour l’API, créez un compte développeur sur platform.deepseek.com.

- Pour l’auto-hébergement, téléchargez les poids sur Hugging Face via

deepseek-ai/DeepSeek-V3.

Conclusion : DeepSeek, la démocratisation de l’IA frontier

En 2026, DeepSeek s’est imposé comme le symbole de la démocratisation de l’IA. En prouvant qu’un modèle frontier peut être entraîné pour quelques millions d’euros et distribué en open source, DeepSeek a forcé l’ensemble de l’industrie à revoir ses modèles économiques.

Pour les développeurs, chercheurs et entreprises non soumises à des contraintes de confidentialité strictes, DeepSeek V3 et R1 représentent aujourd’hui les meilleurs rapports performances/coût du marché. L’arrivée imminente de V4 promet de franchir une nouvelle étape dans cette révolution open source.