Google ne se contente plus de suivre la course à l’IA — il redéfinit ses règles économiques. Avec la disponibilité générale de Ironwood TPU, dévoilée lors de Google Cloud Next, la firme introduit une puce pensée avant tout pour l’inférence.

Une inflexion stratégique majeure, à l’heure où le coût réel de l’IA ne se joue plus à l’entraînement… mais dans son exécution à grande échelle.

Ironwood : une démonstration de force technique et industrielle

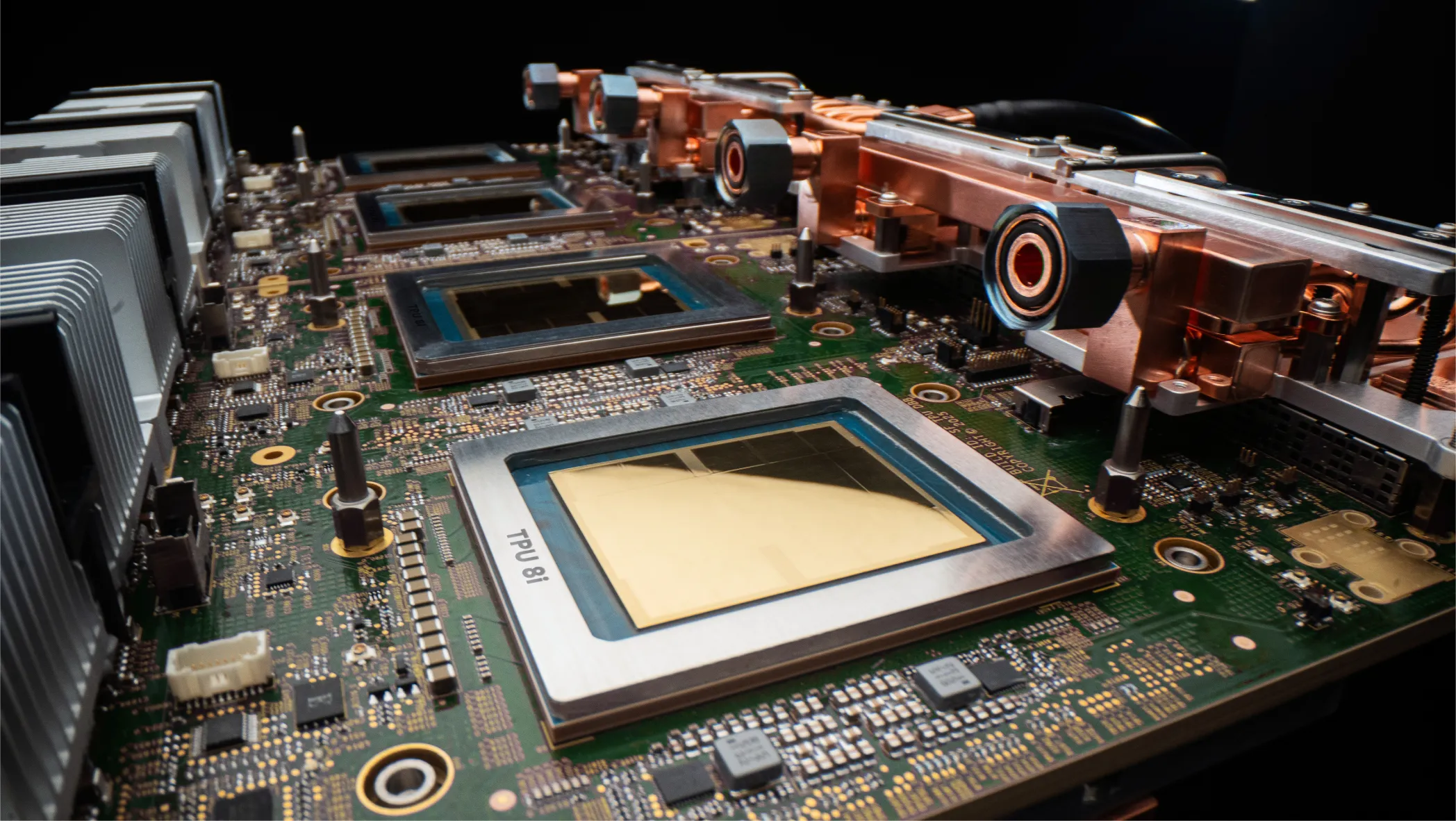

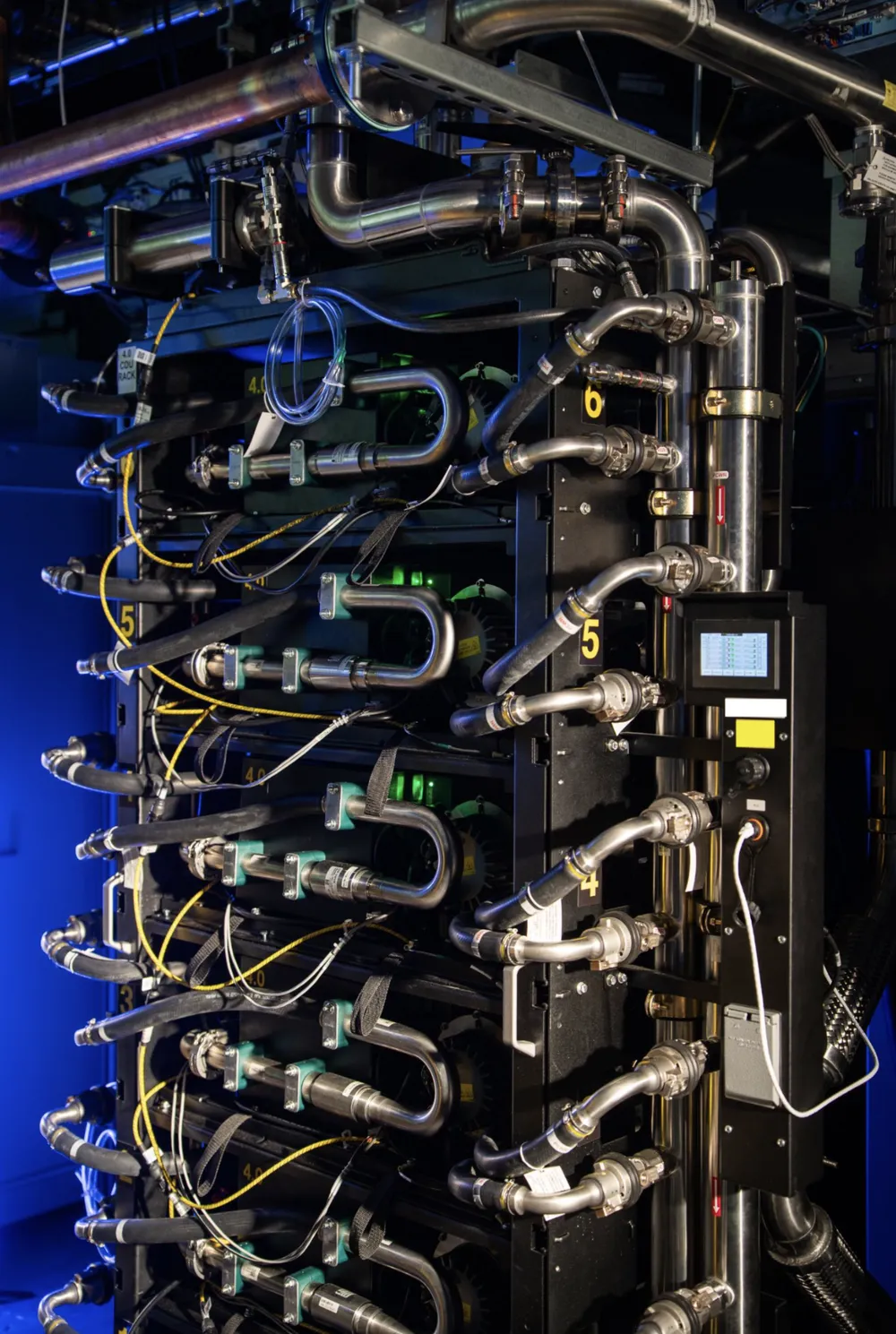

Sur le papier, Ironwood impressionne. Chaque puce atteint 4,6 pétaFLOPS en FP8, accompagnée de 192 Go de mémoire HBM3e et d’une bande passante de 7,37 To/s. Mais, c’est à l’échelle du système que Google frappe fort : un superpod de 9 216 TPU délivre jusqu’à 42,5 exaFLOPS, soit une puissance supérieure à celle du supercalculateur El Capitan supercomputer.

Face à lui, le Nvidia Blackwell B200 affiche des performances comparables en calcul brut, avec un avantage côté interconnexion (NVLink) et la prise en charge du FP4. Mais Google joue une autre carte : l’optimisation à l’échelle du cluster et une efficacité énergétique nettement améliorée.

Pourquoi Google mise tout sur l’inférence ?

Le choix de privilégier l’inférence n’est pas anodin. L’entraînement d’un modèle reste un coût ponctuel. L’inférence, elle, est une dépense continue, exponentielle et structurelle. Google doit désormais alimenter en temps réel des services comme Gemini, Google Search, YouTube ou encore Gmail.

À ce rythme, la capacité d’inférence doit doubler tous les six mois. Dans ce contexte, celui qui maîtrise le coût par requête capte la marge. Et c’est précisément là que Google veut s’imposer : non pas en battant Nvidia sur tous les fronts, mais en construisant le matériel le plus rentable pour ses propres usages.

Ironwood est ainsi optimisé pour les charges dominantes : modèles de langage, architectures Mixture-of-Experts, modèles de diffusion et apprentissage par renforcement.

Sa mémoire élevée permet de réduire la fragmentation des modèles, limitant les échanges entre puces — un facteur clé pour la latence et le coût.

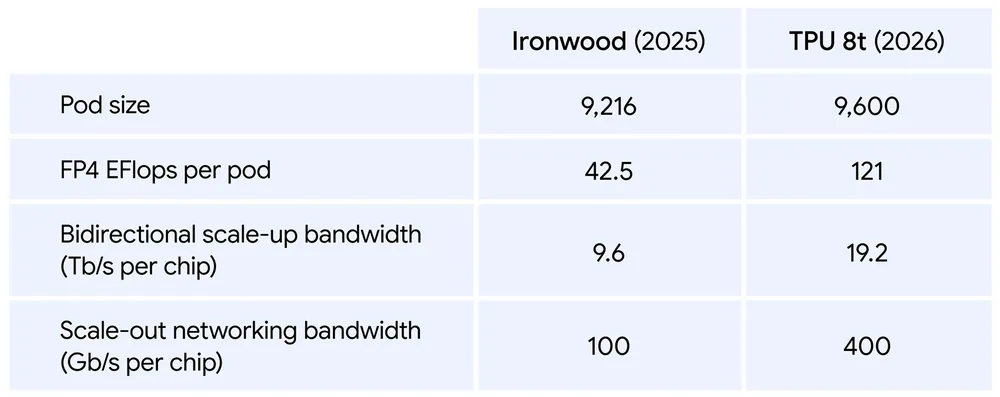

TPU 8 : Google abandonne le modèle unique

L’annonce la plus structurante est peut-être ailleurs. Google prépare déjà la suite avec une 8e génération de TPU, scindée pour la première fois en deux architectures distinctes :

- TPU 8t (Sunfish) : dédié à l’entraînement, co-développé avec Broadcom

- TPU 8i (Zebrafish) : optimisé pour l’inférence, conçu avec MediaTek

Gravées en 2 nm chez TSMC, ces puces arriveront à horizon 2027.

C’est un tournant majeur. Jusqu’ici, chaque TPU devait concilier entraînement et inférence — un compromis technique permanent. Google acte désormais une réalité du marché : les deux usages sont fondamentalement incompatibles en termes d’optimisation.

Une stratégie industrielle tentaculaire

Ironwood n’est que la partie visible d’un plan bien plus vaste. Google construit une chaîne d’approvisionnement multi-partenaires : Broadcom pour les puces hautes performances, MediaTek pour les variantes optimisées coût, discussions avec Marvell Technology, et collaboration avec Intel. Le tout soutenu par un investissement colossal : jusqu’à 185 milliards de dollars en 2026.

Et surtout, un client clé : Anthropic, qui pourrait exploiter jusqu’à un million de TPU et plusieurs gigawatts de capacité.

La guerre de l’IA devient une guerre de marges

Ce que révèle Ironwood dépasse largement la fiche technique. Le marché bascule : les GPU dominaient l’entraînement, l’inférence devient le vrai centre de coûts et les hyperscalers construisent leurs propres puces. Résultat : un déplacement de valeur massif. Les analystes estiment que les ASICs pourraient représenter 45 % du marché IA d’ici 2028, avec une érosion potentielle de la domination de Nvidia sur l’inférence.

Mais, Nvidia conserve un avantage décisif : son écosystème logiciel, notamment CUDA. Comme l’a résumé Jensen Huang : « Construire quelque chose de mieux n’est pas si simple. »

Google ne cherche pas forcément à faire « mieux » en absolu. Il cherche à faire moins cher, à grande échelle, pour ses propres besoins.

Vers une IA industrielle, optimisée comme un réseau électrique

Ironwood incarne une transition silencieuse mais fondamentale : l’IA devient une infrastructure, comparable à l’énergie ou aux télécoms. Dans ce modèle, la performance brute compte moins que le coût par requête, l’efficacité énergétique et la scalabilité.

Google parie désormais sur une évidence stratégique : la valeur ne sera plus captée par celui qui fournit les puces… mais par celui qui les conçoit pour son propre usage.

Et avec deux architectures TPU en préparation, la firme acte définitivement la fin d’un modèle unique. L’ère de l’IA généraliste laisse place à une ingénierie spécialisée, segmentée et industrialisée.