L’ivresse de l’IA conversationnelle semble commencer à retomber. Après la phase de fascination, marquée par l’expérimentation tous azimuts et la curiosité quasi réflexe autour de ChatGPT, Gemini et consorts, une autre dynamique apparaît : celle d’un public plus prudent, plus lucide, et surtout plus attentif à ce qu’il livre à ces outils.

Un nouveau rapport de Malwarebytes affirme ainsi que la défiance autour de l’usage des données personnelles par l’IA ne relève plus du simple malaise diffus, mais d’un comportement concret.

Une adoption toujours réelle, mais une confiance qui recule nettement

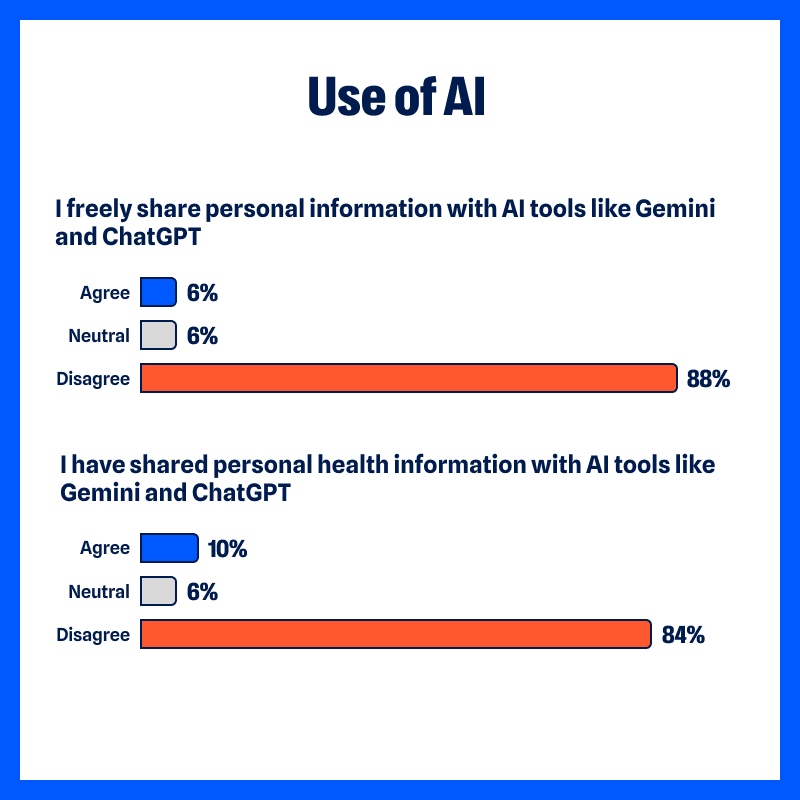

Selon l’enquête publiée, 90 % des personnes interrogées se disent inquiètes à l’idée que l’IA utilise leurs données sans consentement, tandis que 88 % affirment ne pas partager librement leurs informations personnelles avec des outils comme ChatGPT ou Gemini.

Plus révélateur encore, 84 % déclarent ne pas avoir transmis de données de santé à ces assistants.

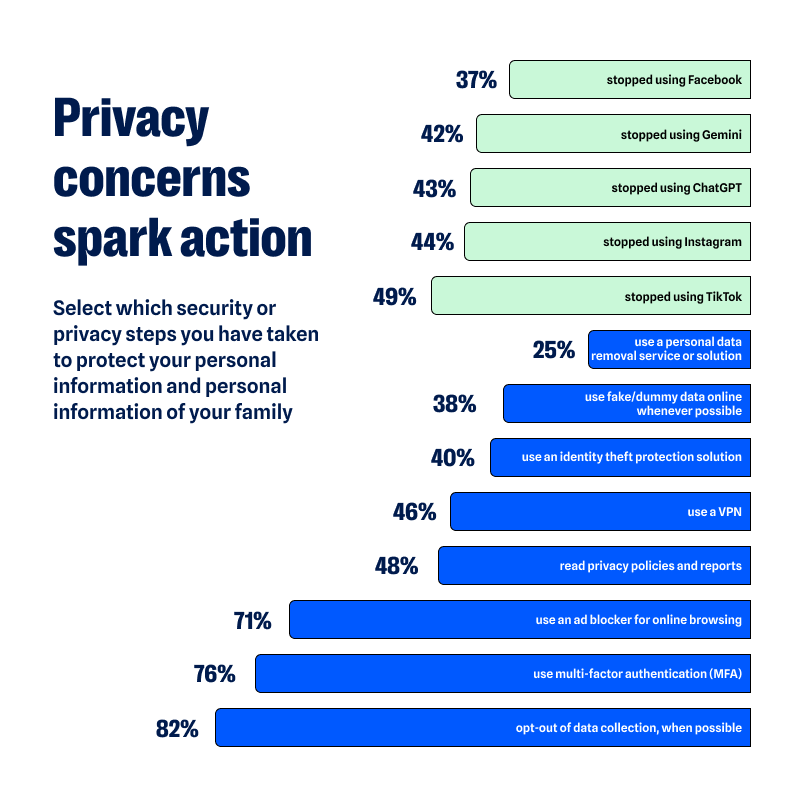

Le signal le plus fort tient peut-être dans l’évolution des usages : 43 % des répondants disent avoir arrêté d’utiliser ChatGPT, et 42 % affirment avoir cessé d’utiliser Gemini. Pris isolément, ces chiffres frappent. Mais, ils racontent surtout autre chose : l’IA n’est plus perçue uniquement comme un raccourci pratique ou un effet de mode technologique.

Elle devient, pour une partie du public, un espace à risque qu’il faut apprendre à contourner, limiter ou tenir à distance.

La vie privée devient enfin un critère d’usage, pas seulement un sujet de débat

C’est là que l’étude est intéressante. Malwarebytes ne décrit pas seulement une inquiétude théorique ; l’entreprise observe aussi une série de gestes de protection déjà engagés. Le rapport indique que 82 % des répondants cherchent à refuser la collecte de données quand c’est possible, 71 % utilisent un bloqueur de publicité, et 46 % ont recours à un VPN.

Malwarebytes note également qu’une part croissante d’utilisateurs lit davantage les politiques de confidentialité, saisit parfois de fausses données ou se tourne vers des services de suppression d’informations personnelles.

Autrement dit, la relation entre public et IA entre dans une phase plus mature. On ne demande plus seulement ce que ces outils savent faire. On commence sérieusement à demander ce qu’ils voient, ce qu’ils retiennent, et ce qu’ils pourraient réutiliser.

Les réseaux sociaux aussi paient une partie de cette défiance

L’enquête de Malwarebytes relie cette méfiance à des comportements plus larges dans l’écosystème numérique. 44 % des personnes interrogées disent avoir arrêté d’utiliser Instagram, et 37 % Facebook. Le rapport ne présente pas ces abandons comme une preuve directe d’un rejet de l’IA générative de Meta, mais il les inscrit dans un climat général de fatigue face aux plateformes qui accumulent données, automatisation et personnalisation opaque.

Il faut évidemment rester prudent dans l’interprétation. L’étude vient d’un éditeur de solutions de cybersécurité, pas d’un institut académique indépendant, et elle mesure avant tout un ressenti déclaratif. Mais même avec cette réserve, le mouvement qu’elle décrit est cohérent avec une tendance plus large : à mesure que l’IA s’insère dans les usages quotidiens, la question de la confiance devient presque plus importante que celle de la performance.

Le vrai défi pour OpenAI, Google et les autres

Pour les grands acteurs du secteur, le message est assez clair. Le problème n’est plus seulement de rendre un chatbot plus rapide, plus précis ou plus polyvalent. Il faut aussi convaincre qu’il sait rester à sa place. La promesse d’utilité ne suffit plus si elle s’accompagne d’un flou persistant sur la collecte, l’usage et la rétention des données personnelles.

C’est sans doute le tournant le plus intéressant de 2026 : le débat sur l’IA quitte progressivement le terrain de la démonstration pour entrer sur celui du consentement. Et dans cette nouvelle phase, les entreprises qui réussiront ne seront pas forcément celles qui auront les modèles les plus spectaculaires, mais celles qui sauront construire un cadre d’usage suffisamment clair pour restaurer la confiance.

Au fond, la « fatigue IA » n’est peut-être pas un rejet de l’outil lui-même. Elle ressemble davantage à une exigence nouvelle : celle d’une intelligence artificielle utile, oui, mais plus sobre, plus transparente et beaucoup moins intrusive.