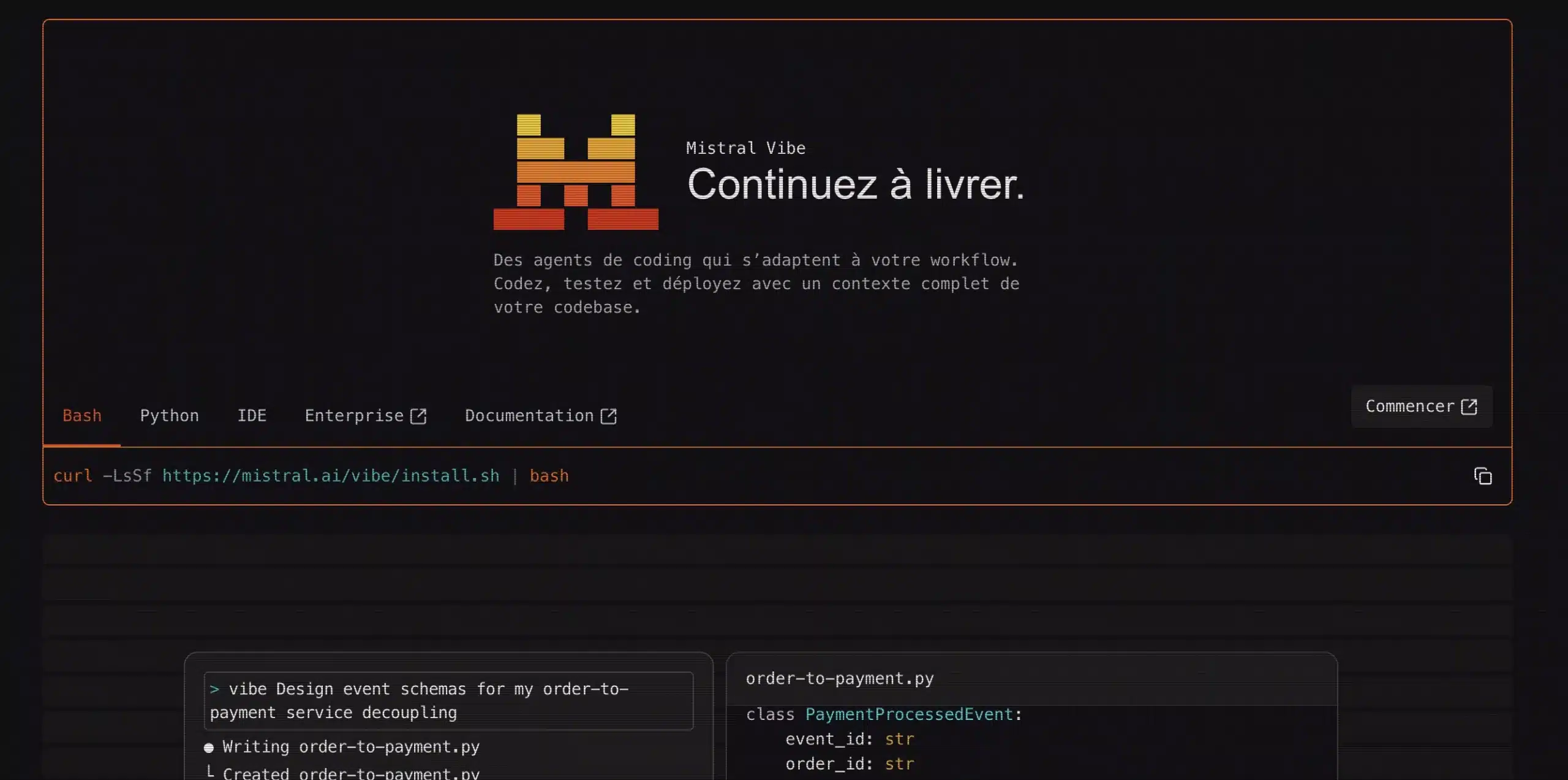

Dans la course mondiale aux assistants de développement dopés à l’IA, Mistral AI accélère sans détour. La pépite parisienne annonce la disponibilité générale de Mistral Vibe 2.0, une mise à niveau majeure de son agent de code en CLI, et surtout un signal clair : l’heure n’est plus au test gratuit, mais à la monétisation et à l’industrialisation.

Derrière cette sortie, un enjeu plus large se dessine : permettre aux entreprises — en particulier celles qui vivent sur des systèmes legacy — d’adopter l’IA de manière crédible, sans abandonner le contrôle de leur code, de leurs données et de leur propriété intellectuelle.

De la démo gratuite au produit payant : un moment charnière pour Mistral

Jusqu’ici, Mistral Vibe vivait dans une phase de lancement souple : accès gratuit, itération rapide, expérimentation. Désormais, Mistral officialise le passage à l’échelle avec une « disponibilité générale » qui s’accompagne d’un basculement commercial : Mistral Vibe s’intègre aux offres payantes Le Chat.

Dans une interview (relayée par VentureBeat), Timothée Lacroix résume la séquence : Devstral 2 est arrivé en décembre, une première version de Vibe a suivi, puis la CLI a été finalisée et améliorée — avant de passer dans une formule bundle avec Le Chat. L’idée est limpide : convertir l’intérêt des développeurs en revenus récurrents, un mouvement classique dans le cycle de vie des outils dev… mais rarement simple dans un marché où la concurrence (OpenAI, Anthropic, Google) avance vite.

Ce lancement s’inscrit aussi dans un contexte plus politique et financier : Arthur Mensch, au WEF de Davos, a évoqué une trajectoire visant plus d’un milliard d’euros de revenus fin 2026. Une ambition qui ne rattrape pas les mastodontes américains, mais qui, si elle se matérialise, installerait Mistral comme acteur européen de référence.

Le code d’entreprise qui n’a jamais vu le Web

Là où la plupart des copilotes brillent sur du code public et des stacks modernes, Mistral cible une douleur connue des CTO : le patrimoine logiciel interne.

Lacroix met le doigt sur le cœur du problème : les️︎ les grandes entreprises s’appuient sur des bases de code construites sur des années, parfois des décennies, souvent avec des bibliothèques maison, des conventions internes et des langages spécifiques — autrement dit, un univers qui échappe aux modèles entraînés sur des dépôts publics.

Mistral veut transformer cette faiblesse structurelle du marché en avantage concurrentiel : grâce à la CLI Vibe et aux modèles Devstral, la promesse est de customiser l’assistant sur le code et l’IP du client pour obtenir une expérience plus pertinente, plus sûre, plus « dans le contexte ».

Dit autrement : le futur des assistants de code en entreprise ne se jouera pas seulement sur « qui code le mieux sur GitHub », mais sur qui comprend votre code propriétaire — et peut le faire sans l’exposer.

Mistral Vibe 2.0 : plus de garde-fous, plus d’orchestration, plus de « contrôle dev »

Mistral Vibe 2.0 enrichit l’outillage autour de la CLI avec une philosophie assumée : moins de magie, plus de pilotage.

- Subagents personnalisés : au lieu d’un assistant monolithique, les équipes peuvent créer des agents spécialisés (review de PR, scripts de déploiement, génération de tests, etc.) et les invoquer selon les besoins.

- Clarifications multi-choix : plutôt que d’inférer des intentions floues et risquer une modification indésirable, Vibe propose des options avant d’agir — un détail qui compte quand on touche à des repos critiques.

- « Slash-command skills » : des workflows préconfigurés (déploiement, lint, doc) déclenchables par commandes.

- Modes d’agent unifiés : des « profils » combinant outils, permissions et comportements, pour passer d’un contexte à l’autre sans changer d’app.

- Mises à jour continues via CLI : fin du versioning manuel, l’outil se met à jour de manière fluide.

Sur le papier, cela ressemble à une réponse directe à l’évolution du marché : on ne vend plus seulement un modèle, on vend une expérience d’exécution, avec des rails de sécurité, des permissions, des habitudes d’équipe et des process.

Devstral 2 contre l’obsession du gigantisme

Techniquement, le moteur de Vibe est Devstral 2. Mistral fait ici un pari lisible : des modèles denses et plus compacts peuvent rivaliser avec des systèmes plus massifs, tout en restant plus simples à déployer.

Le texte évoque :

- Devstral 2 (123B paramètres, dense), crédité de 72,2 % sur SWE-bench Verified.

- Devstral 2 Small (24B), présenté comme capable de tourner sur du matériel grand public, y compris des laptops — un argument très « terrain », presque narratif : coder dans le train, sans dépendre d’une infra lourde.

Mistral insiste sur un point d’architecture : dense vs Mixture-of-Experts (MoE). Les MoE peuvent être très performants, mais leur déploiement et leur efficacité réelle demandent une infra plus complexe. Les denses, eux, sont plus « straightforward » pour du on-prem et des environnements contraints. Dans l’entreprise, cette simplicité opérationnelle peut valoir autant qu’un gain de quelques points sur un benchmark.

Sécurité, souveraineté, on-prem : quand l’IA devient une décision de gouvernance

C’est ici que le discours de Mistral se distingue : la question n’est pas seulement « où ça tourne », mais à qui ça appartient.

Pour les banques, la santé, la défense, ou toute industrie régulée, envoyer son code — et parfois des fragments de logique métier — vers un fournisseur externe n’est pas un détail : c’est un risque systémique. Lacroix formule une position presque stratégique : l’important, c’est que l’entreprise ne « ship » pas sa base de code à un tiers et garde la main sur les choix de déploiement et de sécurité.

Mistral alimente aussi cette posture via ses relations gouvernementales et son discours sur la souveraineté stratégique (Mensch, Davos), notamment autour des systèmes autonomes et des enjeux de défense. Le message sous-jacent : l’IA n’est plus un outil, c’est une capacité — et, de plus en plus, une dépendance à gérer.

De « fabricant de modèles » à plateforme enterprise

Le lancement de Vibe 2.0 raconte une mutation plus profonde : Mistral ne veut plus être seulement un fournisseur de poids de modèles, mais une plateforme complète pour construire, adapter, intégrer et rentabiliser l’IA en entreprise.

Services d’intégration, fine-tuning, continuation pre-training, RL dans des environnements clients, modernisation de code… tout converge vers une même promesse : le ROI, pas la démo.

Et, Mistral n’esquive pas la réalité concurrentielle : selon ses propres évaluations humaines citées dans le texte, Claude Sonnet 4.5 serait « significativement préféré » face à Devstral 2. Autrement dit, l’entreprise reconnaît un écart de « capacité brute » sur certains usages, mais assume une autre ligne de force : customisation + contrôle + déploiement maîtrisé.

La guerre des assistants de code n’est plus seulement une bataille de QI. C’est une bataille de propriété : qui possédera le modèle qui comprend votre code ? Et, à ce jeu-là, Mistral tente de faire de l’ouverture et de l’adaptabilité non pas une posture, mais un produit.