Microsoft vient d’annoncer Copilot Health, un espace séparé dans Copilot dédié aux échanges autour de la santé : comprendre des résultats de laboratoire, décoder un dossier médical, croiser des données de wearables, ou encore chercher un professionnel de santé. L’accès se fera progressivement via un déploiement par étapes, avec liste d’attente pour les curieux.

Sur le papier, c’est exactement ce que beaucoup attendaient : un assistant capable d’expliquer vos données, sans vous perdre dans le jargon, et sans vous renvoyer vers dix onglets de forums.

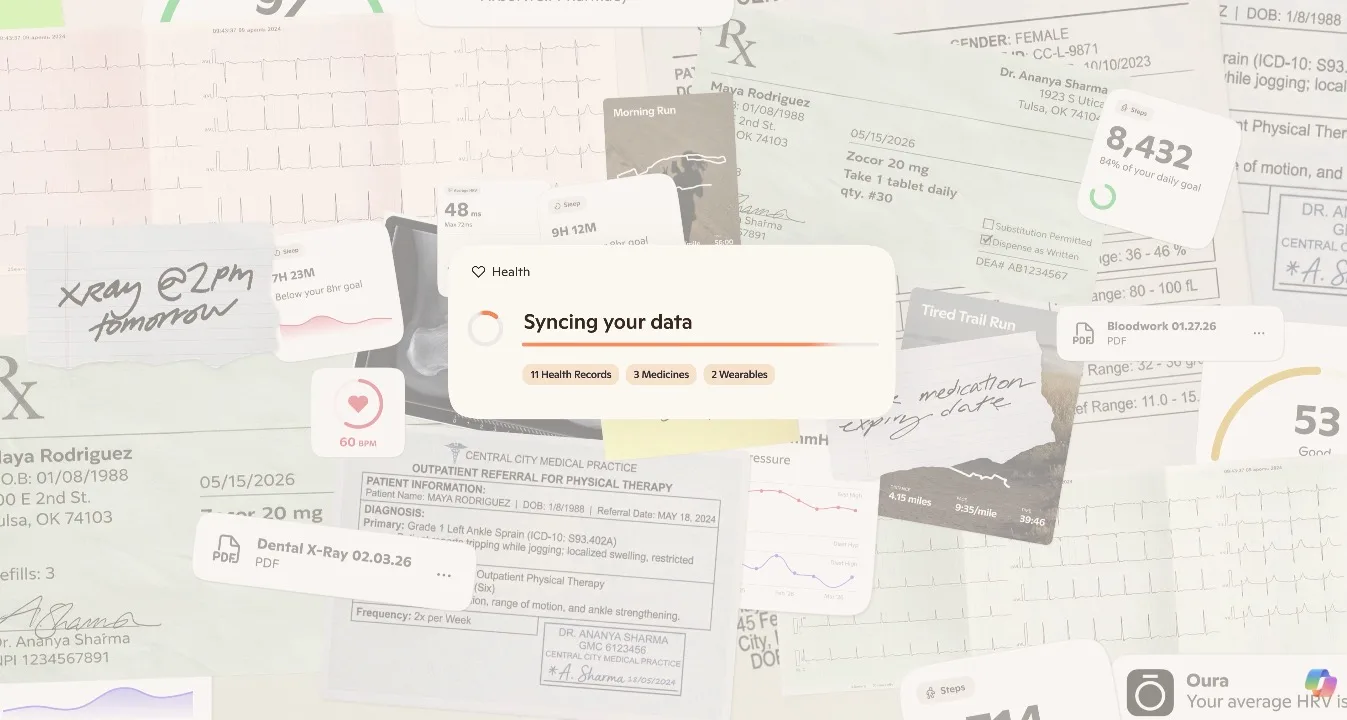

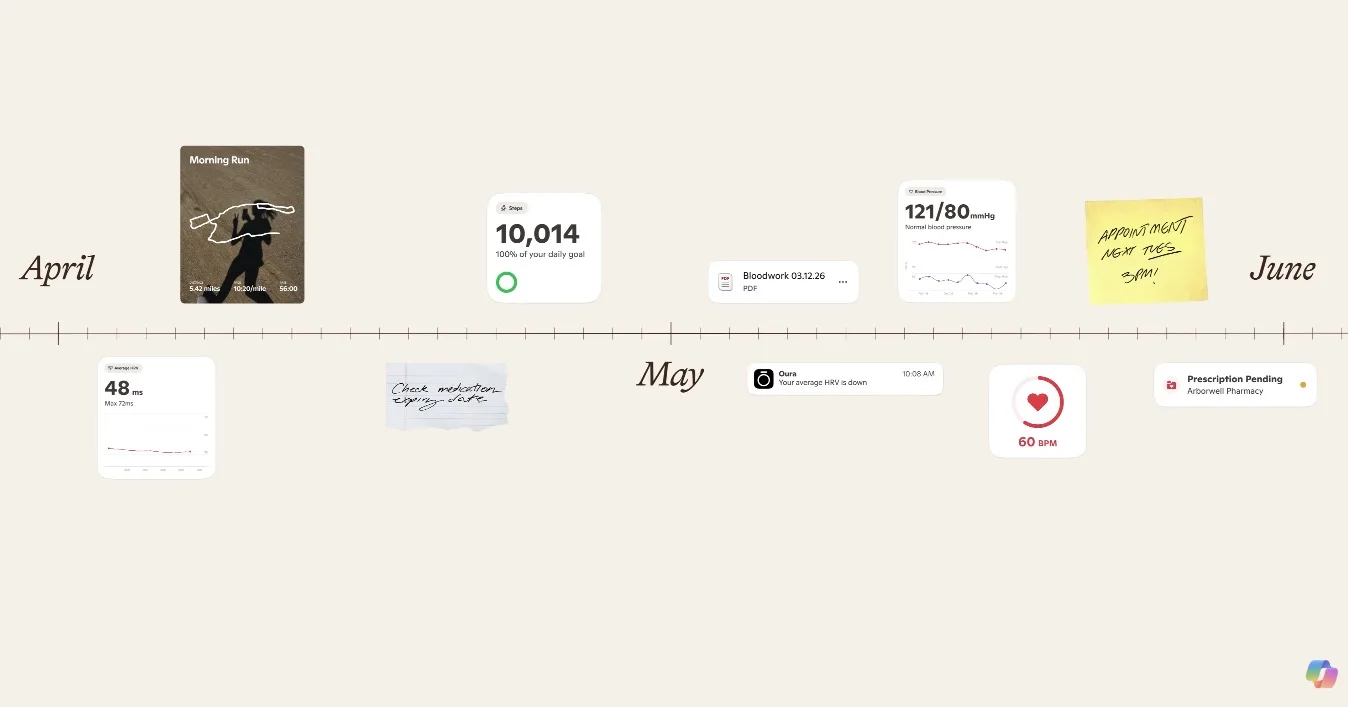

Un Copilot « à part » : import de dossiers, labos et wearables

Microsoft insiste sur un point : Copilot Health ne remplace pas un médecin et n’a pas vocation à poser des diagnostics ou à prescrire un traitement. L’objectif affiché est d’aider l’utilisateur à mieux comprendre ses informations de santé.

Concrètement, Copilot Health peut :

- Importer des dossiers médicaux depuis plus de 50 000 hôpitaux et organisations de santé aux États-Unis via HealthEx.

- Importer des résultats de tests via Function (intégration labo).

- Se connecter à plus de 50 appareils wearables (Apple, Oura, Fitbit, etc.), pour afficher des métriques (pas, tendances, rappels, rendez-vous) selon les données que l’utilisateur accepte de partager.

- Rechercher des professionnels via des annuaires « temps réel » (spécialité, localisation, langues, assurances).

Le positionnement est clair : Copilot Health veut devenir une surcouche de lisibilité entre vos données (souvent éclatées) et votre capacité à en faire quelque chose de compréhensible.

« Réponses plus fiables » : citations et cartes Harvard Health

Microsoft tente aussi de répondre à la critique la plus fréquente contre l’IA en santé : la fiabilité. L’entreprise affirme « élever » l’information issue d’organisations de santé crédibles, et annonce des réponses avec citations avec des cartes de réponse rédigées par des experts de Harvard Health.

C’est un bon signal — mais ça ne règle pas tout : même avec des sources, l’IA peut mal interpréter un contexte, sur-généraliser ou donner trop de confiance à une hypothèse. Les citations aident surtout à auditer et à recadrer.

Confidentialité : isolation, contrôle utilisateur… mais débat HIPAA

Côté confidentialité, Microsoft met en avant une architecture « compartimentée » : les chats Copilot Health seraient isolés du Copilot général, soumis à des contrôles supplémentaires, non utilisés pour l’entraînement des modèles, avec possibilité de supprimer les données ou de déconnecter les sources à tout moment.

La ligne la plus sensible, en revanche, est ailleurs : Copilot Health est présenté comme une expérience grand public non HIPAA-compliant à ce stade, contrairement à certains produits « HIPAA-ready/compliant » du marché (Amazon Health AI, et des offres orientées organisations chez d’autres acteurs). Microsoft répond par une nuance juridique : en direct-to-consumer, l’entreprise estime que HIPAA « n’est pas requis », tout en évoquant des « contrôles HIPAA » à venir.

Pour rappel, HIPAA est une loi américaine qui a pour but de faire respecter la portabilité et la responsabilité en matière d’assurance maladie. Elle exige que les entreprises qui traitent des informations de santé protégées aient mis en place des mesures de sécurité physiques, de réseau et de processus et qu’elles les suivent.

À côté, Microsoft souligne une certification ISO/IEC 42001 (standard de management pour systèmes IA), censée attester d’une gouvernance responsable et auditable.

Microsoft veut être votre « interprète », mais la confiance se gagnera sur le long terme

Le lancement de Copilot Health confirme une tendance 2026 : l’IA grand public se déplace vers des espaces isolés pour les sujets à haut risque (santé, finance), avec promesse de non-entraînement, contrôles renforcés et connecteurs vers des données personnelles. OpenAI a lancé une approche comparable avec ChatGPT Health en janvier, et Anthropic a lancé Claude for Healthcare.

Le pari de Microsoft est cohérent : si l’IA devient la « porte d’entrée » du quotidien, la santé est un usage massif… et anxiogène. Mais le vrai test ne sera pas l’interface : ce sera la stabilité des politiques, la clarté de ce qui est collecté/stocké, et la capacité à éviter les dérives (conseils inadaptés, sur-interprétation, risques en santé mentale).

Copilot Health peut être un très bon outil — tant qu’on le traite comme un assistant de compréhension, pas comme un arbitre médical.