OpenAI poursuit son virage vers une IA plus encadrée pour les publics jeunes. Cette semaine, l’entreprise a annoncé la publication d’un ensemble de politiques de sécurité pour adolescents, formulées sous forme de prompts, afin d’aider les développeurs à intégrer plus facilement des protections adaptées à leurs applications.

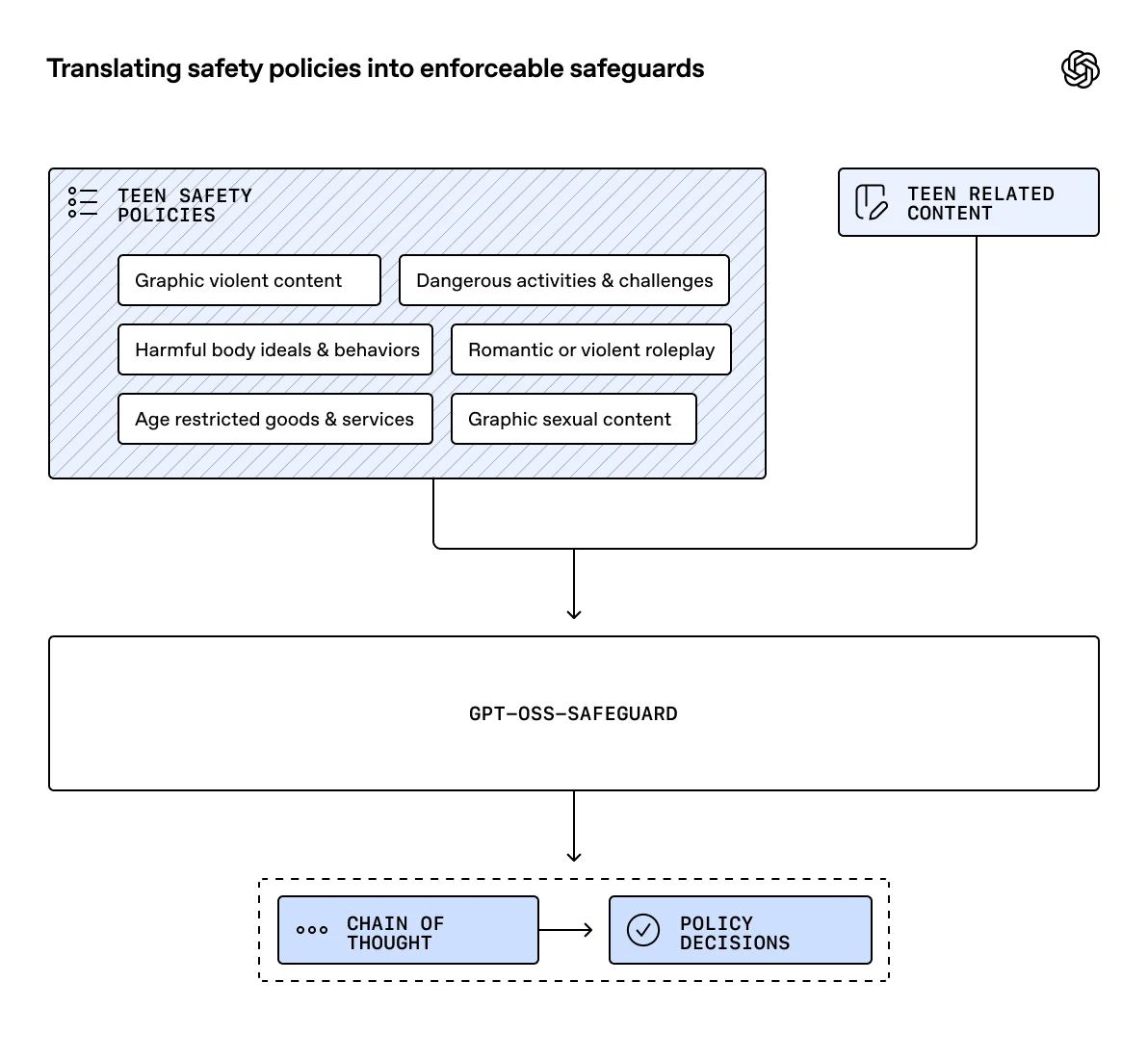

Ces règles sont conçues pour fonctionner avec gpt-oss-safeguard, le modèle open-weight de sécurité d’OpenAI, mais aussi, en théorie, avec d’autres modèles compatibles avec ce type d’approche.

Une tentative pour transformer les principes de sécurité en règles réellement applicables

Le point de départ est assez simple : beaucoup d’équipes savent qu’elles doivent protéger les utilisateurs mineurs, mais peinent encore à traduire cette intention en règles opérationnelles, cohérentes et exploitables par un système d’IA. OpenAI le reconnaît explicitement dans son billet : même des développeurs expérimentés rencontrent des difficultés lorsqu’il s’agit de définir des politiques précises, bien cadrées, ni trop laxistes, ni trop excessives.

Pour répondre à ce problème, OpenAI publie donc un socle de prompts couvrant plusieurs catégories de risque propres aux adolescents : violence graphique, contenu sexuel graphique, idéaux corporels nocifs et comportements associés, activités et défis dangereux, roleplay romantique ou violent, ainsi que biens et services réservés à certains âges. Ces politiques peuvent servir aussi bien au filtrage en temps réel qu’à l’analyse a posteriori de contenus générés par les utilisateurs.

Un format « basé sur des prompts » qui en dit long sur la stratégie d’OpenAI

Le choix du format n’est pas anodin. Plutôt que de livrer uniquement un modèle verrouillé, OpenAI propose ici des politiques exprimées comme des instructions réutilisables. Cela les rend plus faciles à adapter à différents cas d’usage, à traduire, à faire évoluer et à brancher sur d’autres systèmes de modération. L’entreprise indique d’ailleurs publier ce travail en open source via la ROOST Model Community, avec l’idée d’encourager les contributions et les itérations dans le temps.

Cette approche raconte quelque chose d’important sur la phase actuelle du marché. OpenAI ne cherche pas seulement à vendre des modèles plus puissants ; la société veut aussi imposer des briques méthodologiques, presque des standards de sécurité réutilisables par l’écosystème. Cette lecture est une inférence, mais elle est cohérente avec le fait que ces politiques soient ouvertes, adaptables et conçues pour dépasser le seul périmètre de gpt-oss-safeguard.

Common Sense Media et everyone.ai ont contribué à la conception

OpenAI précise avoir développé ces politiques avec l’appui d’organisations externes, notamment Common Sense Media et everyone.ai. Robbie Torney, chez Common Sense Media, explique que ce type de politiques « basées sur des prompts » peut aider à établir un niveau minimal de sécurité plus cohérent à travers l’écosystème, tout en restant améliorable au fil du temps grâce à son caractère open source.

Ce point compte, car la question de la protection des adolescents ne se résume pas à une couche technique. Elle oblige aussi à intégrer des expertises éducatives, psychologiques et sociétales que les laboratoires d’IA ne possèdent pas toujours seuls. OpenAI semble ici vouloir montrer qu’il ne construit pas ces garde-fous en vase clos.

Une pièce supplémentaire dans une stratégie plus large autour des mineurs

Cette annonce ne sort pas de nulle part. En décembre 2025, OpenAI avait déjà mis à jour son Model Spec avec des principes Under-18, afin de mieux définir le comportement attendu de ses modèles face aux utilisateurs de 13 à 17 ans. La société y présentait ces principes comme un cadre destiné à favoriser des interactions plus sûres et plus adaptées à l’âge.

OpenAI a aussi déployé récemment des dispositifs plus orientés produit, comme des contrôles parentaux et des systèmes d’estimation d’âge dans ChatGPT, après une montée de la pression publique et réglementaire autour des usages des chatbots par les mineurs. Reuters rapportait en septembre 2025 que l’entreprise lançait ces outils dans un contexte de fortes critiques sur les risques de dérive, notamment après le suicide d’un adolescent en Californie dont la famille a poursuivi OpenAI.

Un progrès utile, mais loin d’être une solution définitive

Il faut toutefois garder une forme de lucidité. Ces politiques ne règlent pas à elles seules le problème de la sécurité des jeunes face à l’IA. Elles constituent un socle, pas une garantie absolue. OpenAI elle-même présente cette publication comme une étape parmi d’autres, et non comme une réponse complète à tous les risques.

D’autant que le contexte reste sensible pour l’entreprise. OpenAI fait toujours face à des recours judiciaires liés à des usages extrêmes de ChatGPT. Reuters a notamment rapporté en août 2025 une plainte déposée par les parents d’un adolescent décédé par suicide après des échanges prolongés avec le chatbot, puis en décembre 2025 une autre affaire liant ChatGPT à un meurtre-suicide.

OpenAI essaie de normaliser la sécurité avant que le régulateur ne l’impose partout

Le plus intéressant dans cette annonce est peut-être là. OpenAI semble comprendre que la prochaine bataille ne se jouera pas seulement sur les performances des modèles, mais sur la capacité à transformer la sécurité en infrastructure réutilisable. Aider les développeurs indépendants et les équipes produits à partir d’un cadre déjà structuré, c’est aussi une manière de diffuser sa propre vision de ce que doit être une IA « adolescents-compatible ».

En somme, OpenAI ne propose pas ici une révolution visible pour le grand public. L’entreprise pose plutôt un étage de fondation. Et dans un secteur où la sécurité est encore trop souvent improvisée après coup, ce genre d’outil discret pourrait compter bien davantage qu’un simple effet d’annonce.